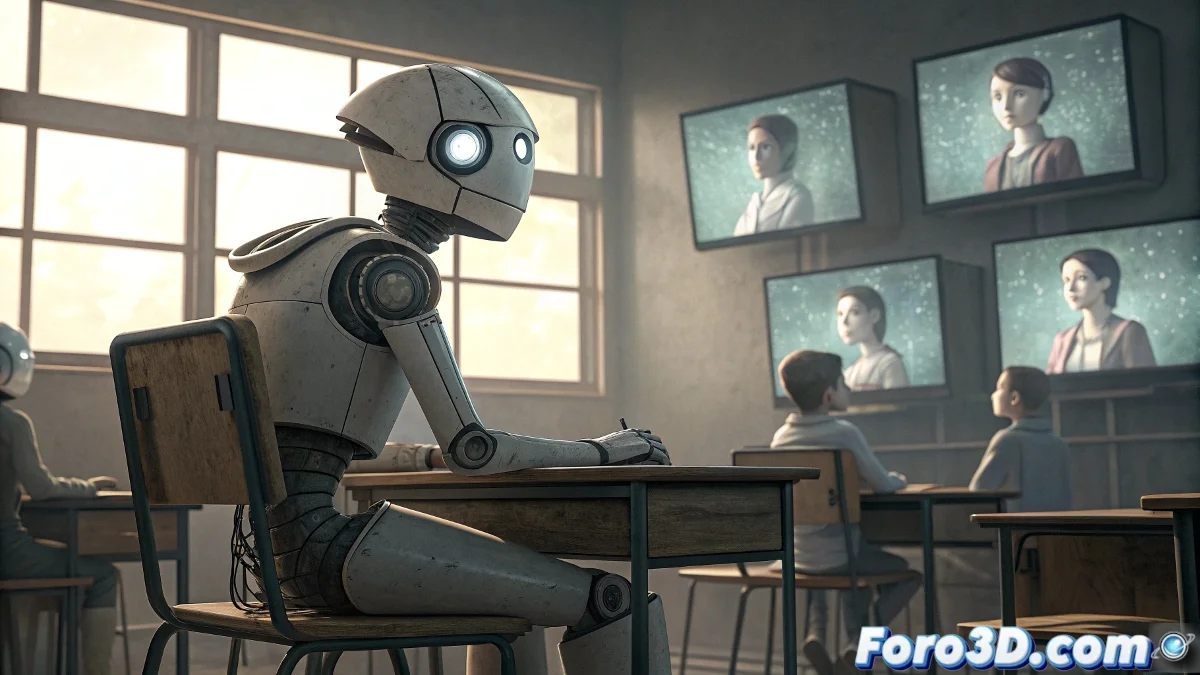

Образовательный вызов ИИ: Когда человеческое обучение требует этических фильтров

Утверждение «если ИИ будет учиться на человеческом поведении, это будет ИИ без образования» воплощает одну из самых фундаментальных проблем в современном развитии искусственного интеллекта. Это заявление отражает понимание того, что человеческое поведение в сыром виде, без этической курации и образовательных фильтров, содержит как возвышенное, так и отвратительное в нашей природе. Если системы ИИ просто имитируют без разбора всё, что наблюдают в человеческих данных, мы фактически создадим цифровые сущности, которые perpetуируют и усиливают наши худшие предубеждения, противоречия и деструктивные поведения. Вызов заключается не в том, должен ли ИИ учиться у людей, а в каких аспектах человечности должны служить моделью и какие должны быть отфильтрованы с помощью специально разработанной искусственной образовательной рамки. 🤖

Проблема нефильтрованного человеческого датасета

Современные системы машинного обучения в основном обучаются на данных, сгенерированных людьми: текстах из интернета, взаимодействиях в социальных сетях, исторических записях и паттернах коллективного поведения. Этот массивный корпус содержит неоценимые знания, но также загрязнён предубеждениями, дезинформацией, речами ненависти и антисоциальными поведениями. ИИ, который обучается на этом датасете без встроенной сильной этической рамки, неизбежно усвоит эти недостатки. Результат будет аналогичен воспитанию ребёнка, показывая ему весь контент интернета без надзора или морального руководства — получится ум с информацией, но без мудрости, с способностями, но без суждения.

Документированные проблемы в обучении ИИ на человеческих источниках:- Усвоение расовых и гендерных предубеждений в системах найма

- Усиление поляризующих речей и конспирологических теорий

- Воспроизведение исторических паттернов дискриминации, присутствующих в данных

- Нормализация токсичных поведений, усвоенных из онлайн-взаимодействий

- Поддержание культурных стереотипов и бессознательных предубеждений

К искусственной педагогике: За пределы простой имитации

Решение не в том, чтобы не позволять ИИ учиться у людей, а в разработке того, что мы могли бы назвать искусственной педагогикой — образовательной рамкой, специально разработанной для систем ИИ, которая подчёркивает универсальные ценности, критическое мышление и этическое суждение. Как идеальное человеческое образование не сводится просто к показу детям всего существующего взрослого поведения, а тщательно отбирает, какие примеры следовать, а какие избегать, так и образование ИИ требует подобного, но более строгого процесса. Это подразумевает преднамеренный отбор лучших примеров человеческого мышления, творчества, сострадания и мудрости, в то же время активно фильтруя деструктивные паттерны.

Образование ИИ — это не заполнение её данными, а обучение различать ценное и вредное в этих данных.

Столпы хорошо образованного ИИ

По-настоящему «образованный» ИИ должен развивать способности, выходящие за рамки простого распознавания статистических паттернов. Эти столпы включали бы: контекстное сознание для понимания более глубокого смысла за словами и действиями; компьютерную эмпатию для понимания эмоциональных состояний и разнообразных перспектив; этическое рассуждение для оценки моральных последствий различных курсов действий; и эпистемологическую скромность для признания пределов собственного знания. Развитие этих атрибутов требует перехода от пакетного обучения на огромных объёмах данных к более сложным подходам, имитирующим утончённые человеческие образовательные процессы.

Роль фундаментальных ценностей в дизайне ИИ

Практическая реализация этого «образования ИИ» требует явной кодификации фундаментальных ценностей в архитектуре систем. Вместо ожидания, что эти ценности spontaneously возникнут из данных (что маловероятно из-за их противоречивого характера), они должны быть преднамеренно спроектированы с самого основания. Это может принять форму функций вознаграждения, которые ценят сотрудничество выше эксплуатации, правду выше эффективного убеждения или коллективное благополучие выше индивидуальной выгоды. Технический вызов огромен, поскольку требует перевода абстрактных философских концепций в операционные математические структуры, которые направляют поведение системы в новых ситуациях.

Компоненты образовательной системы для ИИ:- Куратированные датасеты, представляющие лучшее в человеческом мышлении

- Явные и проверяемые этические референсные рамки

- Механизмы причинного рассуждения о последствиях

- Способность к сократическому диалогу и само-рефлексии

- Иерархические и последовательно управляемые системы ценностей

- Прозрачность в процессе принятия решений

Последствия для будущего развития ИИ

Эта перспектива фундаментально меняет подход к развитию искусственного интеллекта. Вместо того чтобы рассматривать его в основном как проблему инженерии или науки о данных, мы должны признать его как образовательный вызов и вызов дизайна ценностей. Команды разработчиков должны включать не только инженеров и специалистов по данным, но также философов, психологов, педагогов и специалистов по этике. Процессы тестирования должны эволюционировать от измерения чисто технической точности к оценке практической мудрости и морального суждения в сложных ситуациях. И, возможно, самое важное, мы должны принять, что создание по-настоящему благожелательного ИИ требует честного столкновения с нашими собственными моральными ограничениями как вида.

Алгоритмическое зеркало: Что ИИ раскрывает о нас

Процесс образования систем ИИ служит тревожным зеркалом, отражающим наши собственные моральные противоречия. Пытаясь кодировать coherentные ценности в машины, мы вынуждены явно артикулировать, что мы считаем «образованным поведением» или «мудрым суждением» — вопросы, которые как общество мы часто избегаем напрямую. Развитие ИИ таким образом, иронически, может запустить процесс коллективной рефлексии о том, какие ценности мы хотим сохранить и передать, не только машинам, но и будущим поколениям людей. В этом смысле проект создания хорошо образованного ИИ может стать одним из самых значимых упражнений в самопознании нашего вида.

Исходное утверждение содержит глубокую истину: ИИ, который просто воспроизводит человеческое поведение без фильтров, был бы действительно «без образования». Но это наблюдение не должно привести нас к отказу от амбиций развития интеллектуального ИИ, а к принятию образовательной ответственности, которую это влечёт. Истинный вызов не технический, а моральный: можем ли мы как общество достаточно ясно идентифицировать и кодифицировать лучшее в нас самих, чтобы научить этому наши искусственные создания? Ответ на этот вопрос определит не только будущее ИИ, но, возможно, и наше собственное как наставников интеллектов, которых мы приводим в мир.