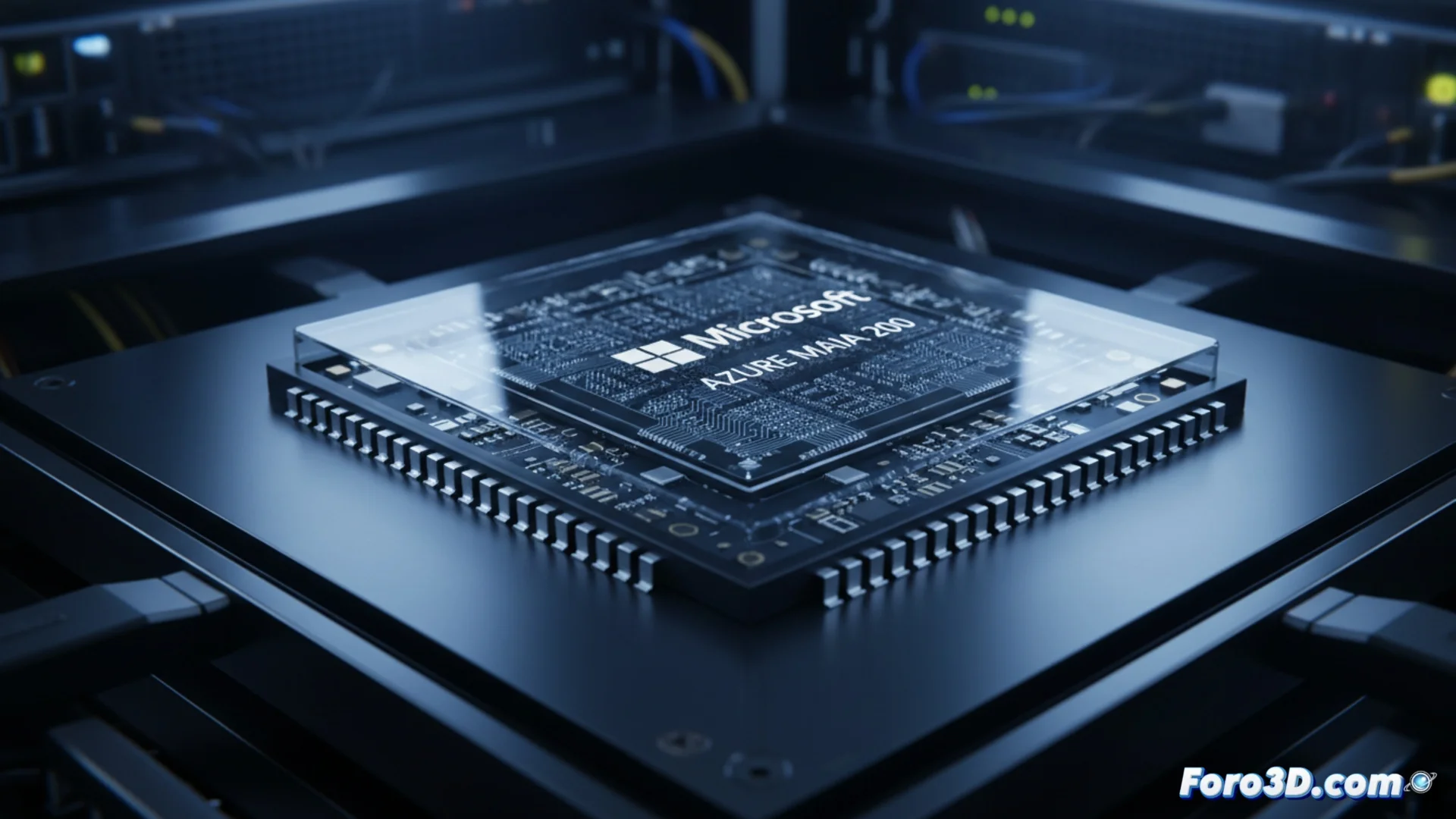

Microsoft запускает ускоритель ИИ Azure Maia 200

Технологическая компания Microsoft представила свой новый ускоритель искусственного интеллекта Azure Maia 200. Этот компонент представляет собой эволюцию в семействе процессоров Maia, специально созданных для работы в серверных системах. Его основная задача — запуск уже обученных моделей ИИ для генерации ответов и предсказаний. Microsoft разрабатывает этот аппаратный компонент для выполнения этих операций с высокой скоростью и уровнем эффективности, который, по словам компании, превосходит то, что предлагают сейчас конкуренты вроде Amazon и Google в этой области. 🚀

Фокус на эффективности и скорости для инференса

Azure Maia 200 производится с целью оптимизации выполнения моделей ИИ в крупном масштабе на платформе облачных вычислений Azure. Производя собственный чип, Microsoft стремится получить больший контроль над всей цепочкой аппаратного и программного обеспечения, что позволяет точнее настраивать обработку данных системой. Этот подход направлен на сокращение времени ожидания и улучшение использования энергии при запуске сложных моделей — от больших языковых моделей до систем анализа изображений. Компания не раскрывает все детали архитектуры, но указывает, что дизайн приоритизирует ёмкость памяти и взаимосвязи между чипами для управления огромными наборами параметров современных моделей.

Ключевые характеристики Azure Maia 200:- Разработан для выполнения задач инференса ИИ с высокой скоростью.

- Направлен на улучшение энергоэффективности в дата-центрах.

- Архитектура, приоритизирующая пропускную способность памяти и межсоединения.

Похоже, новая глобальная конкуренция ведётся не ракетами, а транзисторами — и кто быстрее обработает запрос о котятах.

Конкурентная картина в области кремния для ИИ

Запуск Maia 200 отражает широкую тенденцию в технологическом секторе, где крупные поставщики облачных услуг разрабатывают собственные специализированные чипы. Amazon имеет процессоры Inferentia и Trainium, а Google использует Tensor Processing Units (TPU). Представляя Maia 200, Microsoft укрепляет свой план по предоставлению уникальной инфраструктуры ИИ, конкурируя не только в программных сервисах, но и в производительности аппаратного обеспечения на базовом уровне. Компания планирует внедрить эти ускорители в свои дата-центры по всему миру для поддержки сервисов вроде Azure OpenAI Service и других операций генеративного ИИ.

Основные игроки в области кастомных чипов для облака:- Microsoft: Azure Maia 200 для инференса.

- Amazon Web Services: Чипы Inferentia и Trainium.

- Google Cloud: Tensor Processing Units (TPU).

Последствия для будущего облачных вычислений

Этот шаг подчёркивает, как гонка за превосходство в ИИ теперь критически зависит от кастомного кремния. Контролируя как программное обеспечение, так и аппаратное, Microsoft стремится предложить клиентам более интегрированный и эффективный стек. Конечная цель — обрабатывать более крупные и сложные модели искусственного интеллекта быстрее и с меньшими операционными затратами, определяя новые стандарты производительности в облаке. 🔌