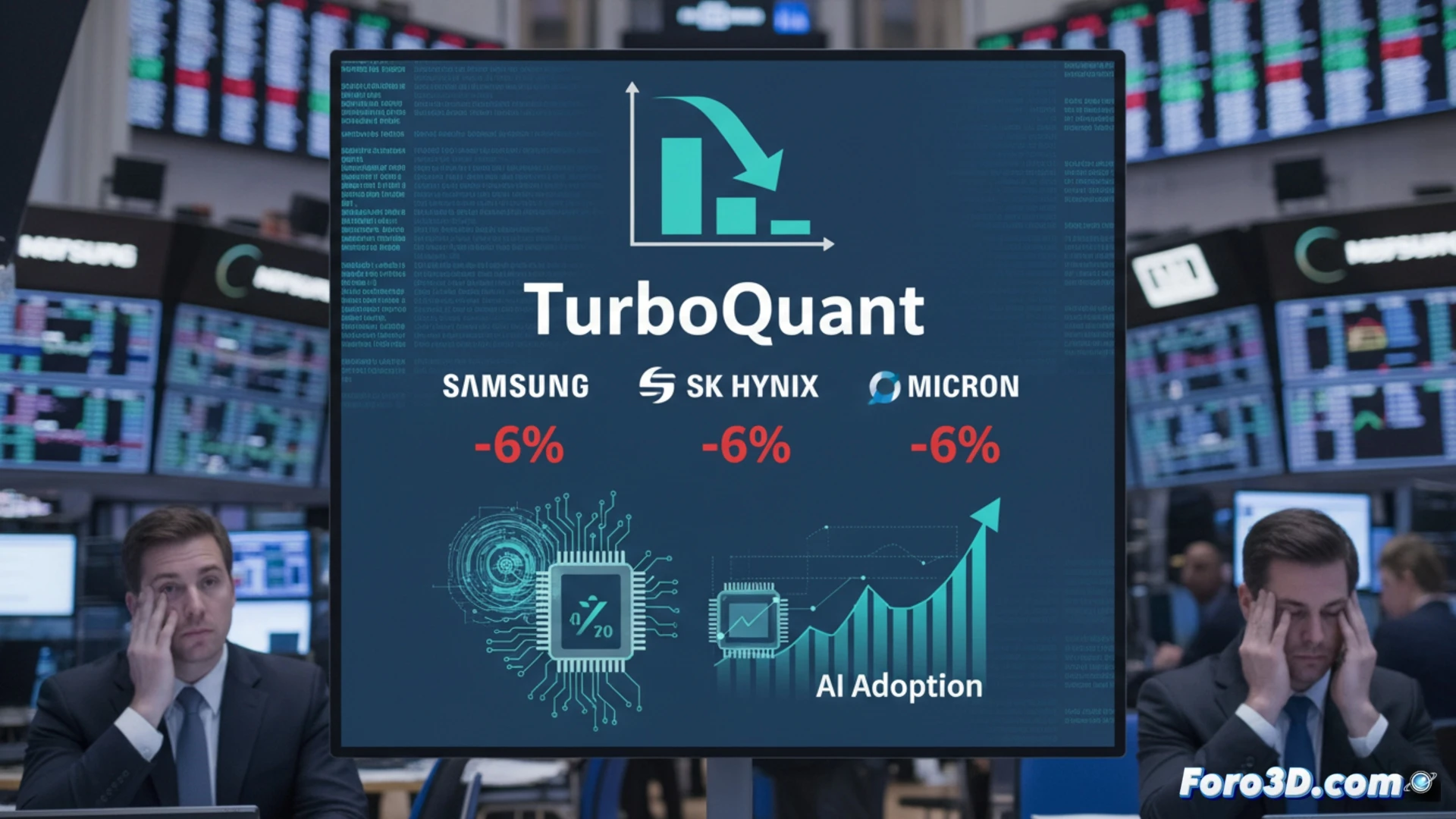

Google представил TurboQuant, технику сжатия моделей языка, которая уменьшает в шесть раз объем памяти, необходимый для вывода ИИ, без потери точности. Объявление вызвало немедленное падение акций на уровне около 6% у гигантов памяти, таких как Samsung, SK Hynix и Micron. Страх рынка ясен: если ПО станет радикально эффективнее, прогнозируемый спрос на аппаратуру памяти DRAM и HBM, ключевую для ИИ, может значительно сократиться.🚀

Технические последствия: меньше HBM на чип, больше чипов на пластине💡

Представляя процессор для ИИ как GPU, его архитектура зависит от стеков памяти HBM с высокой пропускной способностью, дорогого и сложного в производстве компонента. TurboQuant, сжимая веса модели, уменьшает необходимость их хранения в этой HBM во время выполнения. Это может привести к будущим дизайнам с меньшим количеством стеков памяти на чип или с меньшей емкостью, освобождая место на кремнии и снижая затраты на материалы. В масштабе производства меньший спрос на единицу может означать, что пластина полупроводников даст больше конечных чипов, изменяя расчеты мощностей фабрик и производителей памяти.

Краткосрочная паника против структурной возможности🤔

Биржевая реакция отражает страх перед нарушением, но долгосрочная картина более нюансирована. Более эффективный и дешевый вывод ИИ снижает барьер входа, способствуя массовому внедрению в устройства и сервисы. Эта пролиферация может создать больший общий спрос на память, хотя и распределенный по большему числу приложений и, возможно, по разным типам чипов. Промышленность полупроводников должна адаптироваться: ценность больше не только в продаже гигабайт, а в интеграции оптимизированных решений памяти и обработки для сжатых и эффективных моделей.

Как сжатие моделей вроде TurboQuant от Google может стимулировать внедрение памятей высокой плотности и архитектур 3D-IC в аппаратное обеспечение для ИИ?

(PD: моделировать чип в 3D легко, сложно сделать так, чтобы он не выглядел как город из Lego)