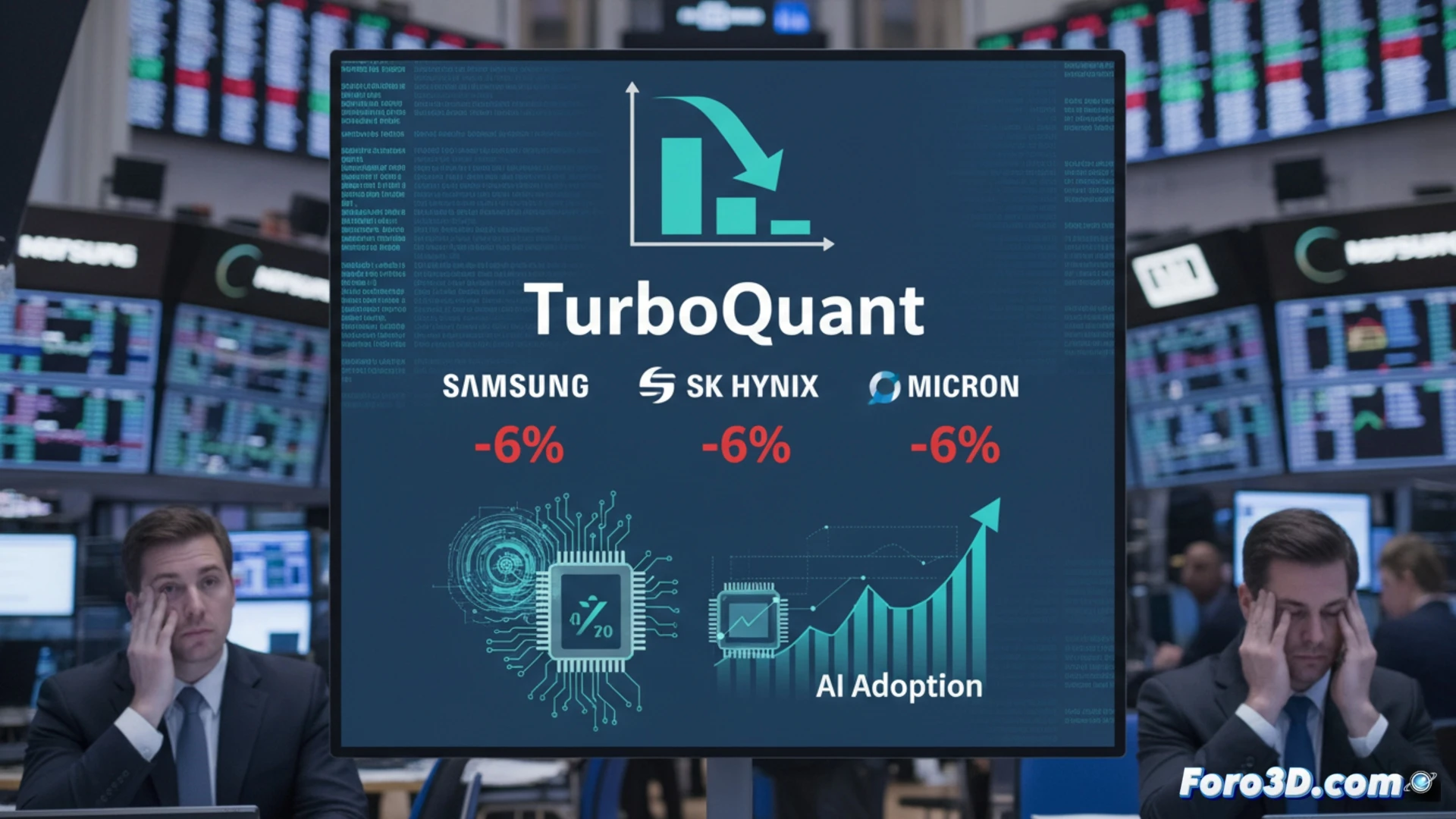

Google ha desvelado TurboQuant, una técnica de compresión de modelos de lenguaje que reduce hasta seis veces la memoria necesaria para la inferencia de IA sin merma de precisión. El anuncio provocó una inmediata caída bursátil, cercana al 6%, en gigantes de la memoria como Samsung, SK Hynix y Micron. El temor del mercado es claro: si el software se vuelve radicalmente más eficiente, la demanda proyectada de hardware de memoria DRAM y HBM, clave para la IA, podría contraerse significativamente.🚀

Implicaciones técnicas: menos HBM por chip, más chips por oblea💡

Visualizando un procesador para IA como una GPU, su arquitectura depende de pilas de memoria HBM de alto ancho de banda, un componente costoso y complejo de fabricar. TurboQuant, al comprimir los pesos del modelo, reduce la necesidad de almacenarlos en esa HBM durante la ejecución. Esto podría traducirse en diseños futuros con menos stacks de memoria por chip o con capacidades menores, liberando espacio en el silicio y reduciendo costos de materiales. A escala de producción, una menor demanda por unidad podría significar que una oblea de semiconductores rinda para más chips finales, alterando los cálculos de capacidad de las fundiciones y los fabricantes de memoria.

Pánico cortoplacista versus oportunidad estructural🤔

La reacción bursátil refleja un miedo a la disrupción, pero el panorama a largo plazo es más matizado. Una inferencia de IA más eficiente y económica reduce la barrera de entrada, potenciando una adopción masiva en dispositivos y servicios. Esta proliferación podría generar una demanda total de memoria mayor, aunque distribuida en más aplicaciones y posiblemente en tipos de chips diferentes. La industria de semiconductores debe adaptarse: el valor ya no estará solo en vender gigabytes, sino en integrar soluciones de memoria y procesamiento optimizadas para modelos comprimidos y eficientes.

¿Cómo podría la compresión de modelos como TurboQuant de Google impulsar la adopción de memorias de alta densidad y arquitecturas 3D-IC en el hardware para IA?

(PD: modelar un chip en 3D es fácil, lo difícil es que no parezca una ciudad de Lego)