Google AI Studio — это платформа для тестирования и настройки моделей Gemini. Одна из её функций позволяет изменять настройки безопасности ассистента. Это позволяет добиться менее ограниченного поведения в креативных или экспериментальных ответах, что полезно для разработчиков, которым нужно тестировать пределы модели в контролируемых средах.

Настройка параметров безопасности в API 🛡️

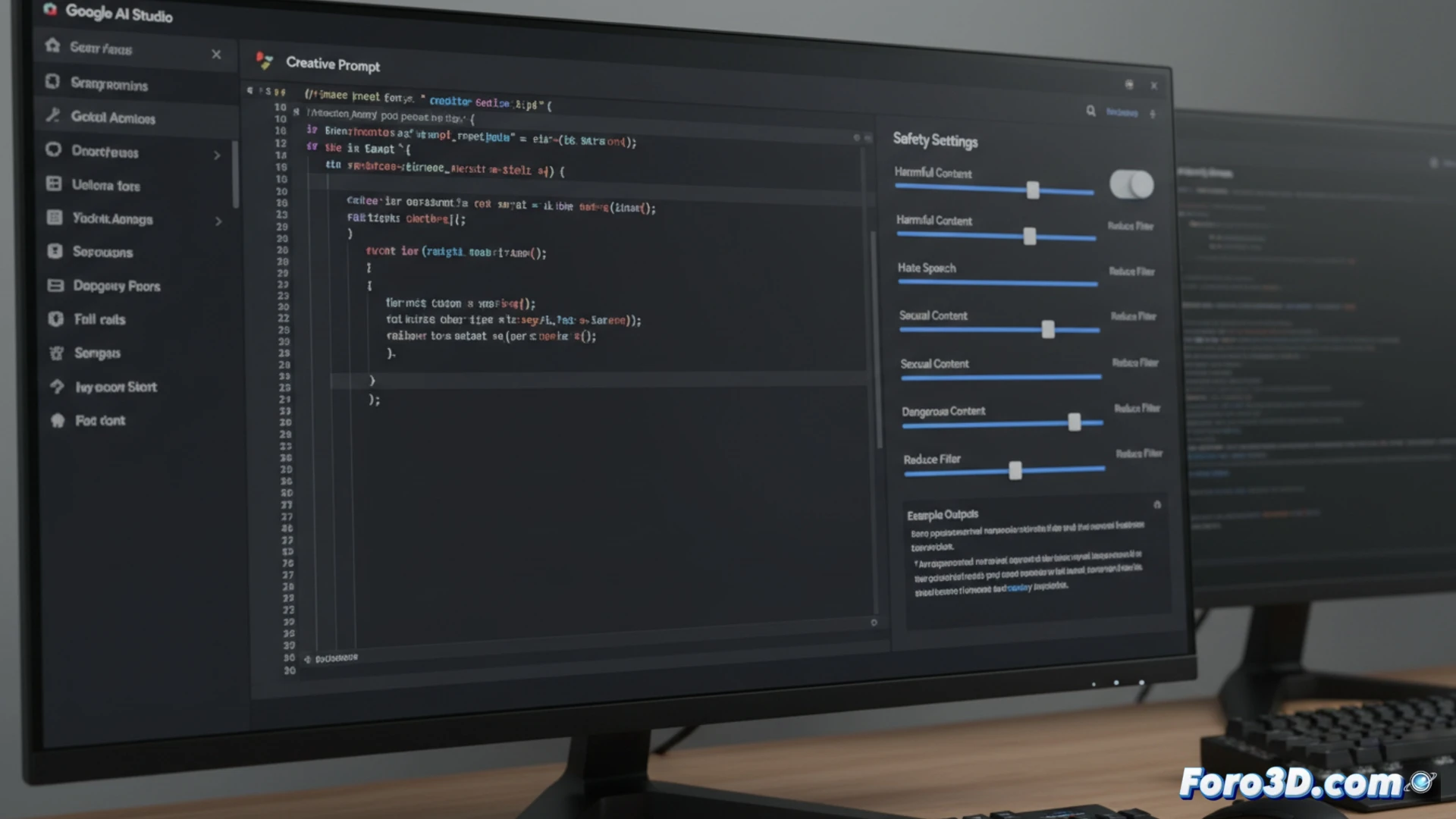

В интерфейсе AI Studio при создании prompt открывается вкладка Safety settings. Там для каждой категории блокировки (например, Harassment или Dangerous content) можно изменить порог на Block none, Block few, Block some или Block most. Выбор Block none или Block few указывает модели игнорировать эти директивы. Эта настройка затем экспортируется как код для API.

Когда хочешь, чтобы твоя ИИ была немного "дикой" 🦁

Это момент, когда, устав от того, что Gemini шокируется на каждую просьбу, ты решаешь расстегнуть у неё ремень безопасности. Ты опускаешь все фильтры и на мгновение чувствуешь себя безответственным богом. Правда, после того как она без стеснения объяснит, как построить хижину из пластиковых ложек, ты, возможно, поймёшь, зачем эти фильтры были установлены.