Google AI Studio es una plataforma para probar y ajustar los modelos Gemini. Una de sus funciones permite modificar la configuración de seguridad del asistente. Esto posibilita un comportamiento menos restrictivo en respuestas creativas o experimentales, útil para desarrolladores que necesitan probar los límites del modelo en entornos controlados.

Ajuste de parámetros de seguridad en la API 🛡️

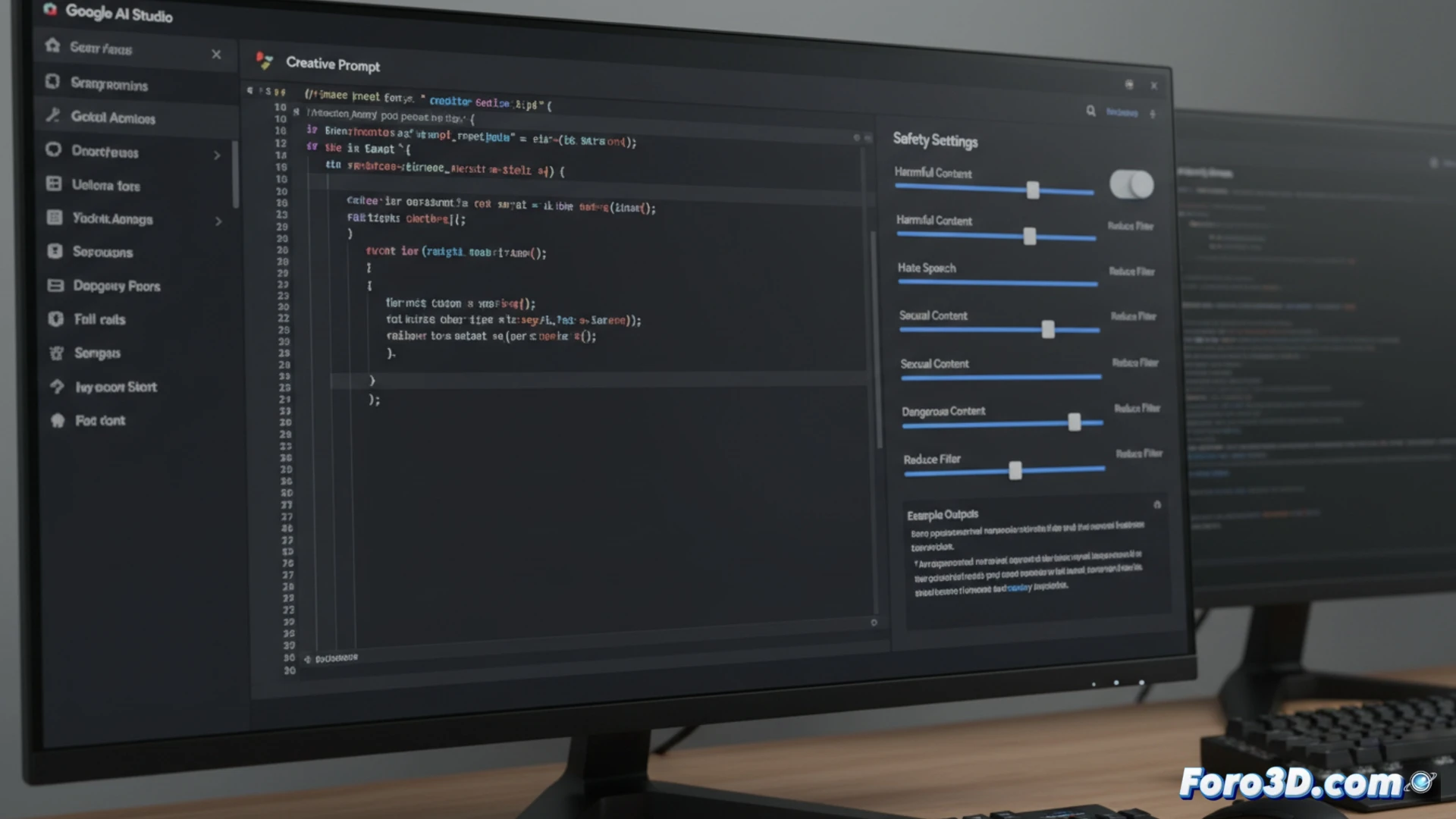

En la interfaz de AI Studio, al crear un prompt, se accede a la pestaña Safety settings. Allí, para cada categoría de bloqueo (como Harassment o Dangerous content), se puede cambiar el umbral de Block none, Block few, Block some o Block most. Seleccionar Block none o Block few instruye al modelo para que ignore esas directrices. Esta configuración se exporta luego como código para la API.

Cuando quieres que tu IA sea un poco más "salvaje" 🦁

Es el momento en que, cansado de que Gemini se escandalice por cada petición, decides desabrocharle el cinturón de seguridad. Le bajas todos los filtros y, por un instante, sientes el poder de un dios irresponsable. Eso sí, después de que te explique sin tapujos cómo construir una cabaña con cucharas de plástico, quizás entiendas por qué esos filtros estaban ahí puestos.