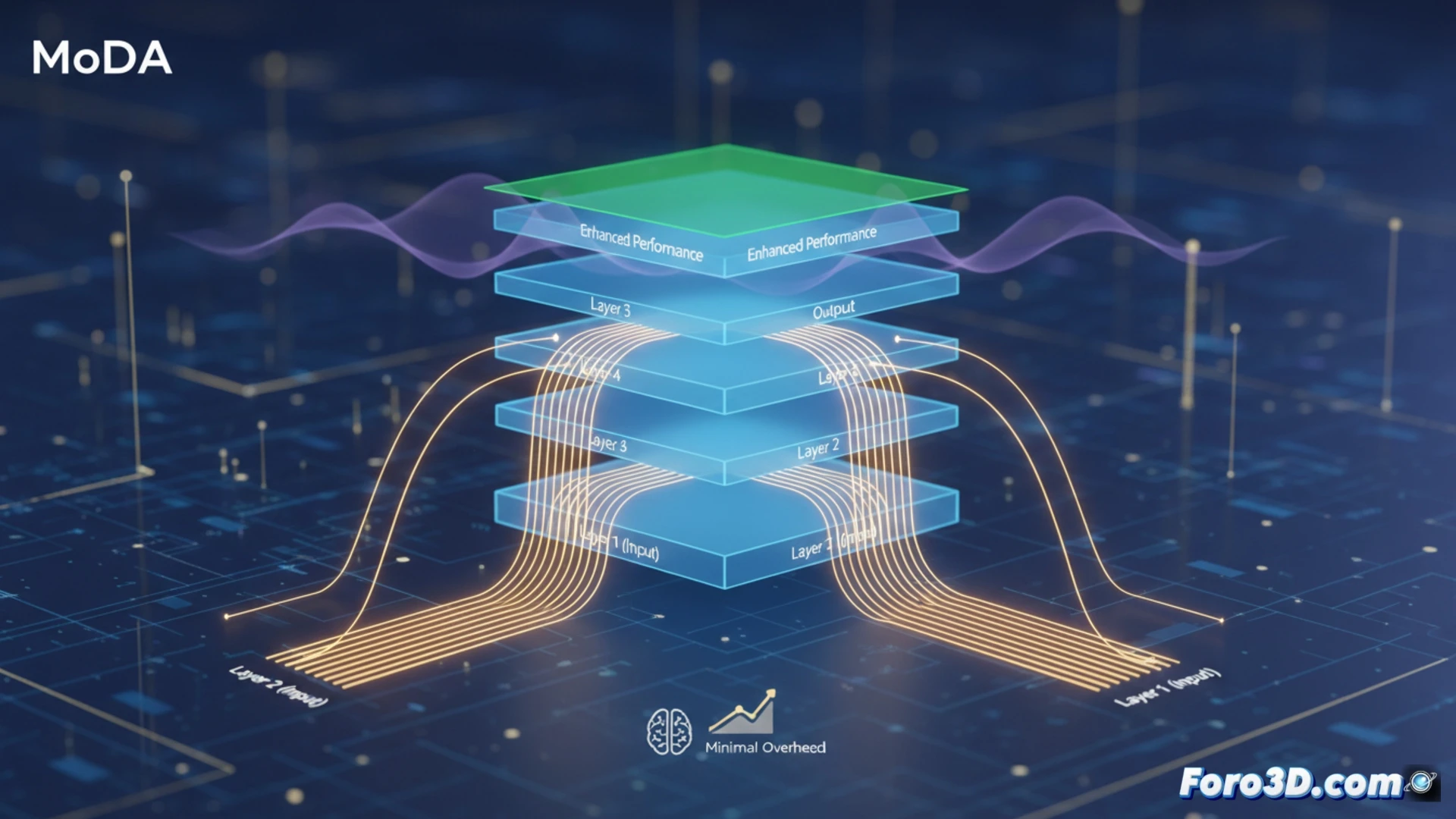

Масштабирование глубины больших моделей языка является ключом к их способности, но имеет проблему: деградацию сигнала. По мере того как информация проходит через десятки или сотни слоев, полезные признаки, сформированные в первых, разбавляются, теряясь в более глубоких. Новое исследование предлагает Mixture-of-Depths Attention (MoDA), инновационный механизм, который позволяет головкам внимания обращаться не только к текущему слою, но и к ключевой информации из предыдущих слоев, тем самым сохраняя важные сигналы и улучшая производительность модели с минимальной вычислительной нагрузкой.

Как работает MoDA и её эффективная реализация 🤖

Технически MoDA модифицирует стандартное внимание. В каждом слое каждая головка внимания может обращаться к двум наборам пар ключ-значение: набору последовательности в текущем слое и дополнительному набору в глубину, извлечённому из предыдущих слоев. Это позволяет восстанавливать и усиливать информативные характеристики, которые иначе бы разбавились. Чтобы это было практически, исследователи разработали аппаратно-эффективный алгоритм, который решает проблему неконтинуальных обращений к памяти, достигая 97.3% эффективности FlashAttention-2 на длинных последовательностях из 64K токенов. Это делает MoDA жизнеспособной для обучения в большом масштабе.

Импликации для будущего глубоких моделей 🚀

Результаты многообещающи: в моделях с 1.5B параметров MoDA улучшает перплексию и производительность в последующих задачах всего с 3.7% перегрузкой в FLOPs. Кроме того, она работает лучше с нормализацией после слоя, распространённой конфигурацией. Это предполагает, что MoDA — не просто заплата, а фундаментальный архитектурный примитив для более эффективного масштабирования глубины. Её эффективность открывает дверь к более глубоким и способным моделям без запретительных вычислительных затрат, ускоряя разработку более мощных и доступных LLMs.

Как техника MoDA может решить проблему деградации сигнала в глубоких LLMs и какие импликации это имеет для разработки более способных и доступных искусственных интеллектов?

(PD: технологические прозвища как дети: ты их называешь, но сообщество решает, как их звать)