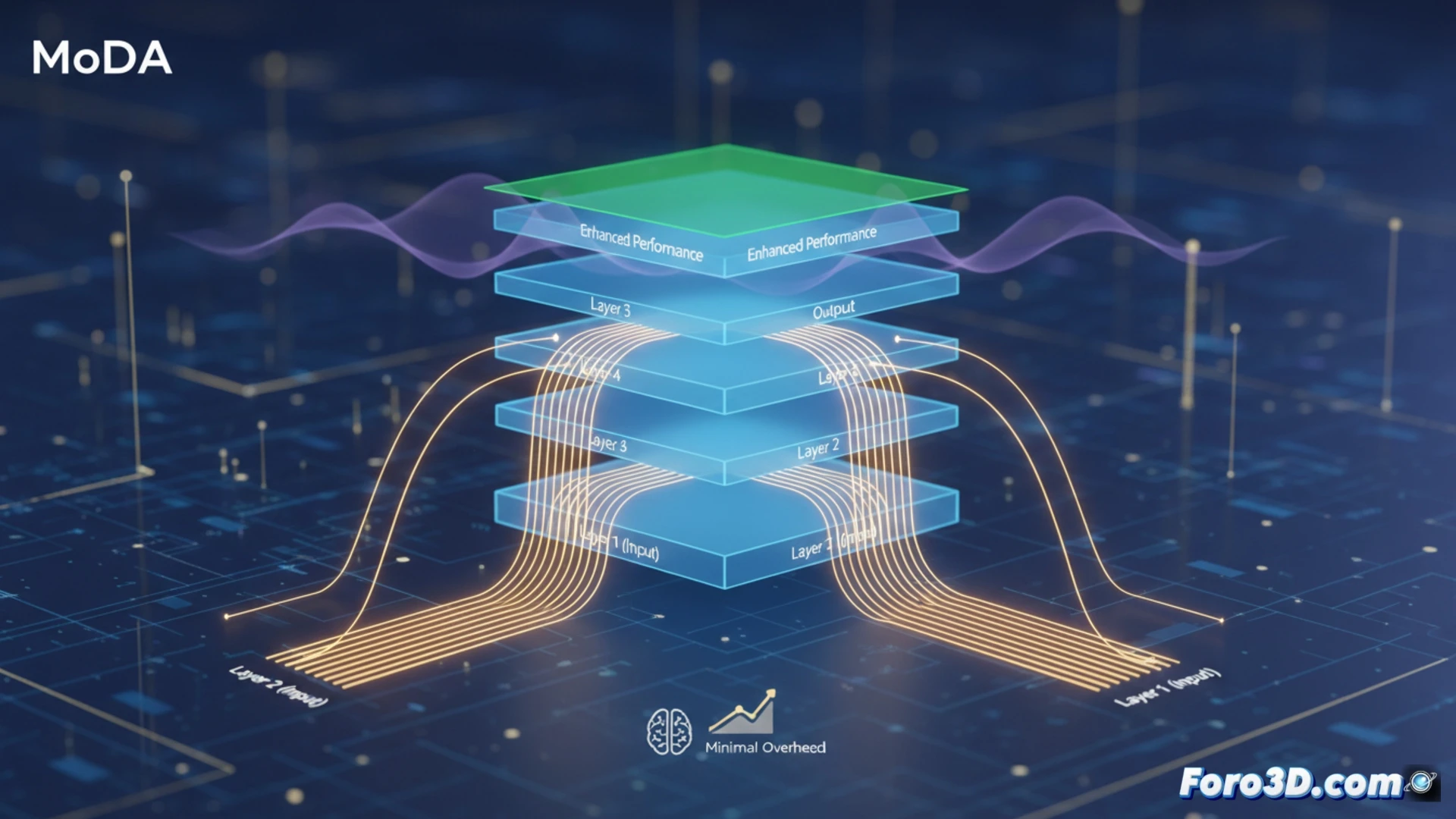

Escalar la profundidad de los modelos de lenguaje grandes es clave para su capacidad, pero tiene un problema: la degradación de la señal. A medida que la información atraviesa decenas o cientos de capas, los rasgos útiles formados en las primeras se diluyen, perdiéndose en las más profundas. Una nueva investigación propone Mixture-of-Depths Attention (MoDA), un mecanismo innovador que permite a las cabezas de atención acceder no solo a la capa actual, sino también a información clave de capas anteriores, preservando así las señales importantes y mejorando el rendimiento del modelo con una sobrecarga computacional mínima.

Cómo Funciona MoDA y su Implementación Eficiente 🤖

Técnicamente, MoDA modifica la atención estándar. En cada capa, cada cabeza de atención puede atender a dos conjuntos de pares clave-valor: el de la secuencia en la capa actual y un conjunto en profundidad extraído de capas precedentes. Esto permite recuperar y reforzar características informativas que de otro modo se habrían diluido. Para que esto sea práctico, los investigadores desarrollaron un algoritmo eficiente en hardware que resuelve el problema de los accesos no contiguos a memoria, logrando un 97.3% de la eficiencia de FlashAttention-2 en secuencias largas de 64K tokens. Esto hace a MoDA viable para entrenamiento a gran escala.

Implicaciones para el Futuro de los Modelos Profundos 🚀

Los resultados son prometedores: en modelos de 1.5B de parámetros, MoDA mejora la perplejidad y el rendimiento en tareas posteriores con solo un 3.7% de sobrecarga en FLOPs. Además, funciona mejor con normalización posterior a la capa, una configuración común. Esto sugiere que MoDA no es solo un parche, sino un primitivo arquitectónico fundamental para escalar la profundidad de manera más efectiva. Su eficiencia abre la puerta a modelos más profundos y capaces sin costes computacionales prohibitivos, acelerando el desarrollo de LLMs más potentes y accesibles.

¿Cómo puede la técnica MoDA resolver el problema de la degradación de la señal en LLMs profundos y qué implicaciones tiene esto para el desarrollo de inteligencias artificiales más capaces y accesibles?

(PD: los apodos tecnológicos son como los hijos: tú los nombras, pero la comunidad decide cómo llamarlos)