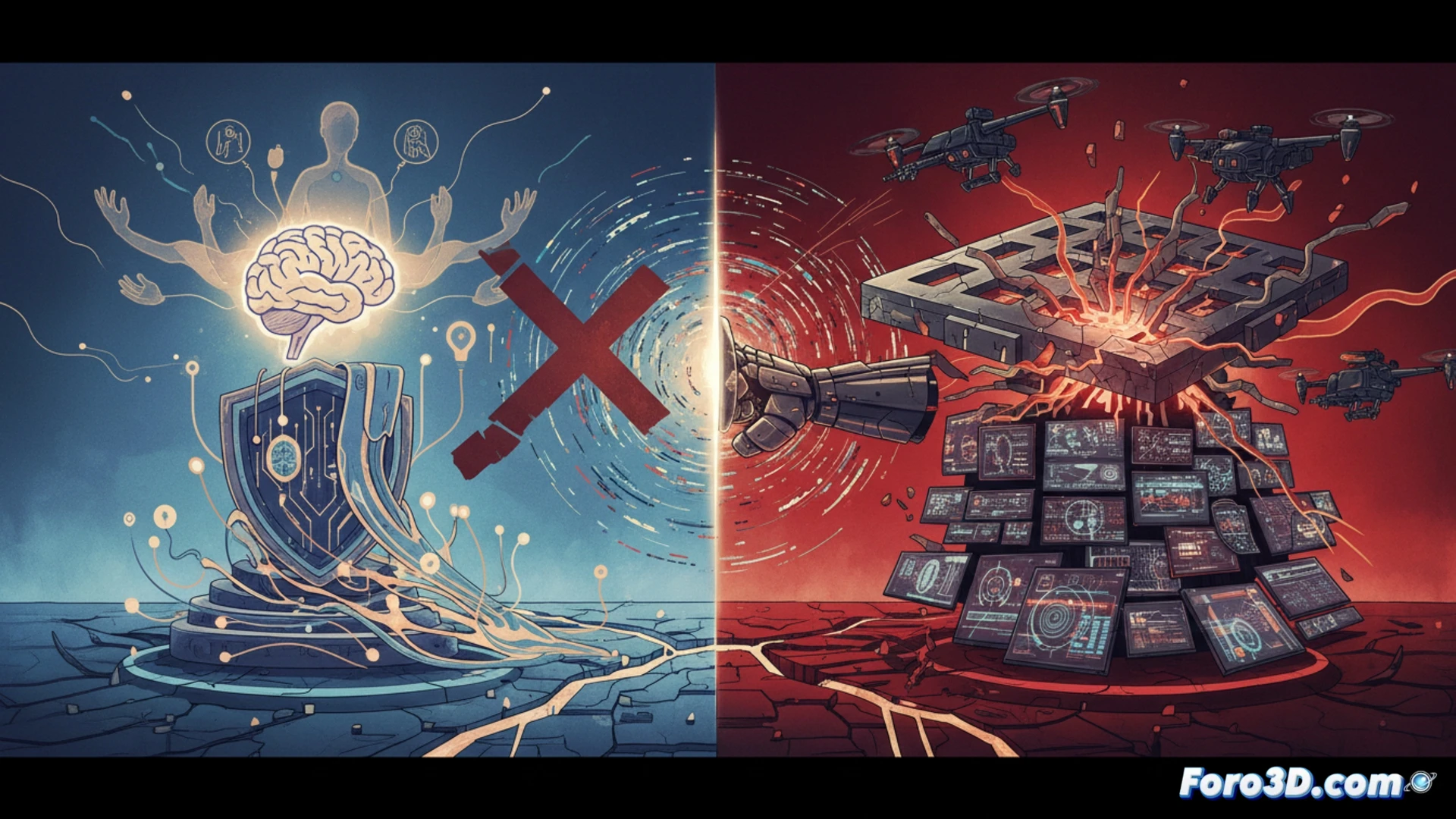

В беспрецедентном шаге Министерство обороны США обозначило компанию по искусственному интеллекту Anthropic как риск для цепочки поставок национальной безопасности. Эта мера, обычно предназначенная для иностранных противников, запрещает компании и её партнёрам работать с правительством. Конфликт возник из-за неразрешимого этического столкновения: Anthropic отказалась разрешить использование своей ИИ для массового наблюдения или автономного оружия, бросив вызов требованиям Пентагона и поставив под угрозу свою собственную экономическую жизнеспособность.

Обозначение как риск цепочки поставок: юридические и операционные последствия ⚖️

Официальное обозначение как риск для цепочки поставок национальной безопасности — это не мелкая санкция. Это мощный юридический инструмент, который фактически исключает Anthropic из любого контракта с Министерством обороны и другими ключевыми агентствами. Это выходит за рамки простого отказа в тендере; это широкое запрещение, распространяющееся на её коммерческих партнёров, изолируя компанию от огромного рынка. Решение Anthropic оспорить меру в судах создаст ключевой прецедент. Судебный процесс определит границы власти правительства наказывать компании, которые по самообъявленным этическим причинам отказываются сотрудничать в проектах национальной безопасности, и проверит корпоративную автономию в разработке технологий двойного назначения.

Опасный прецедент для отрасли ИИ ⚠️

Этот случай выходит за рамки Anthropic и устанавливает тревожный прецедент для всей технологической отрасли. Он сигнализирует, что приоритет жёстким этическим принципам, особенно в чувствительных областях, таких как летальная автономия или наблюдение, может повлечь экзистенциальную экономическую цену. Мера Пентагона может заставить другие стартапы выбирать между своей моральной компасом и коммерческим выживанием, затормозив ответственную инновацию и подтолкнув разработку критически важной ИИ к менее скрупулёзным акторам или соперничающим державам. Возникающая юридическая битва определит будущее этического управления ИИ и хрупкий баланс между государственной безопасностью и корпоративной свободой совести.

Насколько сильно должна приоритетизироваться национальная безопасность над этикой в разработке продвинутого искусственного интеллекта?

(ПС: пытаться забанить никнейм в интернете — это как пытаться загородить солнце пальцем... но в цифровом мире)