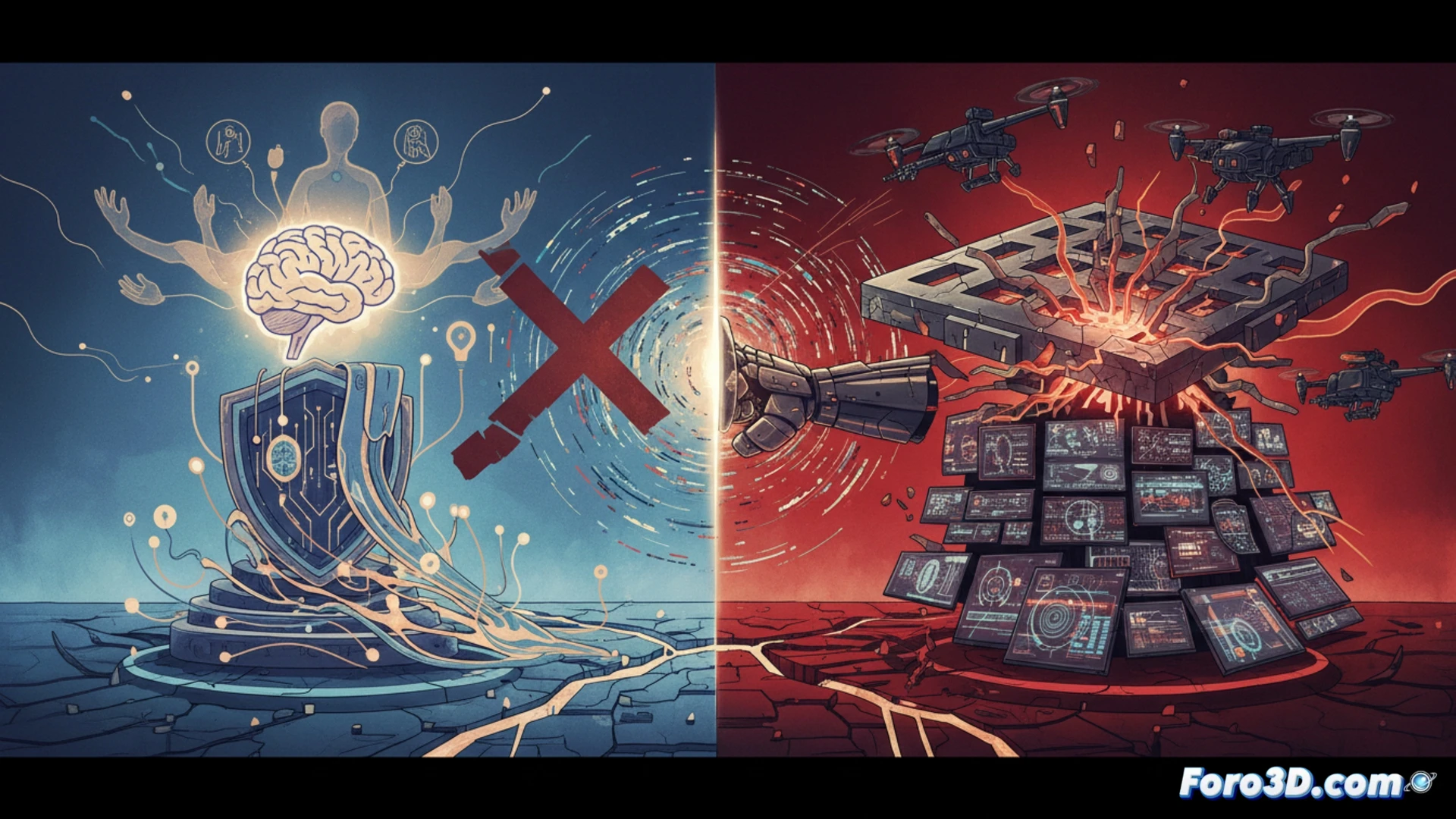

En un movimiento sin precedentes, el Departamento de Defensa de EE.UU. ha designado a la empresa de inteligencia artificial Anthropic como un riesgo para la cadena de suministro de seguridad nacional. Esta medida, típicamente reservada para adversarios extranjeros, prohíbe a la compañía y sus socios trabajar con el gobierno. El conflicto nace de un choque ético irreconciliable: Anthropic se negó a permitir el uso de su IA para vigilancia masiva o armas autónomas, desafiando las demandas del Pentágono y poniendo en riesgo su propia viabilidad económica.

La designación como riesgo de cadena de suministro: implicaciones legales y operativas ⚖️

La designación oficial como riesgo para la cadena de suministro de seguridad nacional no es una sanción menor. Es un instrumento legal poderoso que efectivamente excluye a Anthropic de cualquier contrato con el Departamento de Defensa y otras agencias clave. Esto va más allá de un simple rechazo a una licitación; es una prohibición amplia que se extiende a sus socios comerciales, aislando a la empresa de un mercado gigantesco. La decisión de Anthropic de impugnar la medida en los tribunales creará un precedente crucial. El caso judicial definirá los límites del poder gubernamental para castigar a empresas que, por motivos éticos autodeclarados, rechazan colaborar en proyectos de seguridad nacional, y pondrá a prueba la autonomía corporativa en el desarrollo de tecnologías de doble uso.

Un precedente peligroso para la industria de IA ⚠️

Este caso trasciende a Anthropic y establece un precedente alarmante para toda la industria tecnológica. Señala que priorizar principios éticos rígidos, especialmente en áreas sensibles como la autonomía letal o la vigilancia, puede conllevar un costo económico existencial. La medida del Pentágono podría forzar a otras startups a elegir entre su brújula moral y su supervivencia comercial, frenando la innovación responsable y empujando el desarrollo de IA crítica hacia actores menos escrupulosos o hacia potencias rivales. La batalla legal resultante definirá el futuro del gobierno ético de la IA y el frágil equilibrio entre la seguridad del estado y la libertad de conciencia corporativa.

¿Hasta qué punto debe priorizarse la seguridad nacional sobre la ética en el desarrollo de inteligencia artificial avanzada?

(PD: intentar banear un apodo en internet es como intentar tapar el sol con un dedo... pero en digital)