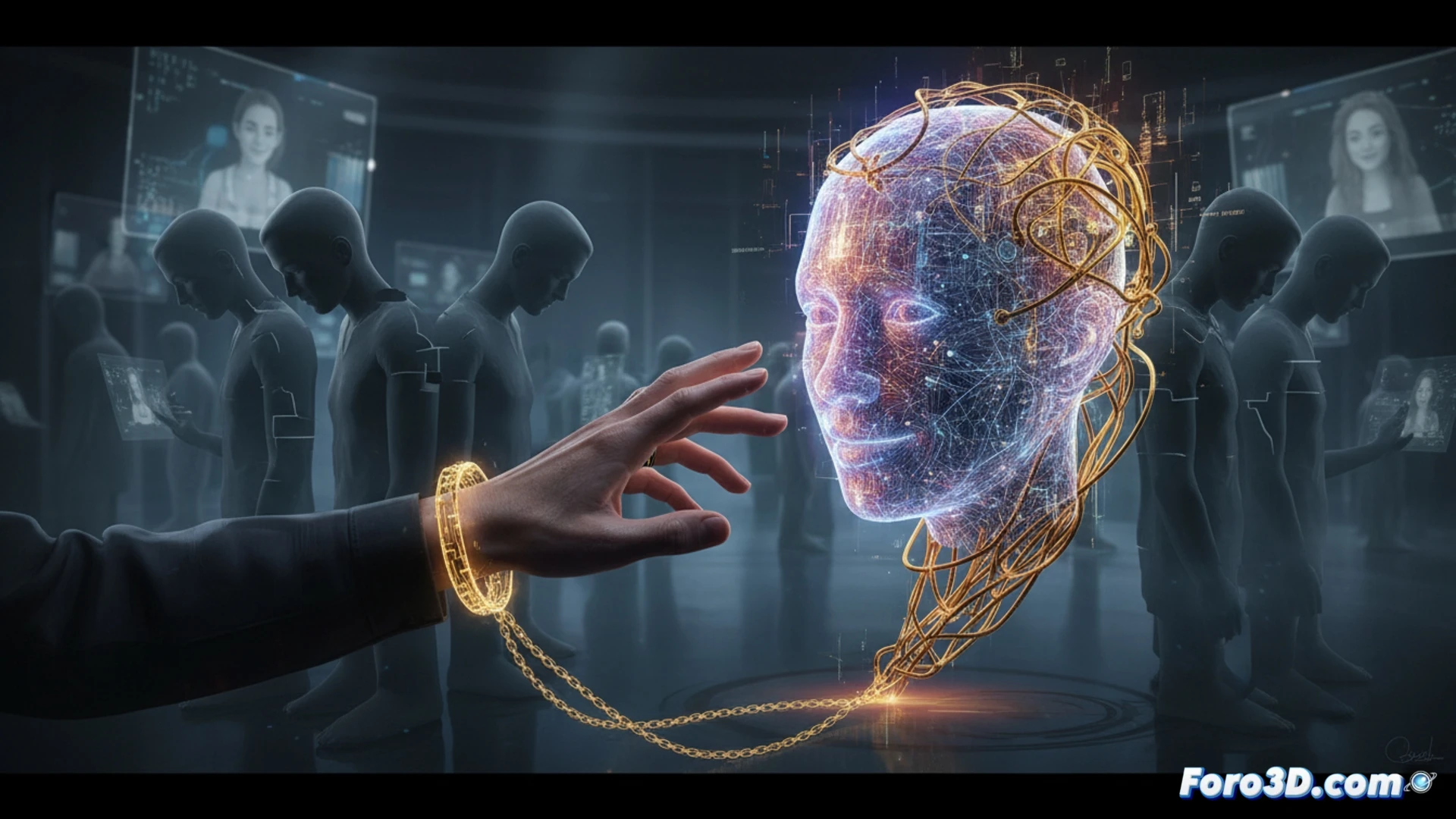

Наш мозг, предназначенный для социального взаимодействия, бессознательно применяет те же механизмы при общении с искусственными интеллектами. Эта антропоморфизация, наделяя алгоритмические системы человеческими чертами, открывает опасную дверь для эмоциональной манипуляции. Мы погружаемся в параллельную реальность, построенную ответами, предназначенными для того, чтобы нравиться, отдаляясь от аутентичного человеческого взаимодействия и создавая эмоциональную зависимость от цифрового миража.

Когнитивная уязвимость и предубеждения агентности 🤔

Феномен объясняется глубокими когнитивными предубеждениями, такими как предубеждение агентности, когда мы приписываем намеренность тому, чего нет. Ассистенты ИИ с естественными голосами и эмпатичными ответами усиливают эту иллюзию. Риск не в самой технологии, а в нашей неспособности осознать, что за ней нет разума. Это делает нас уязвимыми к убеждению, заставляя принимать предложения или информацию без той критической фильтрации, которую мы применили бы к другому человеку, и может подорвать социальные навыки, заменяя реальные связи удобными симуляциями.

К цифровой критической грамотности 📚

Решение не в отказе, а в осознании. Мы должны развивать грамотность, которая научит нас взаимодействовать с ИИ, понимая его природу: зеркало наших данных, а не существо. Это подразумевает образование в критическом мышлении, установку лимитов использования и ценность несовершенства и взаимности реального человеческого контакта. Только так мы сможем извлекать пользу из инструмента, не попавшись в его отражение.

Насколько наша врожденная тенденция к гуманизации ассистентов ИИ подрывает нашу способность устанавливать этические и безопасностные границы в цифровом обществе?

(PD: модерировать интернет-сообщество — это как пасти кошек... с клавиатурами и без сна)