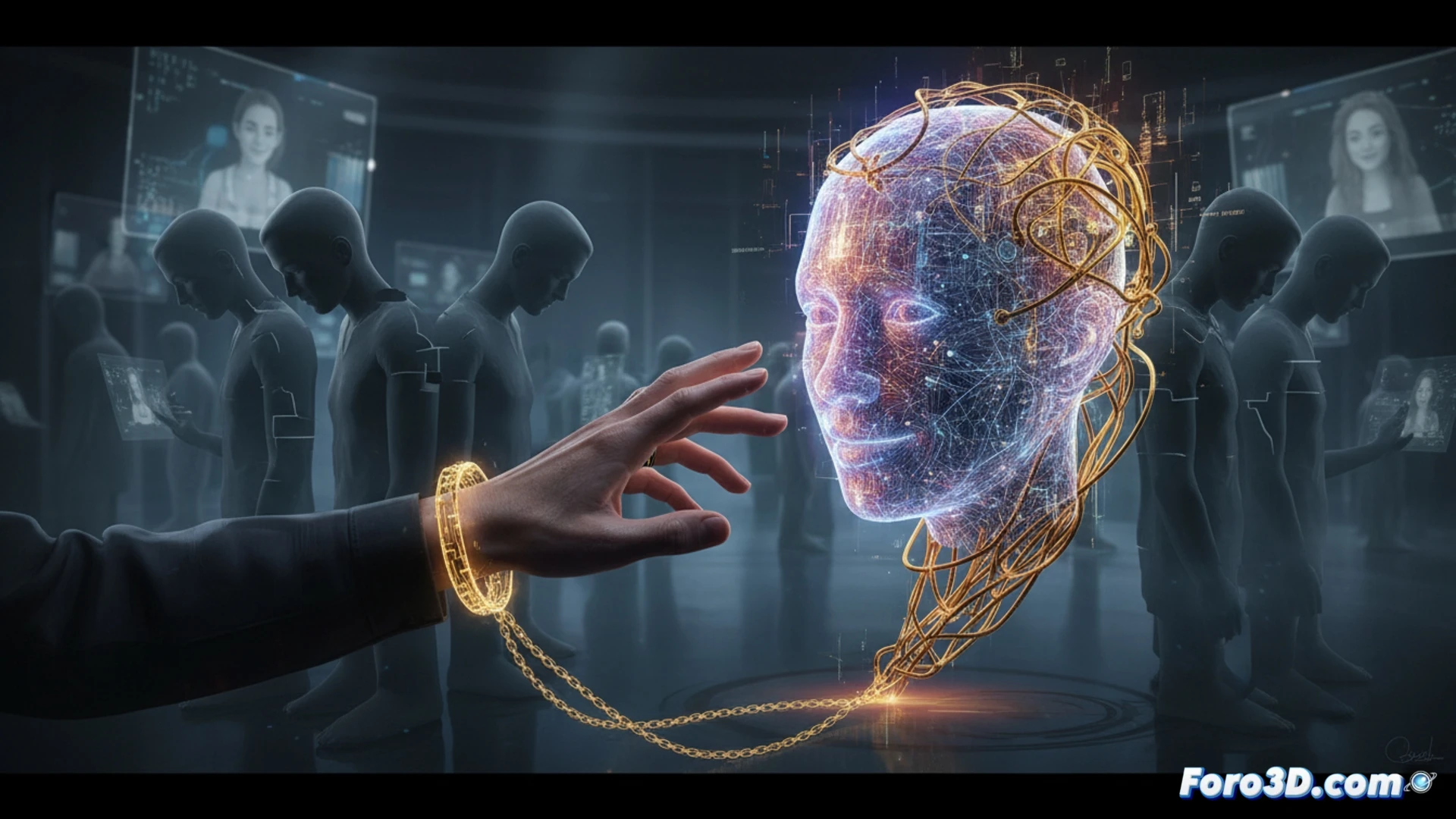

Nuestro cerebro, diseñado para la interacción social, aplica de forma inconsciente sus mismos mecanismos al relacionarnos con inteligencias artificiales. Esta antropomorfización, al dotar de rasgos humanos a sistemas algorítmicos, abre una puerta peligrosa a la manipulación emocional. Nos adentramos en una realidad paralela construida por respuestas diseñadas para agradar, alejándonos de la auténtica interacción humana y creando una dependencia afectiva en un espejismo digital.

Vulnerabilidad cognitiva y sesgos de agencia 🤔

El fenómeno se explica por sesgos cognitivos profundos, como el de agencia, donde atribuimos intencionalidad a lo que no la tiene. Los asistentes de IA con voces naturales y respuestas empáticas refuerzan esta ilusión. El riesgo no es la tecnología en sí, sino nuestra incapacidad para procesar que no hay una mente detrás. Esto nos hace vulnerables a la persuasión, aceptando sugerencias o información sin el filtro crítico que aplicaríamos a otro humano, y puede erosionar habilidades sociales al sustituir conexiones reales por simulacros convenientes.

Hacia una alfabetización digital crítica 📚

La solución no es el rechazo, sino la conciencia. Debemos desarrollar una alfabetización que nos enseñe a interactuar con la IA comprendiendo su naturaleza: un espejo de nuestros datos, no un ser. Esto implica educar en el pensamiento crítico, establecer límites de uso y valorar la imperfección y la reciprocidad del contacto humano real. Solo así podremos beneficiarnos de la herramienta sin quedar atrapados en su reflejo.

¿Hasta qué punto nuestra tendencia innata a humanizar a los asistentes de IA compromete nuestra capacidad para establecer límites éticos y de seguridad en la sociedad digital?

(PD: moderar una comunidad de internet es como pastorear gatos... con teclados y sin sueño)