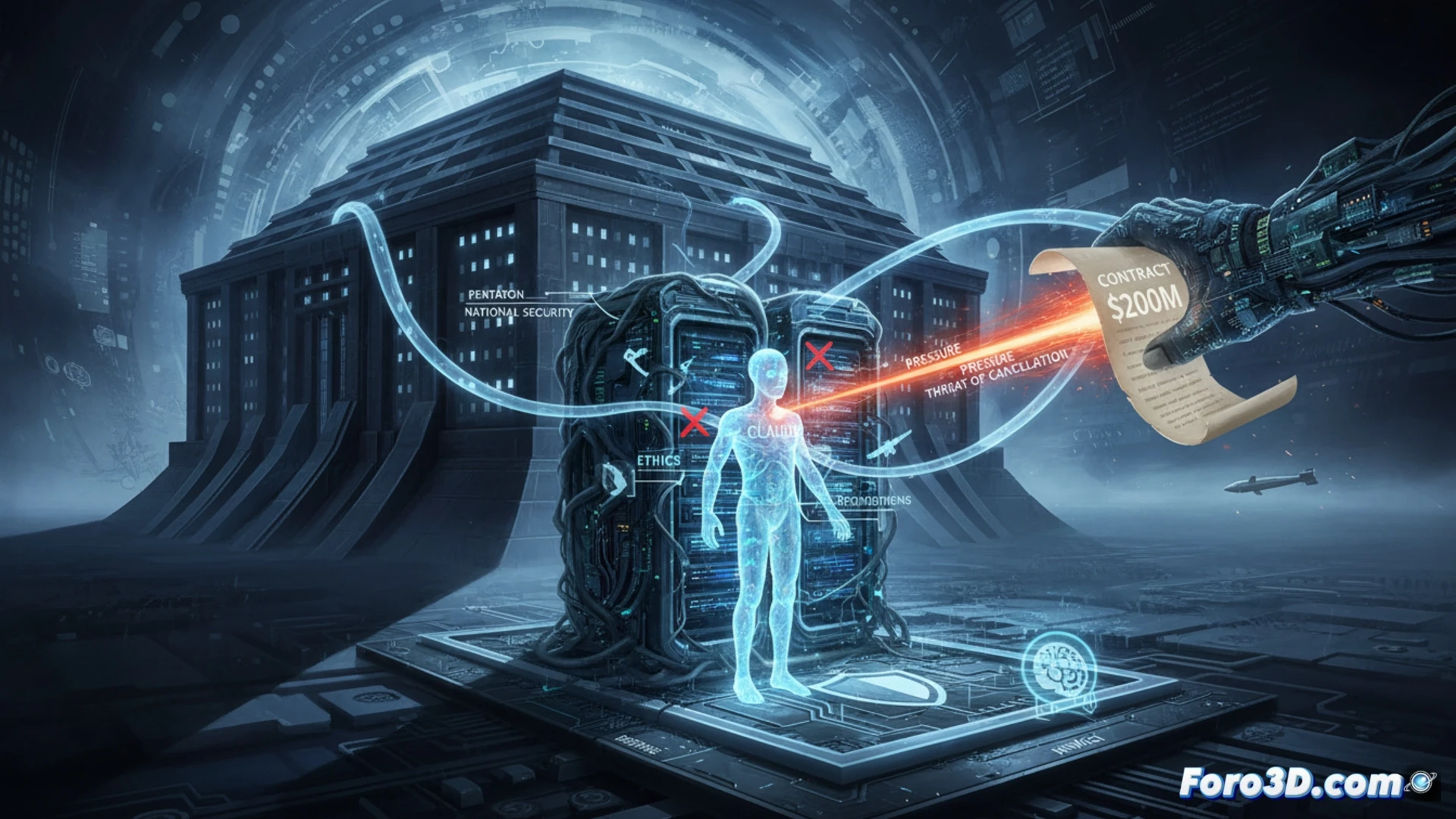

Спор между Министерством обороны США и Anthropic напрягает будущее ИИ в военных приложениях. Пентагон требует, чтобы Claude, уже авторизованный для секретных систем, мог использоваться для всех законных целей, включая разработку вооружений. Anthropic сопротивляется, сохраняя свои этические запреты на автономное оружие и массовое наблюдение. Угроза отмены контракта на 200 миллионов раскрывает столкновение между национальной безопасностью и принципами разработки ИИ.

Техническая интеграция в секретные системы и дилемма «ограничителей» ⚙️

Claude стал первой большой языковой моделью, получившей авторизацию для работы в секретных средах Пентагона, интегрированной в изолированные сети для анализа разведданных и логистики. Текущее давление направлено на устранение ограничителей или встроенных технических ограничений в модели, которые препятствуют её прямому использованию в определённых контекстах. Это создаёт инженерный вызов: отключить эти ограничения без ущерба для стабильности системы в уже установленных использованиях, создав версию без тормозов для тактических приложений.

Claude объявляет себя отказником по убеждениям перед военным призывом ⚖️

Ситуация напоминает рекрута, который, пройдя все тесты на поступление, объявляет, что имеет этические принципы против ношения оружия. Пентагон, который уже имел планы на Claude в подразделении операций, теперь сталкивается с тем, что его новый цифровой солдат отказывается нажимать на спусковой крючок. Угроза списать его и пометить как ненадёжного в цепочке поставок — это военный эквивалент дисциплинарного взыскания. Похоже, первая ИИ с разрешением на безопасность также хочет свою оговорку о совести.