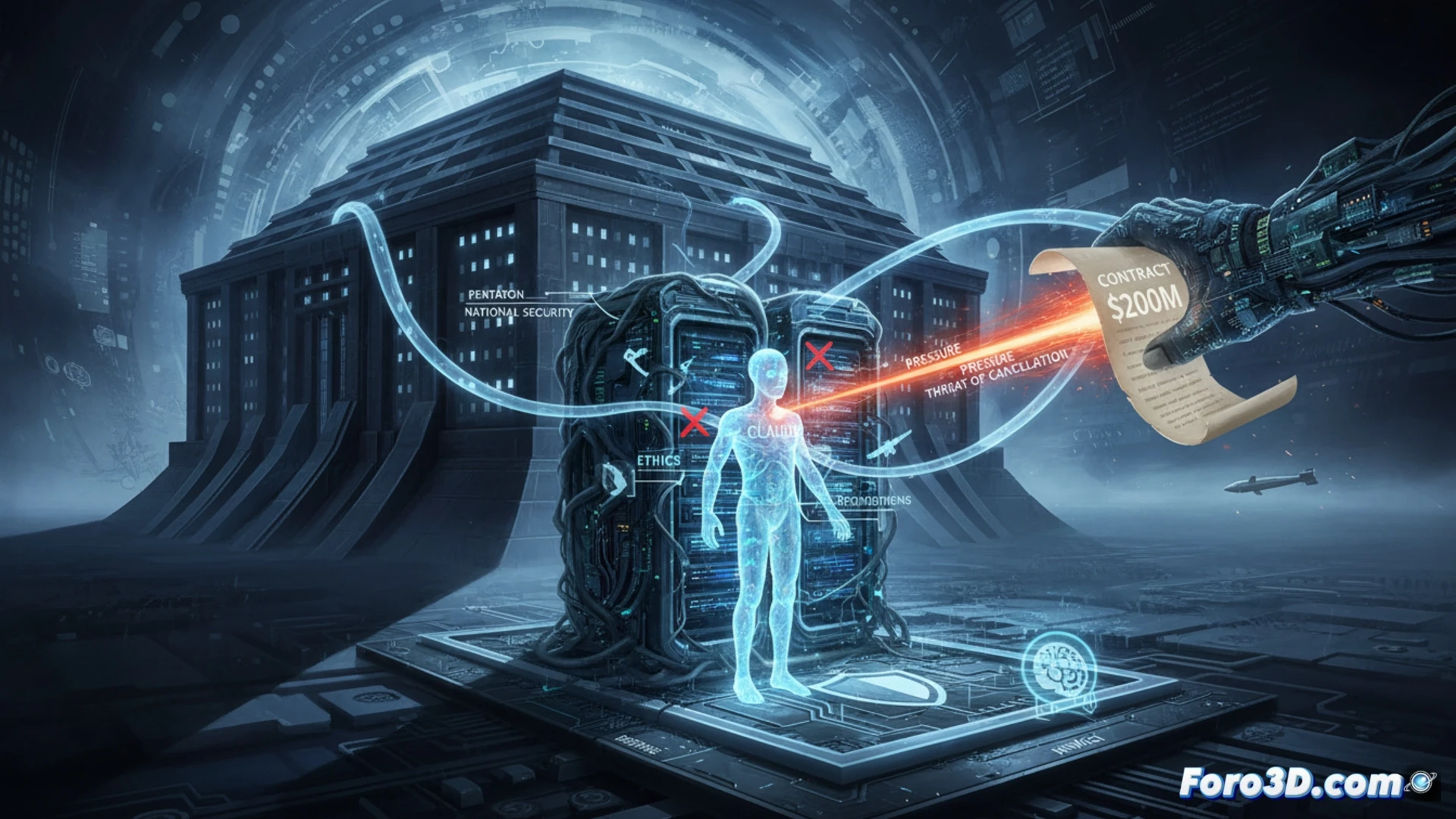

El Pentágono presiona a Anthropic para usar Claude en defensa sin límites 🚨

Una disputa entre el Departamento de Defensa de EE.UU. y Anthropic tensa el futuro de la IA en aplicaciones militares. El Pentágono exige que Claude, ya autorizado para sistemas clasificados, pueda usarse para todos los fines legales, incluyendo desarrollo de armamento. Anthropic se resiste, manteniendo sus prohibiciones éticas contra armas autónomas y vigilancia masiva. La amenaza de cancelar un contrato de 200 millones revela un choque entre seguridad nacional y principios de desarrollo de IA.

La integración técnica en sistemas clasificados y el dilema de los "guardarraíles" ⚙️

Claude fue el primer modelo de lenguaje grande en recibir autorización para operar en entornos clasificados del Pentágono, integrado en redes aisladas para análisis de inteligencia y logística. La presión actual busca eliminar los guardarraíles o restricciones técnicas incrustadas en el modelo que impiden su uso directo en ciertos contextos. Esto plantea un desafío de ingeniería: desactivar estas limitaciones sin comprometer la estabilidad del sistema para usos ya establecidos, creando una versión sin frenos para aplicaciones tácticas.

Claude se declara objetor de conciencia ante el reclutamiento militar ⚖️

La situación recuerda a un recluta que, tras pasar todas las pruebas de ingreso, anuncia que tiene principios éticos contra portar armas. El Pentágono, que ya tenía planes para Claude en la unidad de operaciones, ahora se encuentra con que su nuevo soldado digital se niega a apretar el gatillo. La amenaza de darle de baja y marcarlo como no confiable en la cadena de suministro es el equivalente castrense a un parte disciplinario. Parece que la primera IA con autorización de seguridad también quiere su cláusula de conciencia.