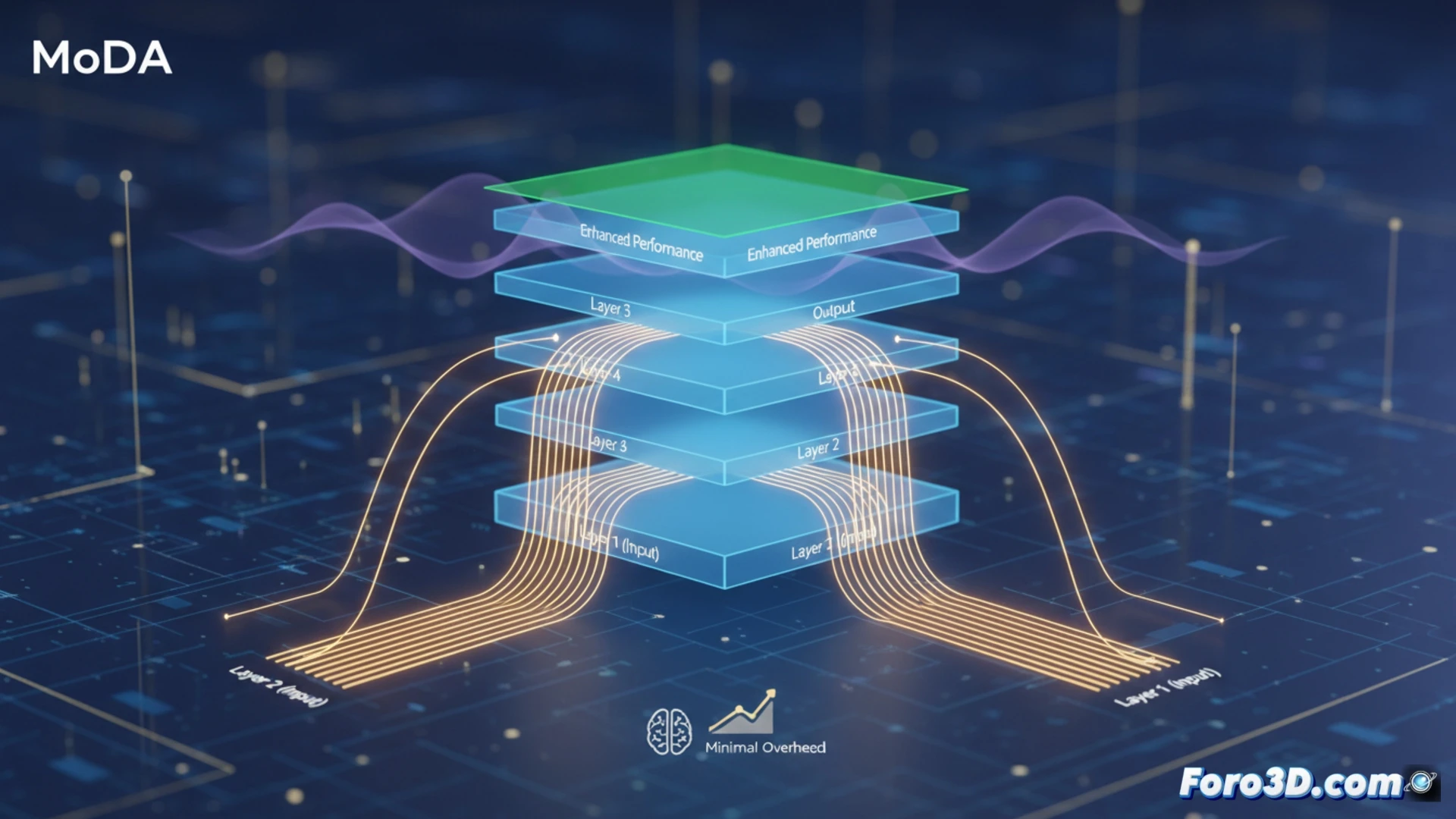

Escalar a profundidade dos modelos de linguagem grandes é chave para sua capacidade, mas tem um problema: a degradação do sinal. À medida que a informação atravessa dezenas ou centenas de camadas, os traços úteis formados nas primeiras se diluem, perdendo-se nas mais profundas. Uma nova pesquisa propõe Mixture-of-Depths Attention (MoDA), um mecanismo inovador que permite às cabeças de atenção acessar não só a camada atual, mas também a informação chave de camadas anteriores, preservando assim os sinais importantes e melhorando o desempenho do modelo com uma sobrecarga computacional mínima.

Como Funciona o MoDA e sua Implementação Eficiente 🤖

Tecnicamente, o MoDA modifica a atenção padrão. Em cada camada, cada cabeça de atenção pode atender a dois conjuntos de pares chave-valor: o da sequência na camada atual e um conjunto em profundidade extraído de camadas precedentes. Isso permite recuperar e reforçar características informativas que de outro modo se teriam diluído. Para que isso seja prático, os pesquisadores desenvolveram um algoritmo eficiente em hardware que resolve o problema dos acessos não contíguos à memória, alcançando 97,3% da eficiência do FlashAttention-2 em sequências longas de 64K tokens. Isso torna o MoDA viável para treinamento em grande escala.

Implicações para o Futuro dos Modelos Profundos 🚀

Os resultados são promissores: em modelos de 1,5B de parâmetros, o MoDA melhora a perplexidade e o desempenho em tarefas posteriores com apenas 3,7% de sobrecarga em FLOPs. Além disso, funciona melhor com normalização posterior à camada, uma configuração comum. Isso sugere que o MoDA não é só um remendo, mas um primitivo arquitetônico fundamental para escalar a profundidade de maneira mais efetiva. Sua eficiência abre a porta a modelos mais profundos e capazes sem custos computacionais proibitivos, acelerando o desenvolvimento de LLMs mais potentes e acessíveis.

Como a técnica MoDA pode resolver o problema da degradação do sinal em LLMs profundos e quais implicações isso tem para o desenvolvimento de inteligências artificiais mais capazes e acessíveis?

(PD: os apelidos tecnológicos são como os filhos: você os nomeia, mas a comunidade decide como chamá-los)