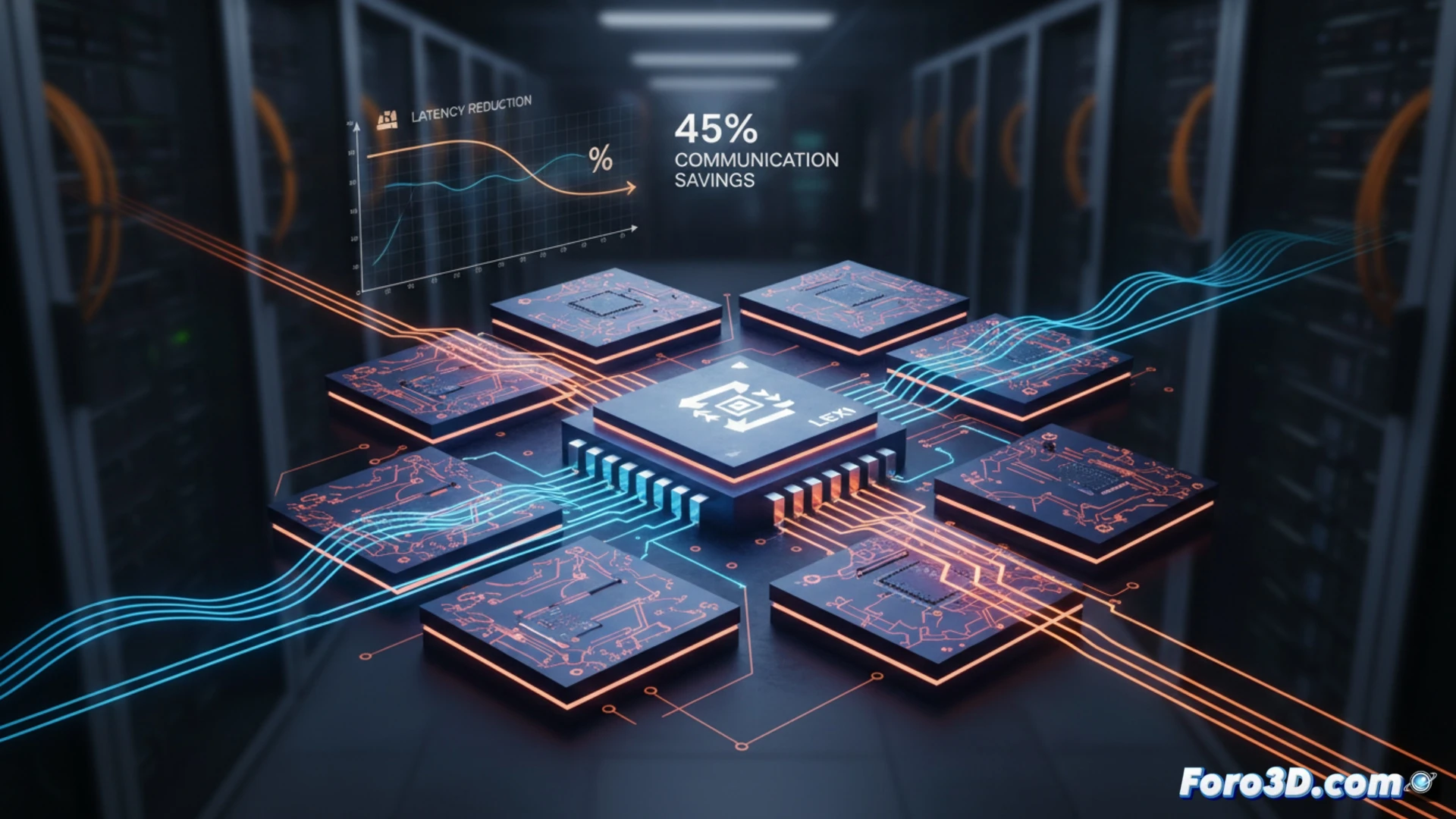

A inferência em modelos de linguagem grandes (LLM) é prejudicada pelo gargalo no movimento de dados entre chiplets. Como esses modelos usam predominantemente o formato BF16, uma análise revela que os fluxos de expoentes possuem uma entropia muito baixa, inferior a 3 bits, o que os torna altamente comprimíveis. Apresentamos LEXI, um esquema de compressão sem perdas para expoentes baseado em Huffman, que atua diretamente na rede em chip (NoC). Ao comprimir ativações, caches e pesos, LEXI reduz a comunicação e a latência total de inferência entre 33-45% e 30-35%, respectivamente, em arquiteturas homogêneas de chiplets, com um custo de área e energia mínimo.

Arquitetura e Implementação do Codec LEXI na NoC 🧠

LEXI se integra diretamente nos roteadores da rede em chip. Pequenos codecs são posicionados nas portas de entrada e saída, comprimindo e descomprimindo os expoentes dos dados BF16 em tempo real. A chave está em sua implementação hardware eficiente: utiliza decodificadores baseados em tabelas de busca (LUT) multilinha que mantêm a largura de banda máxima do enlace, evitando que a compressão introduza atrasos. Os pesos são armazenados comprimidos em memória e descomprimidos logo antes do cálculo no núcleo tensor. Fabricado em tecnologia GF de 22 nm, o overhead deste sistema é de apenas 0.09% em área e consumo energético, um custo marginal para um ganho substancial em desempenho do sistema.

Impacto no Futuro do Design 3D de Semicondutores para IA 🚀

LEXI transcende uma simples técnica de compressão; representa uma mudança de paradigma no co-design de software e hardware para IA. Ao atacar a redundância inerente nos formatos numéricos no nível do enlace de dados, permite arquiteturas de chiplets mais escaláveis e eficientes. Esta abordagem mitiga um dos maiores limitantes atuais: a saturação da largura de banda de interconexão. Para o nicho da microfabricação 3D, LEXI estabelece um precedente claro: a inovação não está apenas em empilhar mais transistores ou chiplets, mas em otimizar inteligentemente cada bit que viaja entre eles, desbloqueando novos patamares de desempenho em inferência de LLMs.

Como a técnica de compressão de expoentes LEXI pode otimizar a transferência de dados entre chiplets para reduzir a latência na inferência de LLMs?

(PD: simular uma oblea de 200mm é como fazer uma pizza: todo mundo quer um pedaço)