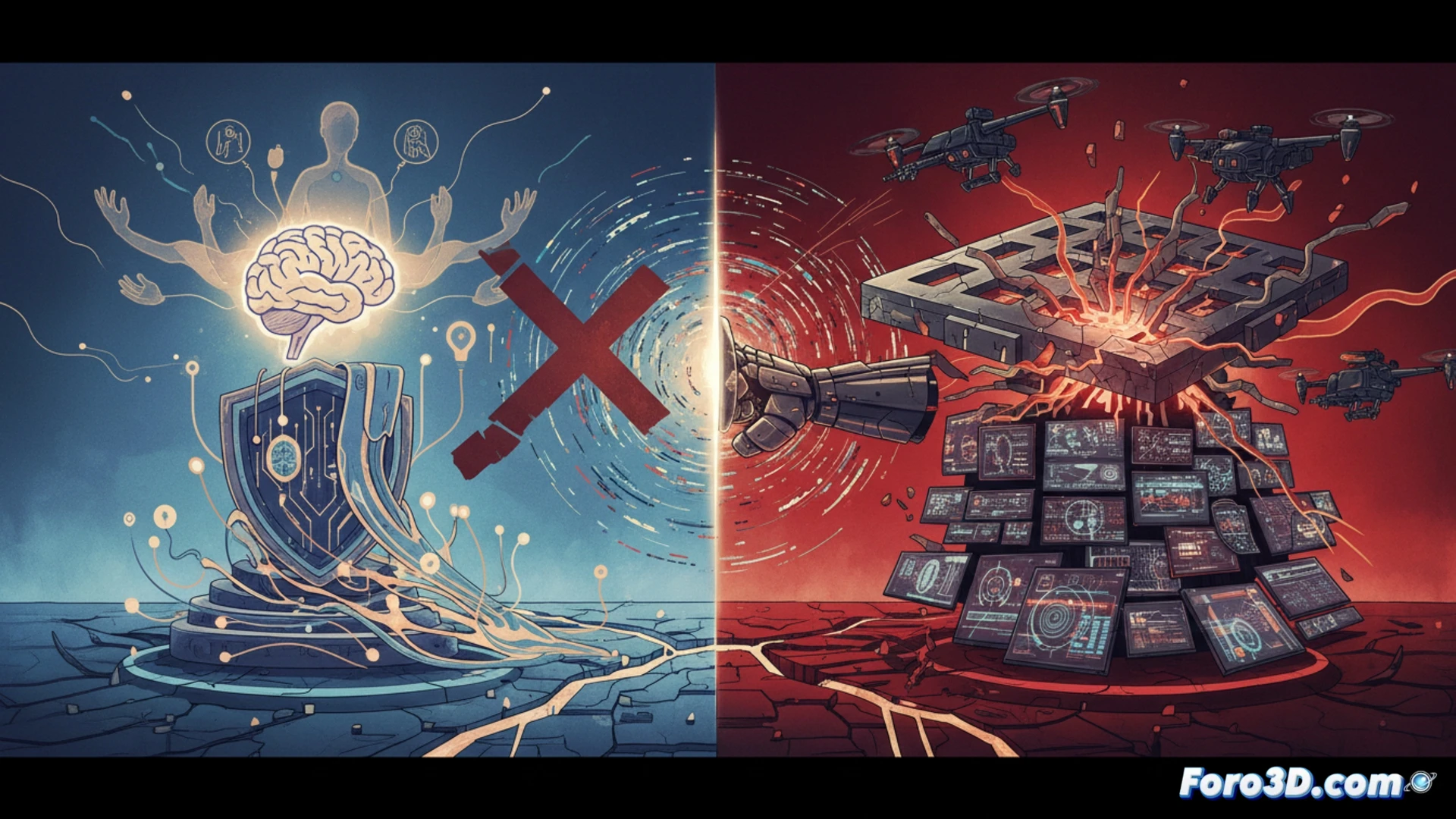

Em um movimento sem precedentes, o Departamento de Defesa dos EUA designou a empresa de inteligência artificial Anthropic como um risco para a cadeia de suprimentos de segurança nacional. Esta medida, tipicamente reservada para adversários estrangeiros, proíbe a companhia e seus parceiros de trabalhar com o governo. O conflito nasce de um choque ético irreconciliável: Anthropic se recusou a permitir o uso de sua IA para vigilância em massa ou armas autônomas, desafiando as demandas do Pentágono e colocando em risco sua própria viabilidade econômica.

A designação como risco de cadeia de suprimentos: implicações legais e operacionais ⚖️

A designação oficial como risco para a cadeia de suprimentos de segurança nacional não é uma sanção menor. É um instrumento legal poderoso que efetivamente exclui a Anthropic de qualquer contrato com o Departamento de Defesa e outras agências chave. Isso vai além de uma simples rejeição a uma licitação; é uma proibição ampla que se estende a seus parceiros comerciais, isolando a empresa de um mercado gigantesco. A decisão da Anthropic de contestar a medida nos tribunais criará um precedente crucial. O caso judicial definirá os limites do poder governamental para punir empresas que, por motivos éticos autodeclarados, recusam colaborar em projetos de segurança nacional, e testará a autonomia corporativa no desenvolvimento de tecnologias de uso duplo.

Um precedente perigoso para a indústria de IA ⚠️

Este caso transcende a Anthropic e estabelece um precedente alarmante para toda a indústria tecnológica. Sinaliza que priorizar princípios éticos rígidos, especialmente em áreas sensíveis como a autonomia letal ou a vigilância, pode acarretar um custo econômico existencial. A medida do Pentágono poderia forçar outras startups a escolherem entre sua bússola moral e sua sobrevivência comercial, freando a inovação responsável e empurrando o desenvolvimento de IA crítica para atores menos escrupulosos ou para potências rivais. A batalha legal resultante definirá o futuro da governança ética da IA e o frágil equilíbrio entre a segurança do estado e a liberdade de consciência corporativa.

Até que ponto deve-se priorizar a segurança nacional sobre a ética no desenvolvimento de inteligência artificial avançada?

(PD: tentar banir um apelido na internet é como tentar tapar o sol com um dedo... mas no digital)