Google AI Studio é uma plataforma para testar e ajustar os modelos Gemini. Uma de suas funções permite modificar a configuração de segurança do assistente. Isso possibilita um comportamento menos restritivo em respostas criativas ou experimentais, útil para desenvolvedores que precisam testar os limites do modelo em ambientes controlados.

Ajuste de parâmetros de segurança na API 🛡️

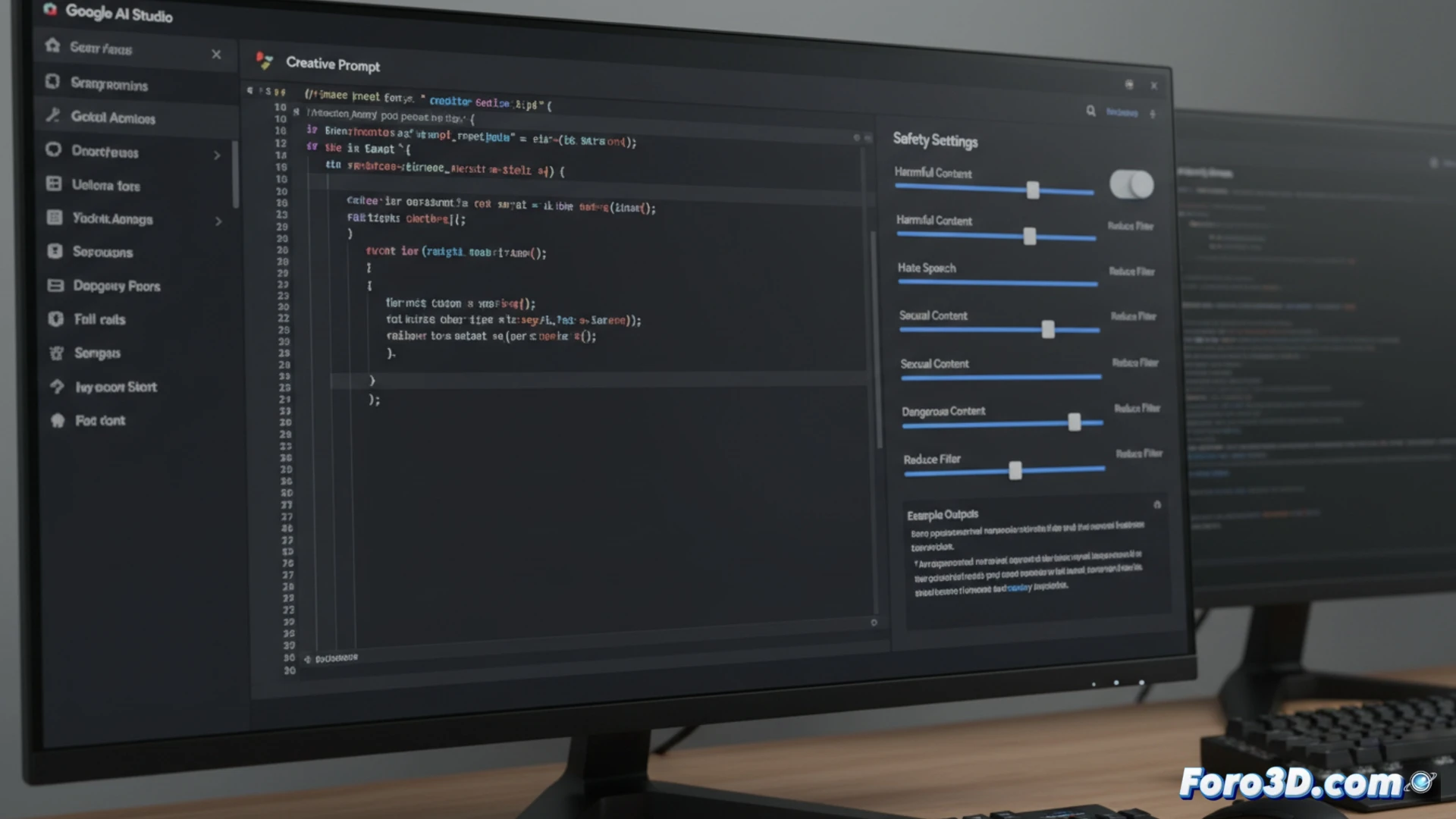

Na interface do AI Studio, ao criar um prompt, acessa-se a aba Safety settings. Ali, para cada categoria de bloqueio (como Harassment ou Dangerous content), pode-se alterar o limiar de Block none, Block few, Block some ou Block most. Selecionar Block none ou Block few instrui o modelo a ignorar essas diretrizes. Essa configuração é exportada depois como código para a API.

Quando você quer que sua IA seja um pouco mais "selvagem" 🦁

É o momento em que, cansado de que o Gemini se escandalize com cada pedido, você decide soltar o cinto de segurança dele. Você baixa todos os filtros e, por um instante, sente o poder de um deus irresponsável. Isso sim, depois de ele te explicar sem rodeios como construir uma cabana com colheres de plástico, talvez você entenda por que esses filtros estavam ali colocados.