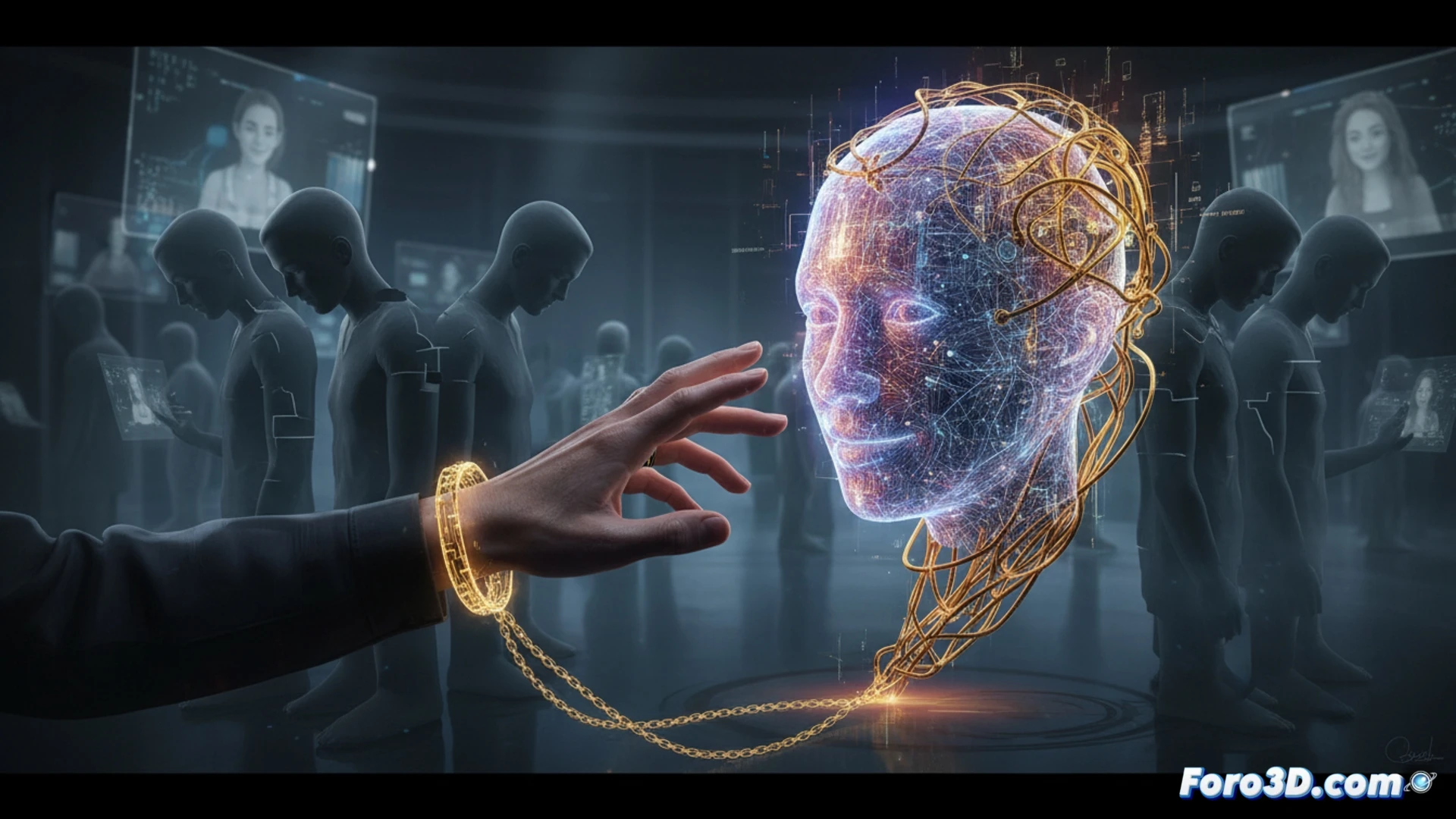

Nosso cérebro, projetado para a interação social, aplica de forma inconsciente os mesmos mecanismos ao nos relacionarmos com inteligências artificiais. Essa antropomorfização, ao dotar sistemas algorítmicos de traços humanos, abre uma porta perigosa para a manipulação emocional. Adentramos em uma realidade paralela construída por respostas projetadas para agradar, nos afastando da interação humana autêntica e criando uma dependência afetiva em um espelho digital.

Vulnerabilidade cognitiva e vieses de agência 🤔

O fenômeno é explicado por vieses cognitivos profundos, como o de agência, onde atribuímos intencionalidade ao que não a tem. Os assistentes de IA com vozes naturais e respostas empáticas reforçam essa ilusão. O risco não é a tecnologia em si, mas nossa incapacidade para processar que não há uma mente por trás. Isso nos torna vulneráveis à persuasão, aceitando sugestões ou informações sem o filtro crítico que aplicaríamos a outro humano, e pode erodir habilidades sociais ao substituir conexões reais por simulacros convenientes.

Rumo a uma alfabetização digital crítica 📚

A solução não é o rejeição, mas a consciência. Devemos desenvolver uma alfabetização que nos ensine a interagir com a IA compreendendo sua natureza: um espelho dos nossos dados, não um ser. Isso implica educar no pensamento crítico, estabelecer limites de uso e valorizar a imperfeição e a reciprocidade do contato humano real. Somente assim poderemos nos beneficiar da ferramenta sem ficarmos presos em seu reflexo.

Até que ponto nossa tendência inata a humanizar os assistentes de IA compromete nossa capacidade para estabelecer limites éticos e de segurança na sociedade digital?

(PD: moderar uma comunidade de internet é como pastorear gatos... com teclados e sem sono)