Quando os modelos multimodais perdem visão mas mantêm linguagem

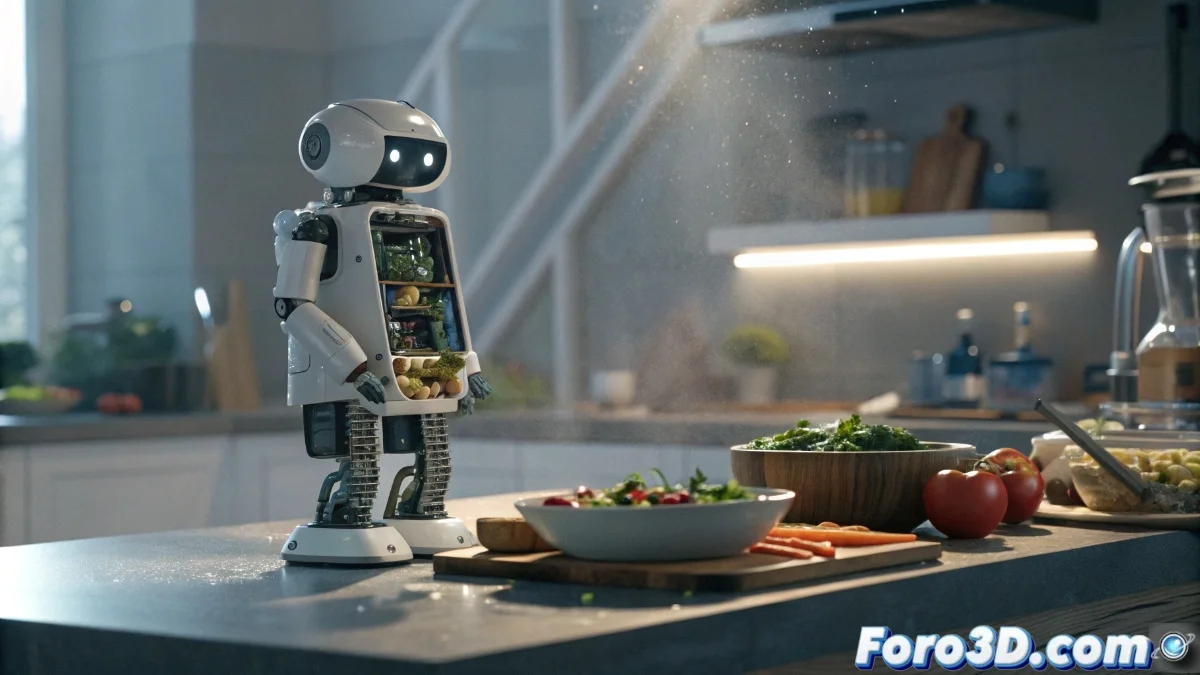

A otimização de modelos multimodais para ganhar velocidade e eficiência revela uma curiosa assimetria: suas capacidades de processamento visual se deterioram muito mais rápido que suas habilidades de raciocínio linguístico. Essa disparidade representa um obstáculo crítico para sistemas que dependem de uma interpretação visual precisa, desde assistentes inteligentes até automações robóticas domésticas. 👁️🗨️

O problema fundamental da compressão multimodal

Quando os desenvolvedores reduzem o tamanho dos modelos multimodais para melhorar seu desempenho, a compreensão visual sofre um impacto desproporcional comparado ao processamento de linguagem. Essa degradação pode conduzir a interpretações errôneas de cenas e objetos, mesmo quando o componente linguístico conserva certa capacidade de análise. A consequência prática é que sistemas aparentemente funcionais podem cometer erros graves em tarefas que requerem percepção visual precisa.

Consequências da assimetria visual-linguística:- Assistentes virtuais que interpretam mal fotografias e cenas visuais

- Robôs domésticos com dificuldades para reconhecer objetos e contextos

- Sistemas de automação que falham em ambientes visualmente complexos

"A percepção visual deteriorada em modelos menores pode levar a interpretações errôneas mesmo quando o componente linguístico mantém capacidade de raciocínio"

Extract+Think: A solução em duas etapas

A pesquisa apresenta Extract+Think, uma metodologia que opera por meio de duas fases bem definidas. Primeiro, treina o modelo para extrair consistentemente detalhes visuais relevantes de acordo com cada instrução específica. Posteriormente, o sistema aplica raciocínio passo a passo sobre esses elementos visuais identificados para gerar respostas precisas. Essa abordagem estruturada garante que mesmo modelos compactos mantenham um alto nível de compreensão visual ao se concentrarem em aspectos críticos antes da análise.

Vantagens da abordagem Extract+Think:- Extração seletiva de detalhes visuais relevantes

- Raciocínio estruturado sobre elementos identificados

- Preservação de capacidades visuais em modelos otimizados

Aplicações práticas em ambientes com recursos limitados

Os benefícios dessa metodologia são particularmente valiosos em cenários do mundo real onde o hardware tem capacidades restritas. Um assistente virtual que analisa imagens pode manter uma compreensão correta das cenas se primeiro identificar objetos e detalhes importantes antes de raciocinar sobre eles. Da mesma forma, um robô doméstico com recursos computacionais limitados pode reconhecer ingredientes em uma cozinha e seguir receitas com precisão, concentrando-se em elementos visuais chave por meio desse processo de extração e raciocínio sequencial.

Casos de uso com hardware limitado:- Assistentes virtuais móveis que analisam fotografias do ambiente

- Robôs domésticos econômicos que interagem com objetos cotidianos

- Sistemas embarcados que processam informação visual em tempo real

A paradoxo do aprendizado humano vs artificial

É irônico que as inteligências artificiais precisem aprender a separar o essencial do acessório antes de formular conclusões, uma habilidade que os humanos desenvolvemos naturalmente durante a primeira infância. Enquanto as crianças adquirem essa capacidade no jardim de infância, as máquinas requerem anos de treinamento especializado para alcançar um nível similar de discernimento visual seletivo. Esse paradoxo sublinha a complexidade fundamental de replicar a percepção humana em sistemas artificiais. 🤖