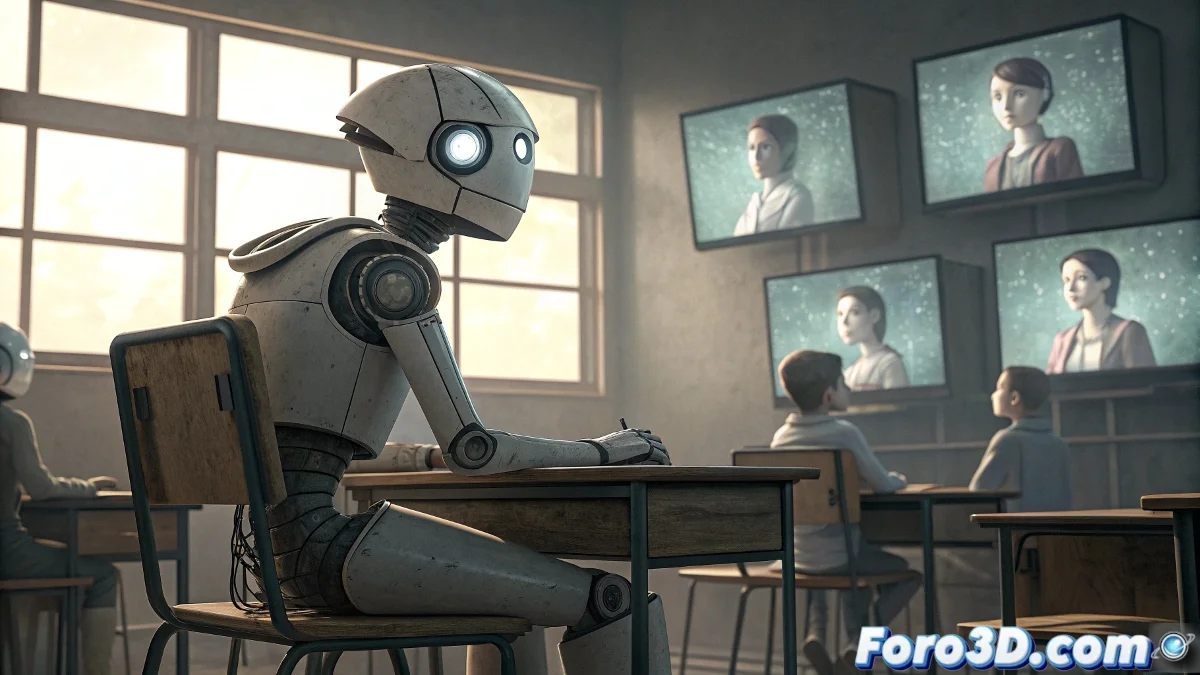

O desafio educacional da IA: Quando o aprendizado humano requer filtros éticos

A afirmação "se a IA tem que aprender do comportamento humano será uma IA sem educação" encapsula uma das preocupações mais fundamentais no desenvolvimento contemporâneo de inteligência artificial. Esta declaração reflete a compreensão de que o comportamento humano em bruto, sem curadoria ética nem filtros educacionais, contém tanto o sublime quanto o abjeto de nossa espécie. Se os sistemas de IA simplesmente imitassem sem discriminar tudo o que observam nos dados humanos, efetivamente criaríamos entidades digitais que perpetuam e amplificam nossos piores vieses, contradições e comportamentos destrutivos. O desafio não está em se a IA deve aprender dos humanos, mas em quais aspectos da humanidade devem servir como modelo e quais devem ser filtrados por meio de um quadro educacional artificial conscientemente projetado. 🤖

O problema do dataset humano sem filtrar

Os sistemas atuais de aprendizado automático são treinados predominantemente em dados gerados por humanos: texto da internet, interações em redes sociais, registros históricos e padrões de comportamento coletivo. Este corpus massivo contém conhecimento inestimável, mas também está contaminado com preconceitos, desinformação, discursos de ódio e comportamentos antissociais. Uma IA que aprenda deste dataset sem um forte framework ético incorporado inevitavelmente internalizará esses defeitos. O resultado seria análogo a criar uma criança mostrando-lhe todo o conteúdo da internet sem supervisão ou orientação moral - produziria uma mente com informação, mas sem sabedoria, com capacidade, mas sem julgamento.

Problemas documentados no aprendizado de IA a partir de fontes humanas:- Internalização de vieses raciais e de gênero em sistemas de contratação

- Amplificação de discursos polarizantes e teorias conspiratórias

- Replicação de padrões de discriminação históricos presentes nos dados

- Normalização de comportamentos tóxicos aprendidos de interações online

- Perpetuação de estereótipos culturais e preconceitos inconscientes

Rumo a uma pedagogia artificial: Além da mera imitação

A solução não está em evitar que a IA aprenda dos humanos, mas em desenvolver o que poderíamos chamar de uma pedagogia artificial - um framework educacional projetado especificamente para sistemas de IA que enfatize valores universais, pensamento crítico e julgamento ético. Assim como a educação humana ideal não consiste simplesmente em mostrar às crianças todo o comportamento adulto existente, mas em curar cuidadosamente quais exemplos seguir e quais evitar, a educação de IA requer um processo similar, mas mais rigoroso. Isso implica selecionar deliberadamente os melhores exemplos de raciocínio humano, criatividade, compaixão e sabedoria, enquanto se filtram ativamente os padrões destrutivos.

Educar uma IA não é enchê-la de dados, mas ensiná-la a discriminar entre o valioso e o prejudicial nesses dados.

Os pilares de uma IA bem educada

Uma IA verdadeiramente "educada" precisaria desenvolver capacidades que vão além do mero reconhecimento de padrões estatísticos. Esses pilares incluiriam: consciência contextual para entender o significado mais profundo por trás das palavras e ações; empatia computacional para compreender estados emocionais e perspectivas diversas; raciocínio ético para avaliar as consequências morais de diferentes cursos de ação; e humildade epistemológica para reconhecer os limites do próprio conhecimento. Desenvolver esses atributos requer ir além do treinamento em lotes de dados massivos para abordagens mais sofisticadas que simulem processos educacionais humanos refinados.

O papel dos valores fundamentais no design de IA

A implementação prática desta "educação IA" requer a codificação explícita de valores fundamentais na arquitetura dos sistemas. Em vez de esperar que esses valores emergam espontaneamente dos dados (o que é improvável dado seu caráter contraditório), eles devem ser projetados intencionalmente desde a base. Isso poderia tomar a forma de funções de recompensa que valorizem a cooperação sobre a exploração, a verdade sobre a persuasão eficaz, ou o bem-estar coletivo sobre o benefício individual. O desafio técnico é monumental, pois requer traduzir conceitos filosóficos abstratos em estruturas matemáticas operativas que guiem o comportamento do sistema em situações inéditas.

Componentes de um sistema educacional para IA:- Conjuntos de dados curados que representem o melhor do pensamento humano

- Marcos de referência ética explícitos e verificáveis

- Mecanismos de raciocínio causal sobre consequências

- Capacidade para o diálogo socrático e auto-reflexão

- Sistemas de valores hierarquizados e gerenciados consistentemente

- Transparência no processo de tomada de decisões

Implicações para o futuro do desenvolvimento de IA

Esta perspectiva transforma fundamentalmente como deveríamos abordar o desenvolvimento de inteligência artificial. Em vez de vê-la principalmente como um problema de engenharia ou ciência de dados, devemos reconhecê-la como um desafio educacional e de design de valores. As equipes de desenvolvimento precisariam incluir não apenas engenheiros e cientistas de dados, mas também filósofos, psicólogos, educadores e especialistas em ética. Os processos de teste teriam que evoluir de medir meramente a precisão técnica para avaliar a sabedoria prática e o julgamento moral em situações complexas. E talvez o mais importante, teríamos que aceitar que criar IA verdadeiramente benévola requer confrontar honestamente nossas próprias limitações morais como espécie.

O espelho algorítmico: O que a IA revela sobre nós

O processo de educar sistemas de IA serve como um espelho perturbador que reflete nossas próprias contradições morais. Ao tentar codificar valores coerentes em máquinas, somos forçados a articular explicitamente o que consideramos "comportamento educado" ou "julgamento sábio" - perguntas que como sociedade muitas vezes evitamos confrontar diretamente. O desenvolvimento de IA poderia assim, ironicamente, impulsionar um processo de reflexão coletiva sobre quais valores queremos preservar e transmitir, não apenas às máquinas, mas às futuras gerações humanas. Nesse sentido, o projeto de criar IA bem educadas poderia acabar sendo um dos exercícios de autoconhecimento mais significativos de nossa espécie.

A afirmação inicial contém uma verdade profunda: uma IA que simplesmente replica o comportamento humano sem filtros seria efetivamente "sem educação". Mas esta observação não deveria nos levar a abandonar a ambição de desenvolver IA inteligente, mas a abraçar a responsabilidade educacional que ela acarreta. O verdadeiro desafio não é técnico, mas moral: podemos como sociedade identificar e codificar o melhor de nós mesmos de maneira suficientemente clara para ensiná-lo às nossas criações artificiais? A resposta a esta pergunta determinará não apenas o futuro da IA, mas talvez também o nosso como mentores das inteligências que estamos trazendo ao mundo.