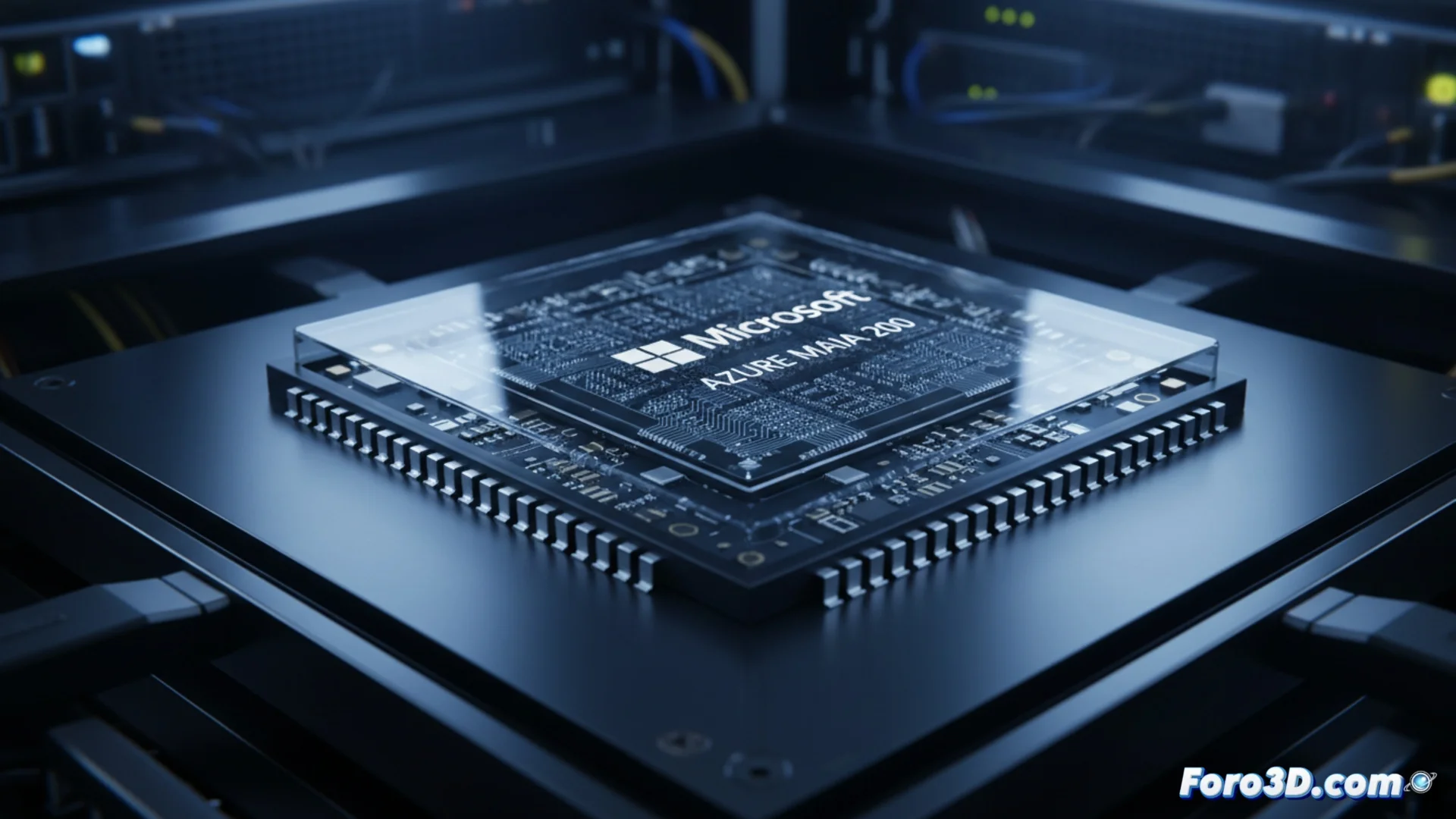

Microsoft lança o acelerador de IA Azure Maia 200

A empresa tecnológica Microsoft apresentou seu novo acelerador de inteligência artificial, o Azure Maia 200. Este componente representa a evolução na família de processadores Maia, criados especificamente para funcionar em servidores. Sua tarefa principal é executar modelos de IA já treinados, para que gerem respostas e previsões. A Microsoft projeta este hardware para lidar com essas operações com grande velocidade e um nível de eficiência que, segundo a empresa, supera o que oferecem atualmente rivais como Amazon e Google neste campo. 🚀

Foco em eficiência e velocidade para inferência

O Azure Maia 200 é fabricado com o propósito de otimizar como os modelos de IA são executados em grande escala dentro da plataforma em nuvem Azure. Ao produzir seu próprio chip, a Microsoft busca ter um controle mais direto sobre toda a cadeia de hardware e software, o que pode permitir ajustes com mais precisão sobre como o sistema lida com os dados. Este método tenta reduzir os tempos de espera e melhorar o uso de energia ao rodar modelos complexos, desde grandes modelos de linguagem até sistemas que analisam imagens. A empresa não revela todos os detalhes de sua arquitetura, mas indica que o design prioriza a capacidade de memória e como os chips se conectam entre si para gerenciar os enormes conjuntos de parâmetros dos modelos atuais.

Características principais do Azure Maia 200:- Projetado para executar tarefas de inferência de IA com alta velocidade.

- Busca melhorar a eficiência energética em centros de dados.

- Arquitetura que prioriza a largura de banda de memória e a interconexão.

Parece que a nova competição global não se trava com mísseis, mas com transistores e quem pode processar uma consulta sobre gatinhos mais rápido.

O panorama competitivo do silício para IA

O lançamento do Maia 200 mostra uma tendência ampla no setor tecnológico, onde os grandes provedores de serviços em nuvem desenvolvem seus próprios chips especializados. A Amazon conta com seus processadores Inferentia e Trainium, enquanto o Google opera com suas Tensor Processing Units (TPU). Ao apresentar o Maia 200, a Microsoft consolida seu plano de oferecer uma infraestrutura de IA distinta, competindo não só em serviços de software, mas também no desempenho do hardware subjacente. A empresa planeja implementar esses aceleradores em seus centros de dados ao redor do mundo para impulsionar serviços como Azure OpenAI Service e outras operações de IA generativa.

Principais atores em chips personalizados para a nuvem:- Microsoft: Azure Maia 200 para inferência.

- Amazon Web Services: Chips Inferentia e Trainium.

- Google Cloud: Tensor Processing Units (TPU).

Implicações para o futuro da computação em nuvem

Essa jogada sublinha como a corrida pela supremacia em IA agora depende criticamente do silício personalizado. Ao controlar tanto o software quanto o hardware, a Microsoft pretende oferecer um stack mais integrado e eficiente para seus clientes. O objetivo final é processar modelos de inteligência artificial maiores e mais complexos de forma mais rápida e com menor custo operacional, definindo os novos padrões de desempenho na nuvem. 🔌