Adaptação de modelos lidar por meio de destilação de conhecimento visual

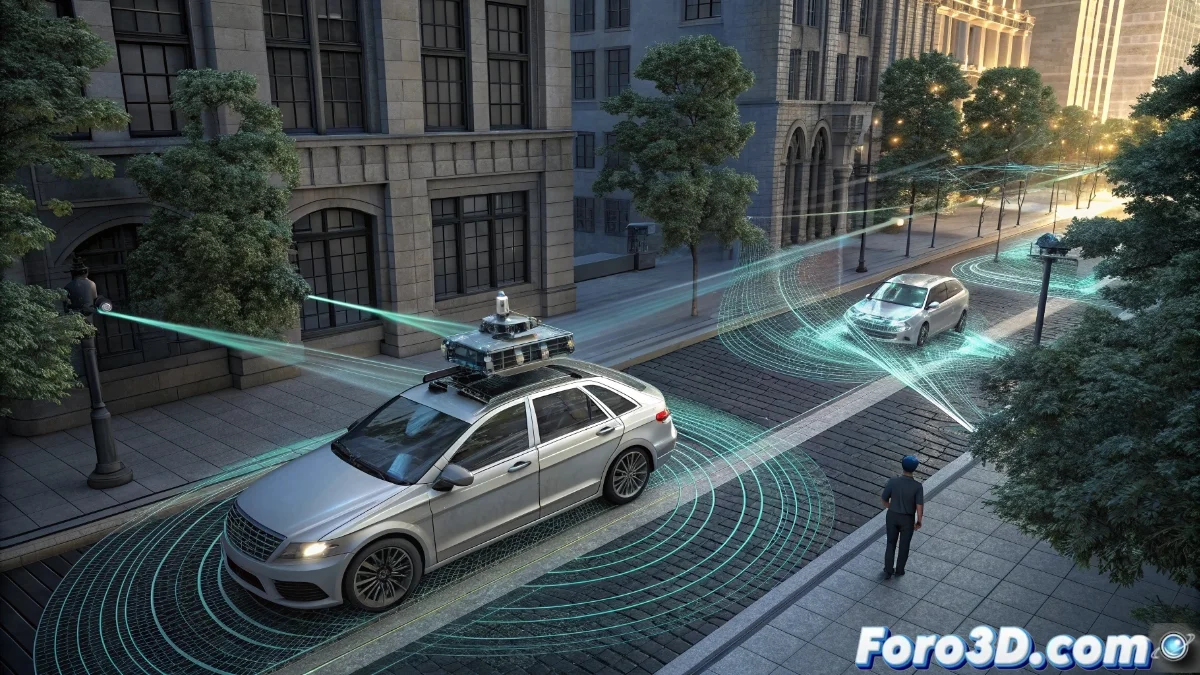

A interoperabilidade entre sensores lidar heterogêneos representa um dos obstáculos mais complexos no desenvolvimento de sistemas autônomos robustos. Quando um modelo treinado com dados de um sensor específico se depara com variações em resolução, padrões de escaneamento ou níveis de ruído, sua capacidade de segmentação semântica se deteriora dramaticamente 🎯.

Fundamentos da transferência multimodal

Os Vision Foundation Models surgem como solução paradigmática por meio de processos de destilação não supervisionada que transformam representações visuais em conhecimento transferível para domínios lidar. Essa metodologia aproveita a estabilidade intrínseca dos modelos de imagem para gerar sinais de ensino ricos que guiam o aprendizado do modelo lidar sem exigir anotações manuais no novo domínio de sensor 🔄.

Mecanismos chave da destilação cruzada:- O modelo visual atua como professor generativo produzindo representações invariantes a variações sensoriais

- O aluno lidar aprende a emular essas representações durante pré-treinamento extensivo com dados não rotulados

- Estabelece-se um espaço latente compartilhado que facilita a adaptação posterior entre diferentes configurações de sensores

A destilação multimodal cria pontes cognitivas entre domínios visuais e lidar, replicando a capacidade humana de transferir conhecimento entre contextos sensoriais diferentes

Arquitetura para generalização escalável

A escolha do backbone lidar determina criticamente a eficácia do processo de transferência. Certas topologias neurais demonstram maior aptidão para absorver e conservar as características estáveis provenientes dos modelos fundação visuais. A metodologia proposta permite pré-treinamento único do backbone por meio de destilação, possibilitando sua reutilização em múltiplos cenários de mudança de domínio sem repetir o processo completo 🏗️.

Estratégias de preservação de generalização:- Mantenimento do backbone congelado durante a fase de adaptação final ao novo sensor

- Treinamento exclusivo de cabeças MLP leves para tarefas específicas de segmentação

- Extração de características robustas que resistem a variações em densidade e padrões de escaneamento

Validação experimental e aplicações práticas

Essa abordagem demonstrou superioridade consistente em relação a métodos convencionais em quatro cenários de referência especialmente desafiadores, incluindo transições entre lidars de diferentes densidades e configurações de escaneamento. Em implementações reais, como a migração de veículos autônomos de sistemas rotatórios de 64 linhas para configurações de 32 linhas, o backbone pré-treinado extrai características resilientes diante de reduções de densidade, enquanto a cabeça MLP aprende rapidamente a mapear essas representações para classes semânticas específicas 🚗.

A combinação sinérgica de destilação imagem-lidar, backbone reutilizável e cabeças de adaptação leves constitui um paradigma eficiente e escalável para enfrentar os desafios de generalização em percepção robótica. Esse avanço representa uma mudança conceitual fundamental: os sistemas lidar finalmente estão aprendendo que mudar de ferramenta não implica reaprender do zero, mas sim adaptar-se inteligentemente a novas condições operacionais 💡.