Adaptación de modelos lidar mediante destilación de conocimiento visual

Adaptación de modelos lidar mediante destilación de conocimiento visual

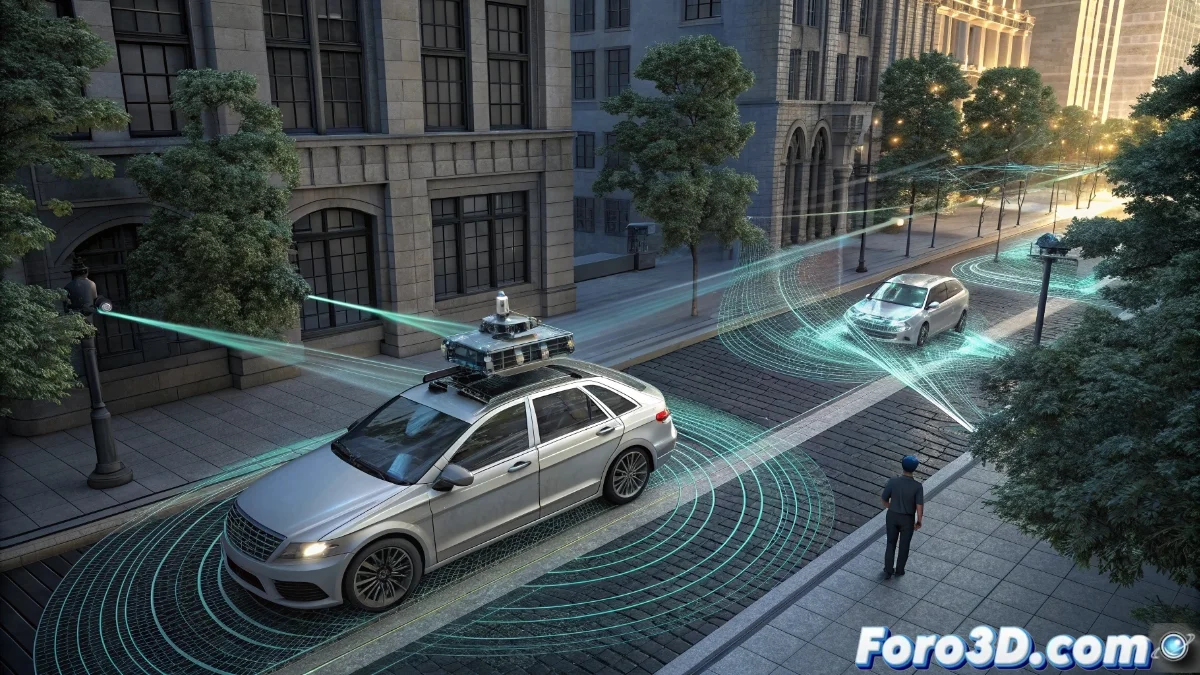

La interoperabilidad entre sensores lidar heterogéneos representa uno de los obstáculos más complejos en el desarrollo de sistemas autónomos robustos. Cuando un modelo entrenado con datos de un sensor específico se enfrenta a variaciones en resolución, patrones de escaneo o niveles de ruido, su capacidad de segmentación semántica se deteriora dramáticamente 🎯.

Fundamentos de la transferencia multimodal

Los Vision Foundation Models emergen como solución paradigmática mediante procesos de destilación no supervisada que transforman representaciones visuales en conocimiento transferible a dominios lidar. Esta metodología aprovecha la estabilidad intrínseca de los modelos de imagen para generar señales de enseñanza ricas que guían el aprendizaje del modelo lidar sin requerir anotaciones manuales en el nuevo dominio sensor 🔄.

Mecanismos clave de la destilación cruzada:- El modelo visual actúa como profesor generativo produciendo representaciones invariantes ante variaciones sensoras

- El estudiante lidar aprende a emular estas representaciones durante preentrenamiento extensivo con datos no etiquetados

- Se establece un espacio latente compartido que facilita la adaptación posterior entre diferentes configuraciones de sensores

La destilación multimodal crea puentes cognitivos entre dominios visuales y lidar, replicando la capacidad humana de transferir conocimiento entre contextos sensoriales diferentes

Arquitectura para generalización escalable

La elección del backbone lidar determina críticamente la eficacia del proceso de transferencia. Ciertas topologías neuronales demuestran mayor aptitud para absorber y conservar las características estables provenientes de los modelos fundación visuales. La metodología propuesta permite preentrenamiento único del backbone mediante destilación, posibilitando su reutilización en múltiples escenarios de cambio de dominio sin repetir el proceso completo 🏗️.

Estrategias de preservación de generalización:- Mantenimiento del backbone congelado durante la fase de adaptación final al nuevo sensor

- Entrenamiento exclusivo de cabezas MLP ligeras para tareas específicas de segmentación

- Extracción de características robustas que resisten variaciones en densidad y patrones de escaneo

Validación experimental y aplicaciones prácticas

Este enfoque ha demostrado superioridad consistente frente a métodos convencionales en cuatro escenarios de referencia especialmente desafiantes, incluyendo transiciones entre lidars de diferente densidad y configuraciones de escaneo. En implementaciones reales como la migración de vehículos autónomos desde sistemas rotatorios de 64 líneas a configuraciones de 32 líneas, el backbone preentrenado extrae características resilientes ante reducciones de densidad, mientras la cabeza MLP aprende rápidamente a mapear estas representaciones a clases semánticas específicas 🚗.

La combinación sinérgica de destilación imagen-lidar, backbone reutilizable y cabezas de adaptación ligeras constituye un paradigma eficiente y escalable para abordar los desafíos de generalización en percepción robótica. Este avance representa un cambio conceptual fundamental: los sistemas lidar finalmente están aprendiendo que cambiar de herramienta no implica reaprender desde cero, sino adaptarse inteligentemente a nuevas condiciones operativas 💡.