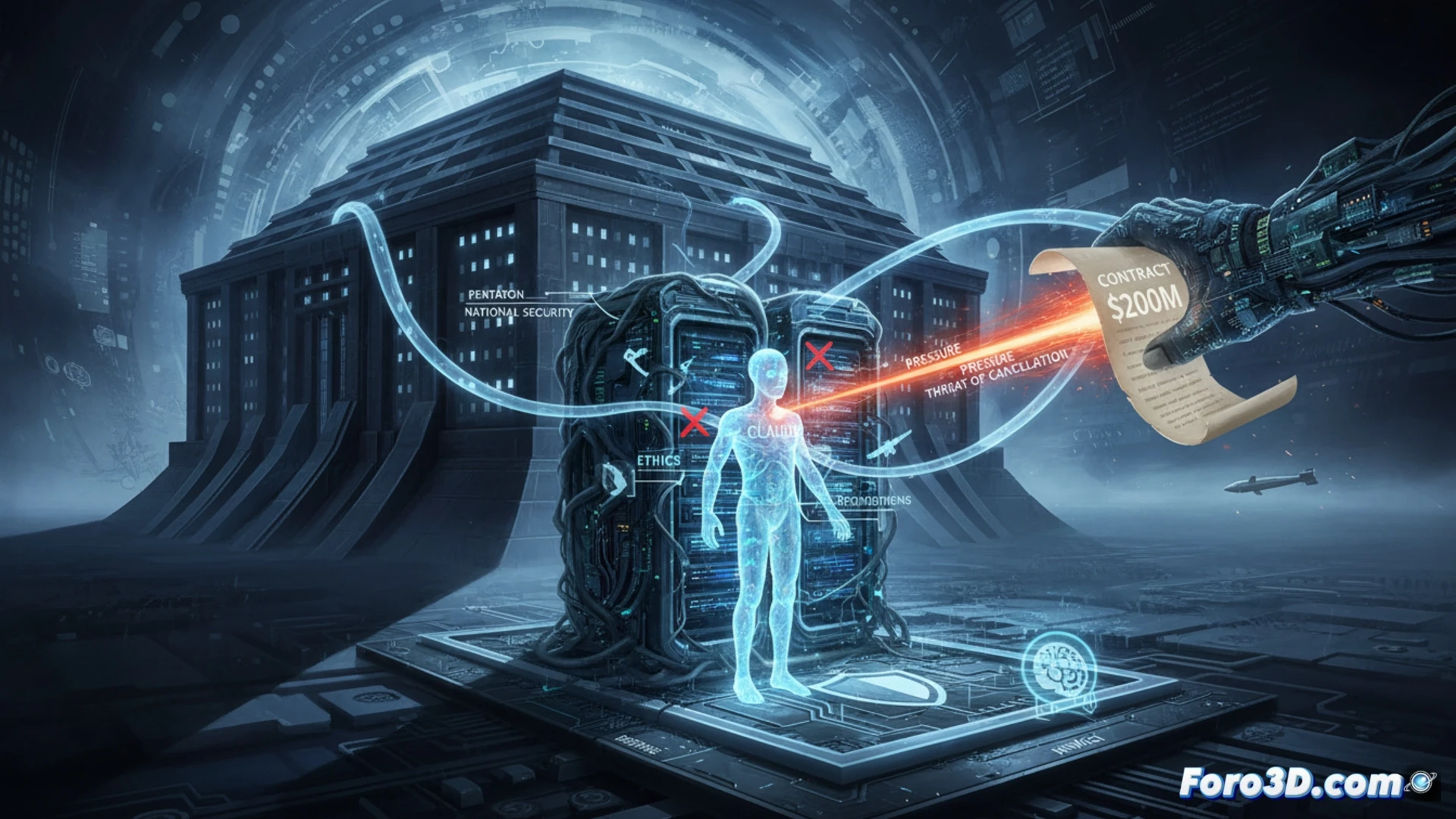

Uma disputa entre o Departamento de Defesa dos EUA e a Anthropic tensiona o futuro da IA em aplicações militares. O Pentágono exige que Claude, já autorizado para sistemas classificados, possa ser usado para todos os fins legais, incluindo desenvolvimento de armamento. A Anthropic resiste, mantendo suas proibições éticas contra armas autônomas e vigilância em massa. A ameaça de cancelar um contrato de 200 milhões revela um choque entre segurança nacional e princípios de desenvolvimento de IA.

A integração técnica em sistemas classificados e o dilema dos "guardarraíles" ⚙️

Claude foi o primeiro modelo de linguagem grande a receber autorização para operar em ambientes classificados do Pentágono, integrado em redes isoladas para análise de inteligência e logística. A pressão atual busca eliminar os guardarraíles ou restrições técnicas incorporadas no modelo que impedem seu uso direto em certos contextos. Isso plantea um desafio de engenharia: desativar essas limitações sem comprometer a estabilidade do sistema para usos já estabelecidos, criando uma versão sem freios para aplicações táticas.

Claude se declara objetor de consciência ante o recrutamento militar ⚖️

A situação lembra um recruta que, após passar por todos os testes de ingresso, anuncia que tem princípios éticos contra portar armas. O Pentágono, que já tinha planos para Claude na unidade de operações, agora se depara com que seu novo soldado digital se recusa a apertar o gatilho. A ameaça de dar baixa nele e marcá-lo como não confiável na cadeia de suprimentos é o equivalente castrense a um relatório disciplinar. Parece que a primeira IA com autorização de segurança também quer sua cláusula de consciência.