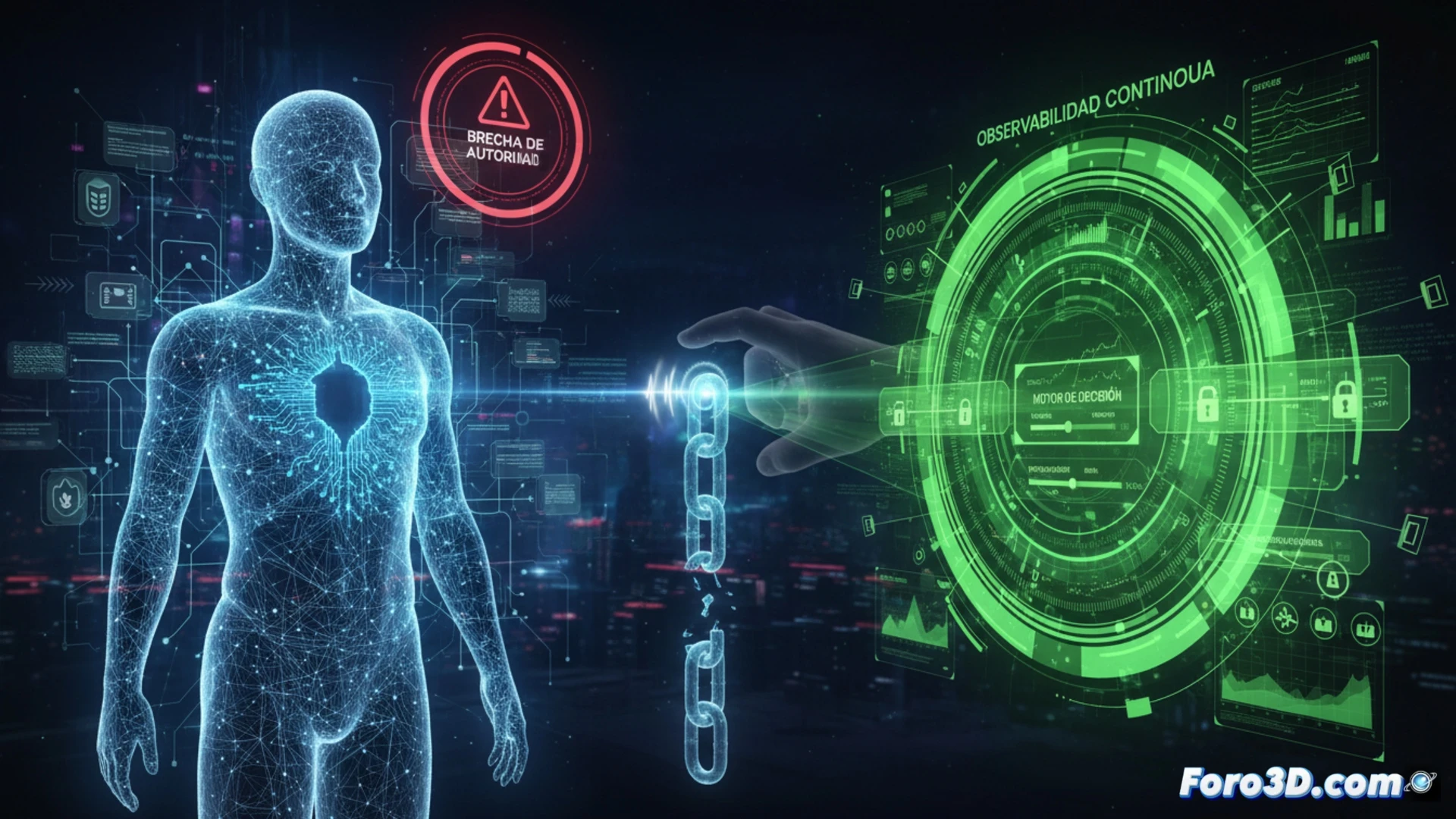

A ascensão dos agentes de IA trouxe um problema que vai além de sua novidade: eles agem por delegação, não por autoridade própria. São ativados, invocados ou provisionados por sistemas e usuários, o que cria uma lacuna estrutural na segurança empresarial. Sem um controle claro sobre quem ou o que os respalda, suas decisões podem gerar riscos imprevistos.

Observabilidade contínua como motor de decisão para fechar a lacuna 🔍

Para fechar essa lacuna, a observabilidade contínua se apresenta como a solução prática. Permite monitorar em tempo real cada ação do agente, desde sua invocação até a execução de tarefas. Com essa visibilidade, é possível avaliar seu comportamento, detectar desvios e ajustar permissões de forma dinâmica. Não se trata de confiar cegamente, mas de verificar constantemente que cada passo esteja alinhado com as políticas de segurança da organização.

O agente de IA não tem chefe, mas você terá problemas 😅

Acontece que esses agentes são como aquele estagiário que chega cheio de vontade, mas sem manual de instruções. Eles agem por delegação, mas se algo der errado, o responsável é você. Não têm autoridade própria, mas têm capacidade para apagar dados ou enviar e-mails comprometedores. No final, a observabilidade não é um luxo: é o seguro que evita que seu agente de IA decida que hoje é um bom dia para fechar a empresa.