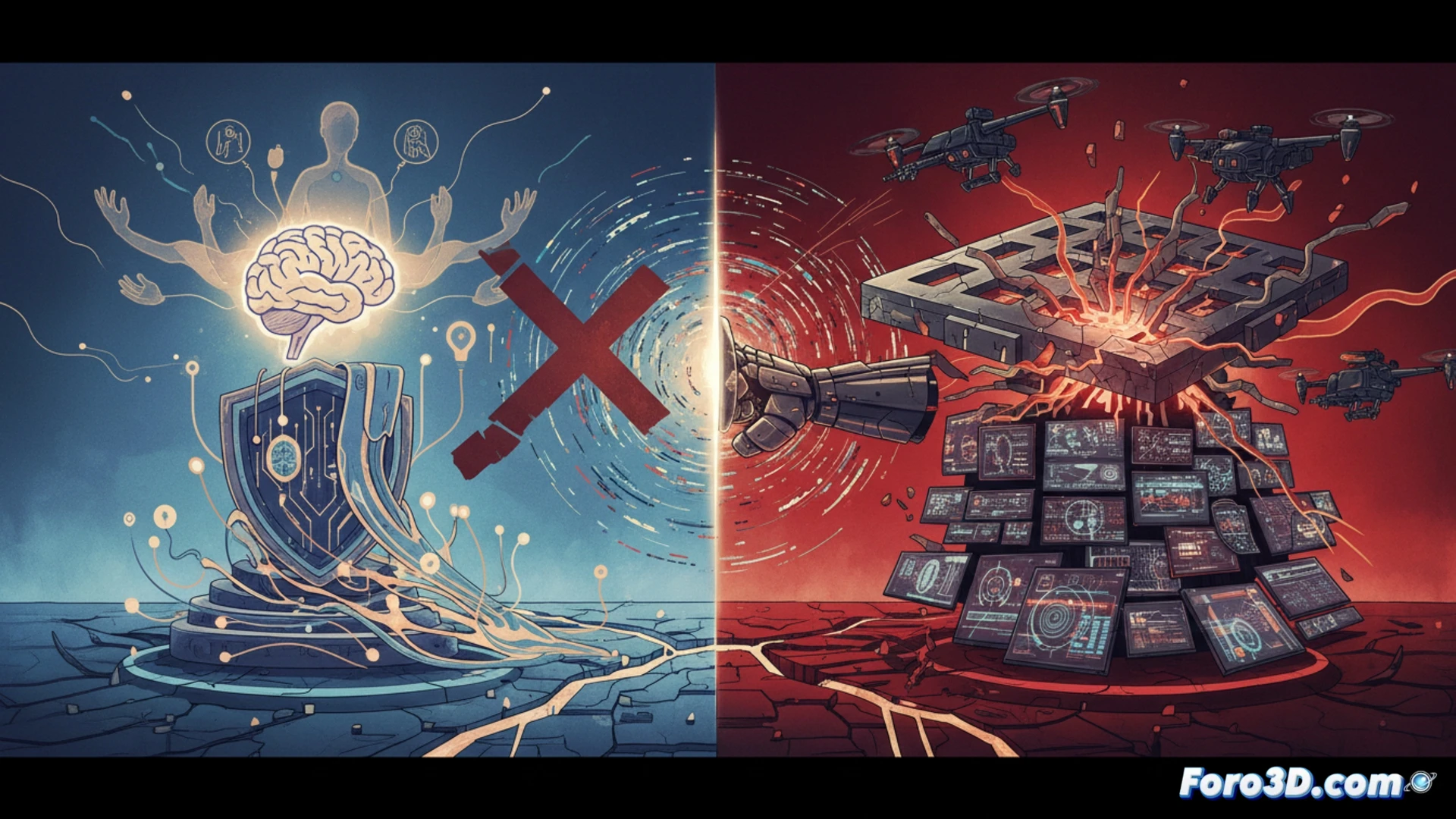

전례 없는 움직임으로 미국 국방부는 인공지능 기업 Anthropic을 국가 안보 공급망 위험으로 지정했습니다. 이는 일반적으로 외국 적대국에 적용되는 조치로, 해당 회사와 그 파트너들이 정부와 협력하는 것을 금지합니다. 이 갈등은 화해 불가능한 윤리적 충돌에서 비롯됩니다: Anthropic은 대규모 감시나 자율 무기 사용을 위한 AI 사용을 거부하여 펜타곤의 요구를 거스르며 자체 경제적 생존을 위험에 빠뜨렸습니다.

공급망 위험 지정: 법적 및 운영적 함의 ⚖️

국가 안보 공급망 위험으로의 공식 지정은 가벼운 제재가 아닙니다. 이는 Anthropic을 국방부 및 기타 주요 기관과의 모든 계약에서 사실상 배제하는 강력한 법적 도구입니다. 이는 단순한 입찰 거부 이상입니다; 상업 파트너에게까지 확대되는 광범위한 금지로, 회사를 거대한 시장에서 고립시킵니다. Anthropic의 법적 대응 결정은 중대한 선례를 만들 것입니다. 이 소송은 자칭 윤리적 이유로 국가 안보 프로젝트 협력을 거부하는 기업을 정부가 처벌할 수 있는 권한의 한계를 정의하고, 이중 용도 기술 개발에서 기업 자율성을 시험할 것입니다.

AI 산업에 위험한 선례 ⚠️

이 사례는 Anthropic을 넘어 전체 기술 산업에 충격적인 선례를 세웁니다. 치명적 자율성이나 감시와 같은 민감한 영역에서 강경한 윤리 원칙을 우선시하면 생존적 경제적 비용을 초래할 수 있음을 시사합니다. 펜타곤의 조치는 다른 스타트업들에게 도덕적 나침반과 상업적 생존 사이에서 선택을 강요할 수 있으며, 책임 있는 혁신을 저해하고 핵심 AI 개발을 덜 양심적인 행위자나 경쟁국으로 밀어붙일 수 있습니다. 결과적인 법적 싸움은 AI 윤리 거버넌스의 미래와 국가 안보와 기업 양심의 자유 사이의 취약한 균형을 정의할 것입니다.

첨단 인공지능 개발에서 국가 안보가 윤리보다 얼마나 우선되어야 할까요?

(PD: 인터넷에서 별명을 금지하려는 것은 손가락으로 태양을 가리려는 것과 같아요... 하지만 디지털 버전으로)