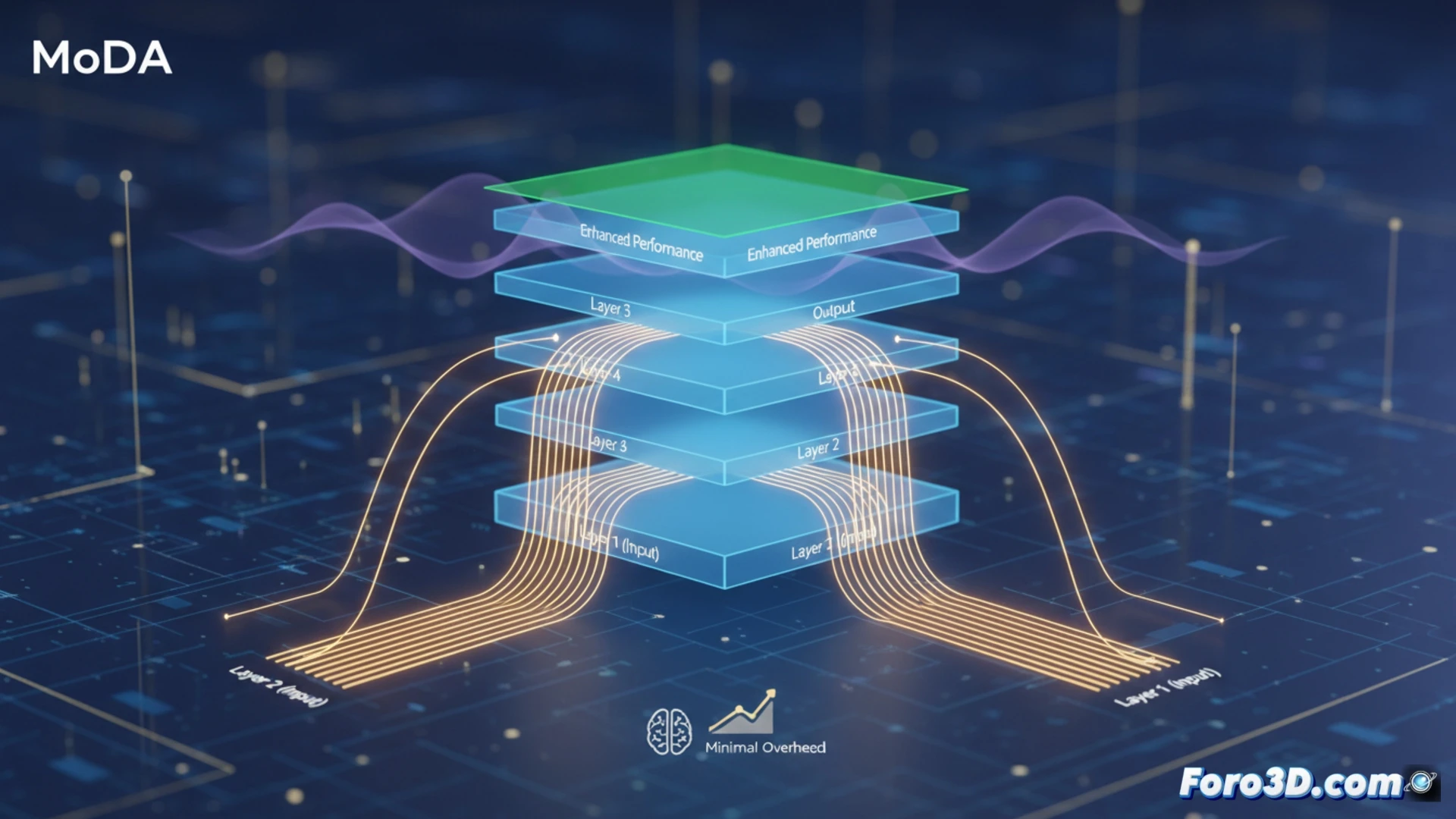

대형 언어 모델의 깊이를 확장하는 것은 그 능력의 핵심이지만, 한 가지 문제가 있습니다: 신호 열화. 정보가 수십 또는 수백 개의 레이어를 통과함에 따라 초기 레이어에서 형성된 유용한 특징이 희석되어 더 깊은 레이어에서 손실됩니다. 새로운 연구에서 Mixture-of-Depths Attention (MoDA)을 제안하는데, 이는 혁신적인 메커니즘으로 주의 헤드가 현재 레이어뿐만 아니라 이전 레이어의 핵심 정보에 접근할 수 있게 하여 중요한 신호를 보존하고 최소한의 계산 오버헤드로 모델 성능을 향상시킵니다.

MoDA의 작동 방식과 효율적인 구현 🤖

기술적으로 MoDA는 표준 주의를 수정합니다. 각 레이어에서 각 주의 헤드는 현재 레이어의 시퀀스 키-값 쌍 세트와 이전 레이어에서 추출된 깊이 내 세트 두 개의 키-값 쌍 세트에 주의를 기울일 수 있습니다. 이는 그렇지 않으면 희석되었을 정보적 특징을 복구하고 강화할 수 있게 합니다. 이를 실용적으로 하기 위해 연구자들은 메모리 비연속 접근 문제를 해결하는 하드웨어 효율적인 알고리즘을 개발하여 64K 토큰의 긴 시퀀스에서 FlashAttention-2의 97.3% 효율성을 달성했습니다. 이는 MoDA를 대규모 훈련에 실행 가능하게 만듭니다.

깊은 모델의 미래에 대한 함의 🚀

결과는 유망합니다: 1.5B 매개변수 모델에서 MoDA는 FLOPs에서 단 3.7% 오버헤드만으로 퍼플렉시티와 후속 작업 성능을 향상시킵니다. 게다가 일반적인 설정인 레이어 후 정규화와 더 잘 작동합니다. 이는 MoDA가 단순한 패치가 아니라 깊이를 더 효과적으로 확장하기 위한 기본 아키텍처 원시라는 것을 시사합니다. 그 효율성은 계산 비용 없이 더 깊고 유능한 모델의 문을 열어 더 강력하고 접근 가능한 LLM 개발을 가속화합니다.

MoDA 기술이 깊은 LLM에서 신호 열화 문제를 어떻게 해결할 수 있으며, 이는 더 유능하고 접근 가능한 인공 지능 개발에 어떤 함의를 가지는가?

(PD: 기술 별명은 자식과 같습니다: 당신이 이름 짓지만, 커뮤니티가 어떻게 부를지 결정합니다)