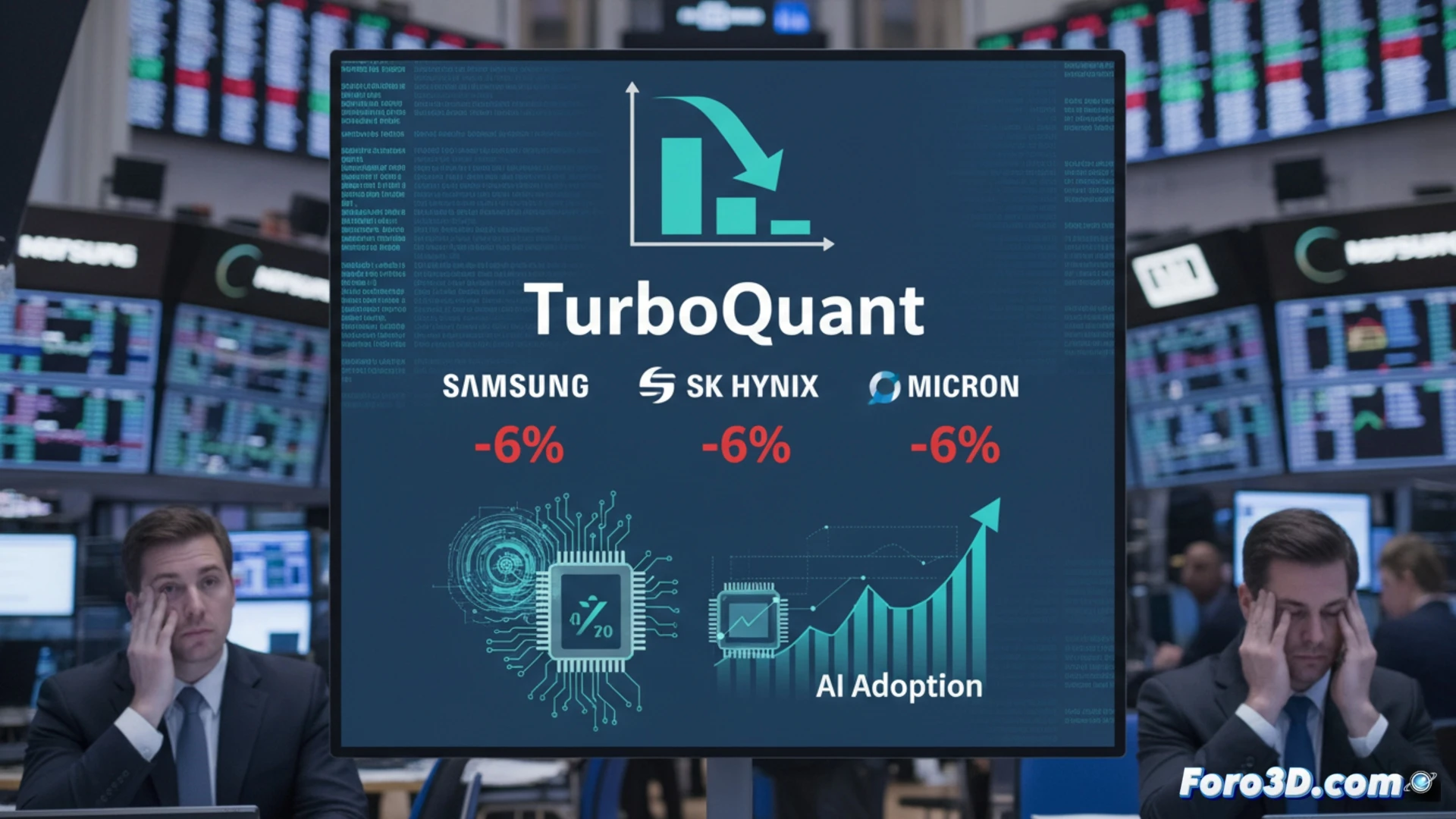

Google은 TurboQuant를 공개했습니다. 이는 언어 모델 압축 기술로, AI 추론에 필요한 메모리를 최대 6배까지 줄이면서도 정밀도를 손상시키지 않습니다. 이 발표는 Samsung, SK Hynix, Micron과 같은 메모리 거대 기업들의 주가를 즉시 약 6% 하락시켰습니다. 시장의 우려는 명확합니다: 소프트웨어가 근본적으로 더 효율적이 되어지면, AI에 핵심적인 DRAM 및 HBM 메모리 하드웨어의 예상 수요가 크게 줄어들 수 있습니다.🚀

기술적 함의: 칩당 HBM 감소, 웨이퍼당 칩 증가💡

AI 프로세서를 GPU로 상상해 보십시오. 그 아키텍처는 고대역폭 메모리 HBM 스택에 의존하며, 이는 제조 비용이 많이 들고 복잡한 구성 요소입니다. TurboQuant는 모델의 가중치를 압축하여 실행 중 HBM에 저장할 필요성을 줄입니다. 이는 미래 설계에서 칩당 메모리 스택 수를 줄이거나 용량을 낮추는 것으로 이어질 수 있으며, 실리콘 공간을 확보하고 재료 비용을 절감합니다. 생산 규모에서 단위당 수요 감소는 반도체 웨이퍼가 더 많은 최종 칩을 생산할 수 있게 하여, 파운드리와 메모리 제조업체의 용량 계산을 변화시킬 수 있습니다.

단기적 공포 vs. 구조적 기회🤔

주가 반응은 파괴적 변화에 대한 두려움을 반영하지만, 장기 전망은 더 미묘합니다. 더 효율적이고 저렴한 AI 추론은 진입 장벽을 낮춰 장치와 서비스에서의 대규모 채택을 촉진합니다. 이러한 확산은 메모리 총 수요를 증가시킬 수 있으며, 더 많은 애플리케이션과 다른 칩 유형에 분산될 수 있습니다. 반도체 산업은 적응해야 합니다: 가치가 더 이상 기가바이트 판매에만 있지 않고, 압축된 효율적 모델에 최적화된 메모리와 처리 솔루션을 통합하는 데 있을 것입니다.

Google의 TurboQuant와 같은 모델 압축이 고밀도 메모리 및 3D-IC 아키텍처의 AI 하드웨어 채택을 어떻게 촉진할 수 있을까요?

(PD: 3D로 칩 모델링은 쉽습니다. 어려운 건 레고 도시처럼 보이지 않게 하는 거죠)