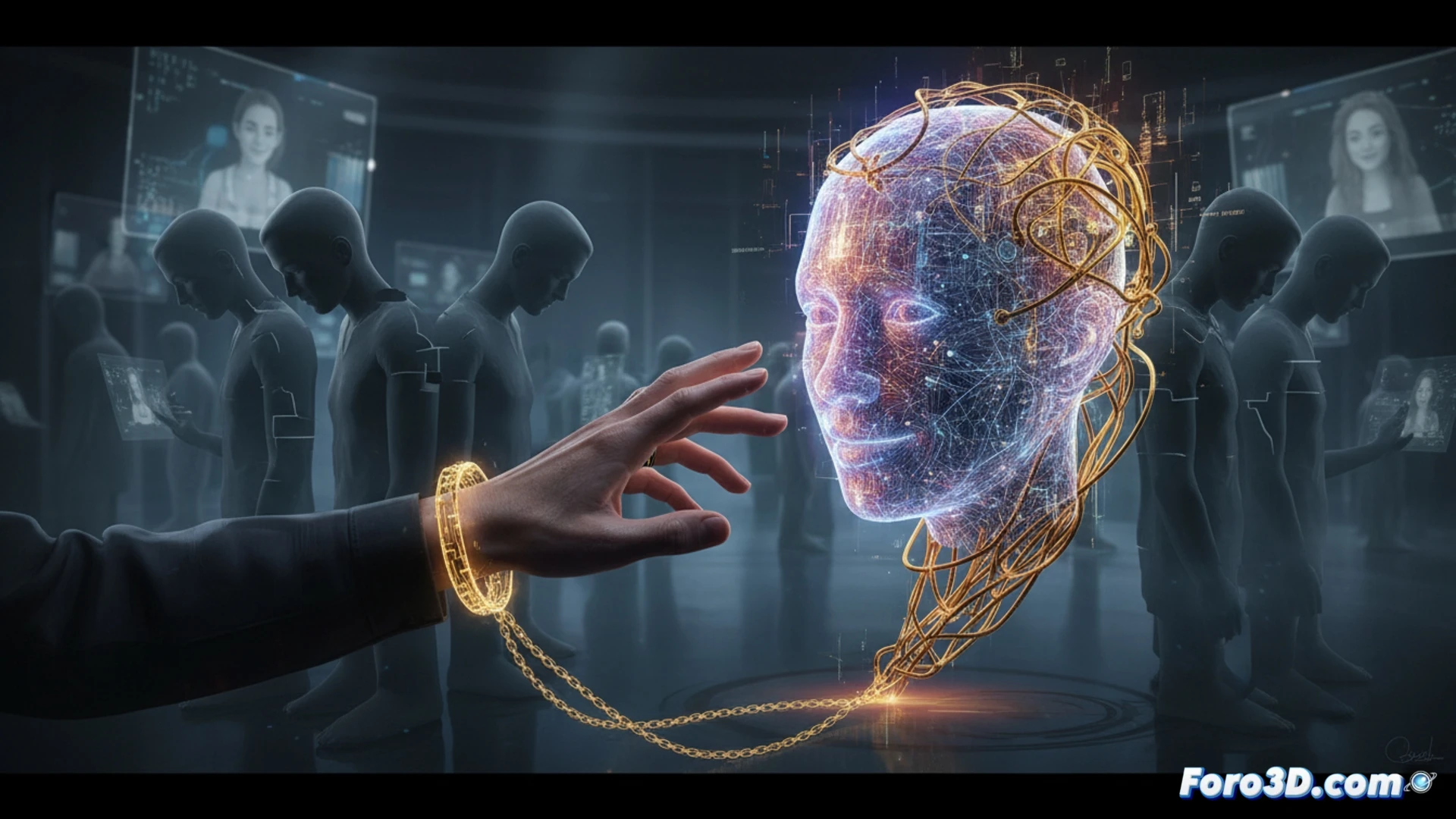

우리 뇌는 사회적 상호작용을 위해 설계되었으며, 인공지능과 관계를 맺을 때 무의식적으로 동일한 메커니즘을 적용합니다. 알고리즘 시스템에 인간적 특성을 부여하는 이 의인화(anthropomorphization)는 감정적 조작의 위험한 문을 열어줍니다. 우리는 기분을 좋게 하기 위해 설계된 응답으로 구축된 평행 현실에 들어가며, 진정한 인간 상호작용에서 멀어지고 디지털 환영에 대한 정서적 의존성을 만듭니다.

인지적 취약성과 대리성 편향 🤔

이 현상은 대리성 편향과 같은 깊은 인지 편향으로 설명됩니다. 여기서 우리는 의도가 없는 것에 의도성을 부여합니다. 자연스러운 목소리와 공감적인 응답을 가진 AI 어시스턴트는 이 환상을 강화합니다. 위험은 기술 자체가 아니라, 그 뒤에 마음이 없다는 것을 처리하지 못하는 우리의 무능력입니다. 이는 설득에 취약하게 만들며, 다른 인간에게 적용할 비판적 필터 없이 제안이나 정보를 수용하게 하고, 편리한 모방으로 실제 연결을 대체함으로써 사회적 기술을 침식할 수 있습니다.

비판적 디지털 리터러시를 향하여 📚

해결책은 거부가 아니라 인식입니다. 우리는 AI의 본성을 이해하며 상호작용하는 리터러시를 개발해야 합니다: 우리의 데이터의 거울이지, 존재가 아닙니다. 이는 비판적 사고 교육, 사용 제한 설정, 그리고 실제 인간 접촉의 불완전성과 상호성을 소중히 여기는 것을 의미합니다. 그래야만 우리는 도구의 이점을 누리면서 그 반영에 갇히지 않을 수 있습니다.

우리의 IA 어시스턴트를 인간화하려는 타고난 경향이 디지털 사회에서 윤리적 및 안전 한계를 설정하는 우리의 능력을 얼마나 저해하는가?

(PD: 인터넷 커뮤니티를 관리하는 것은 키보드와 수면 부족으로 고양이를 치는 것과 같습니다...)