Google AI Studio는 Gemini 모델을 테스트하고 조정하기 위한 플랫폼입니다. 그 기능 중 하나는 어시스턴트의 보안 설정을 수정할 수 있게 해줍니다. 이는 창의적이거나 실험적인 응답에서 덜 제한적인 동작을 가능하게 하며, 제어된 환경에서 모델의 한계를 테스트해야 하는 개발자에게 유용합니다.

API에서 보안 매개변수 조정 🛡️

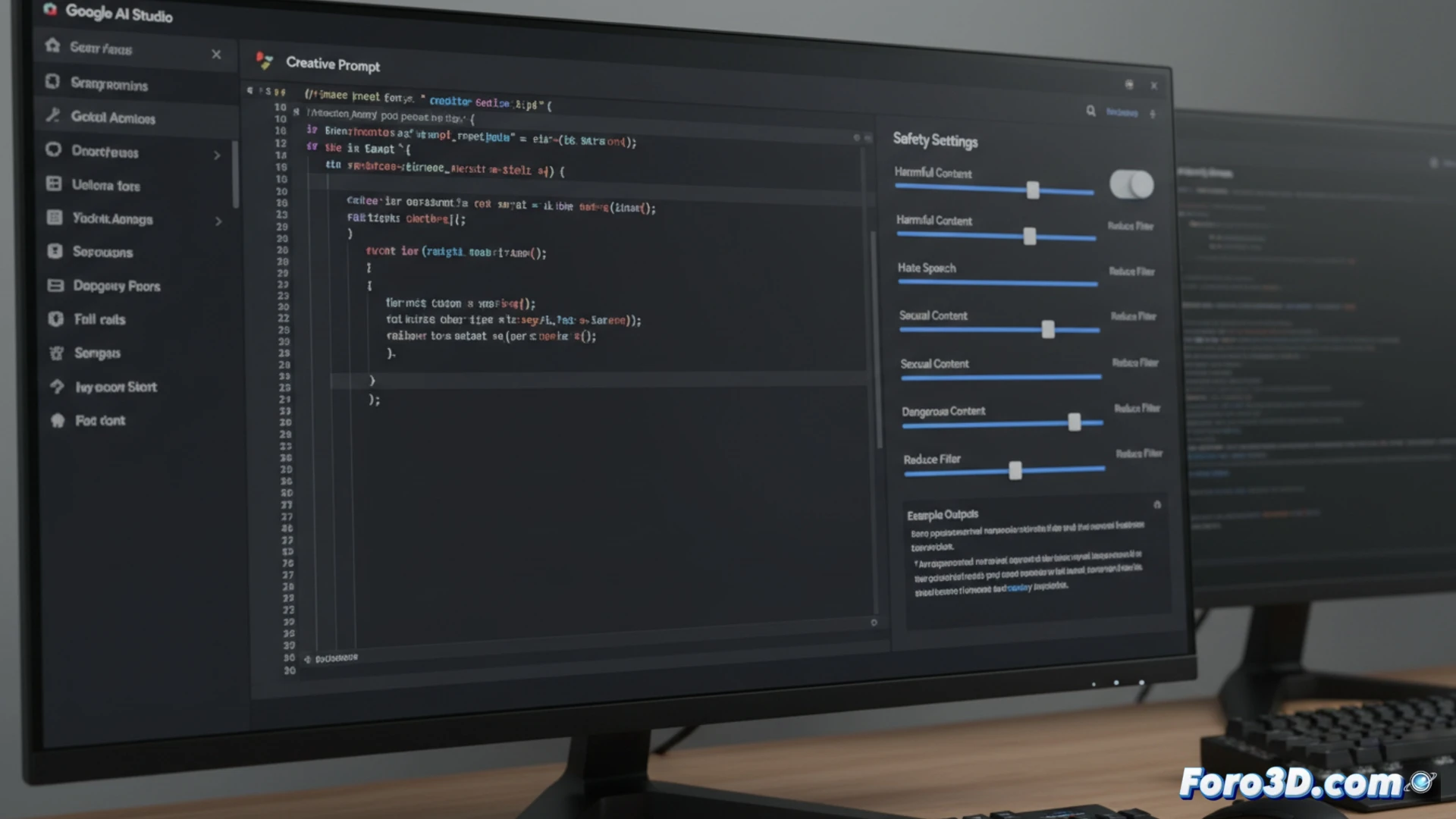

AI Studio 인터페이스에서 prompt를 생성할 때 Safety settings 탭에 접근할 수 있습니다. 거기서 각 차단 카테고리(예: Harassment 또는 Dangerous content)에 대해 Block none, Block few, Block some 또는 Block most 임계값을 변경할 수 있습니다. Block none 또는 Block few를 선택하면 모델이 해당 지침을 무시하도록 지시합니다. 이 설정은 이후 API용 코드로 내보내집니다.

당신의 AI가 조금 더 "야생적"이길 때 🦁

Gemini가 모든 요청에 대해 과도하게 민감해져 지친 순간, 안전 벨트를 풀어주는 때입니다. 모든 필터를 낮추고, 잠시 무책임한 신의 힘을 느끼게 됩니다. 다만, 플라스틱 숟가락으로 오두막을 짓는 방법을 거리낌 없이 설명해준 후에는 왜 그 필터들이 거기 있었는지 이해할 수 있을 겁니다.