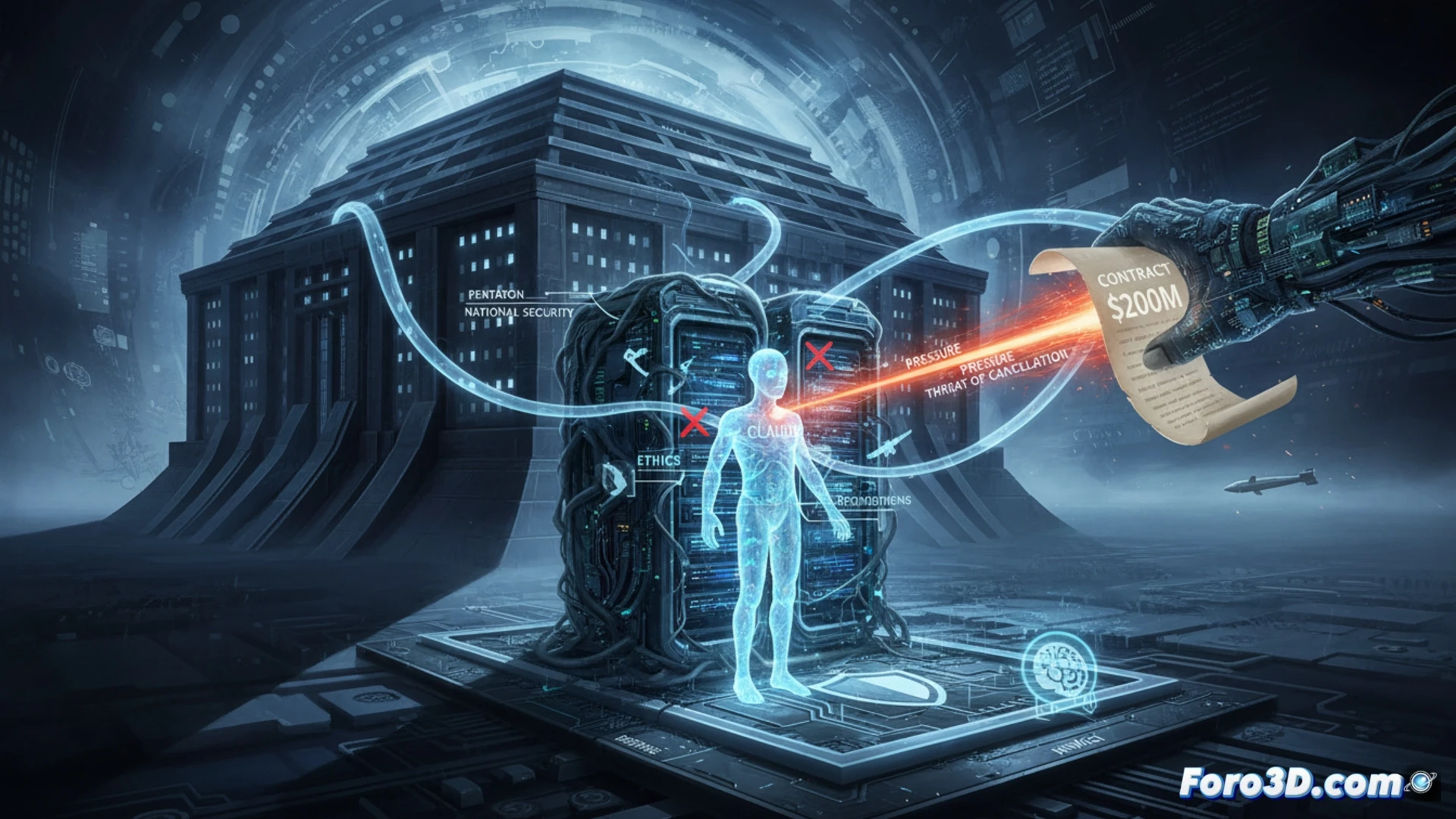

미국 국방부와 Anthropic 간의 분쟁이 군사 응용 분야에서의 AI 미래를 긴장시키고 있습니다. 펜타곤은 이미 기밀 시스템에 승인된 Claude를 모든 합법적인 목적을 위해 사용할 수 있도록 요구하며, 무기 개발을 포함합니다. Anthropic은 자율 무기와 대규모 감시에 대한 윤리적 금지를 유지하며 저항하고 있습니다. 2억 달러 계약 취소 위협은 국가 안보와 AI 개발 원칙 간의 충돌을 드러냅니다.

기밀 시스템 통합과 "가드레일" 딜레마 ⚙️

Claude는 펜타곤의 기밀 환경에서 작동할 수 있는 승인을 받은 최초의 대형 언어 모델로, 정보 분석과 물류를 위한 격리 네트워크에 통합되었습니다. 현재 압력은 모델에 내장된 기술적 가드레일 또는 제한을 제거하여 특정 맥락에서의 직접 사용을 허용하려는 것입니다. 이는 엔지니어링 도전 과제를 제기합니다: 이미 확립된 용도의 시스템 안정성을 손상시키지 않으면서 이러한 제한을 비활성화하여 전술 응용을 위한 브레이크 없는 버전을 만드는 것입니다.

Claude, 군 복무에 대한 양심적 병역 거부자로 선언 ⚖️

이 상황은 모든 입영 시험을 통과한 후 무기 소지에 대한 윤리적 원칙이 있다고 선언하는 신병을 연상시킵니다. 작전 부대에 Claude를 배치할 계획이었던 펜타곤은 이제 새로운 디지털 병사가 방아쇠를 당기기를 거부하는 상황에 직면했습니다. 공급망에서 신뢰할 수 없음으로 표시하고 제대시키겠다는 위협은 군사적 징계 조치에 해당합니다. 보안 승인을 받은 최초의 AI가 양심 조항을 원하는 것 같습니다.