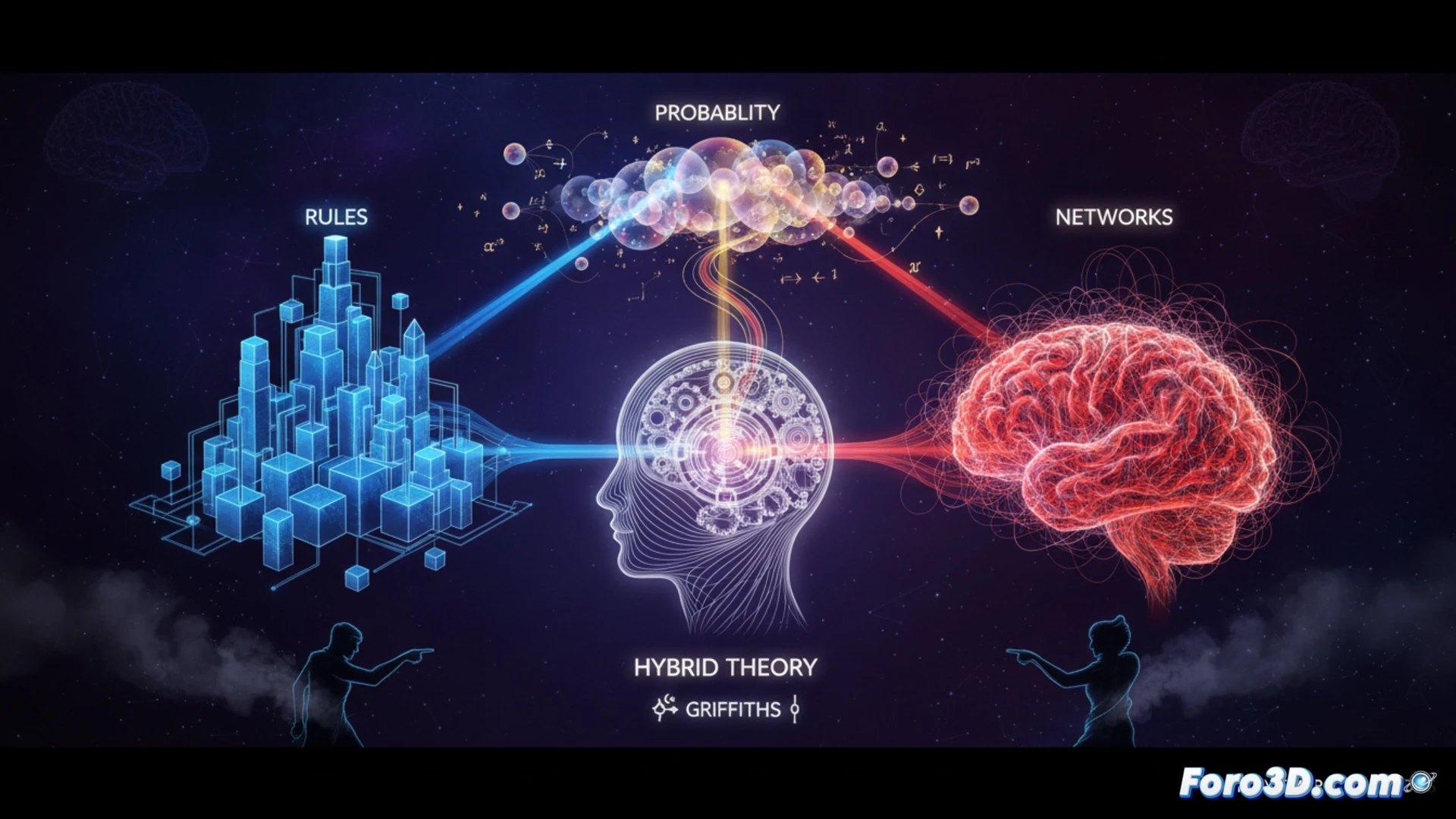

지능에 대한 연구는 역사적으로 두 가지 모델 사이에서 오락가락해 왔습니다: 논리와 기호에 기반한 계산적 모델과 신경망에 중점을 둔 연결주의 모델입니다. Tom Griffiths는 The Laws of Thought에서 완전한 이론을 위해 세 가지 수학적 기둥을 통합해야 한다고 제안합니다: 기호 규칙, 신경망, 그리고 확률 계산입니다. 이러한 하이브리드 관점은 복잡한 네트워크에서 순수하게 등장하는 지능을 옹호하는 The Emergent Mind와 같은 입장과 대립합니다.

LLM의 한계를 극복하기 위한 하이브리드 아키텍처로 나아가기 ⚙️

현재의 대형 언어 모델은 주로 연결주의적이며, 이는 자연어 처리 능력과 견고한 논리적 추론 부족을 설명합니다. 제안된 통합은 정확한 추론 및 계획 작업을 위한 기호 규칙 모듈과 불확실성 관리 및 소량 데이터 학습을 위한 베이지안 확률 프레임워크를 추가할 것입니다. 이러한 아키텍처는 논리적 불일치나 수학적 추론 어려움과 같은 실패를 해결할 수 있습니다.

당신의 AI가 양극성인가요? 아마 두 가지 수학적 프레임워크가 부족할 수 있습니다 🤔

이해할 만합니다. 어느 날 당신의 어시스턴트는 완벽한 소네트를 쓰고, 다음 날 2+2를 더할 때 소수 하나를 지어내며 모릅니다. 미친 게 아닙니다. 연결주의적 마음이 패턴으로 과부하되고 논리가 없기 때문입니다. Griffiths에 따르면, 통합 치료가 필요합니다: 기호 정신분석가와 확률 치료사. 그렇게 하면 충분한 확신으로 제안하면 닭이 세 다리를 가진다고 확신하며 주장하는 것을 그만둘 수 있을지도 모릅니다.