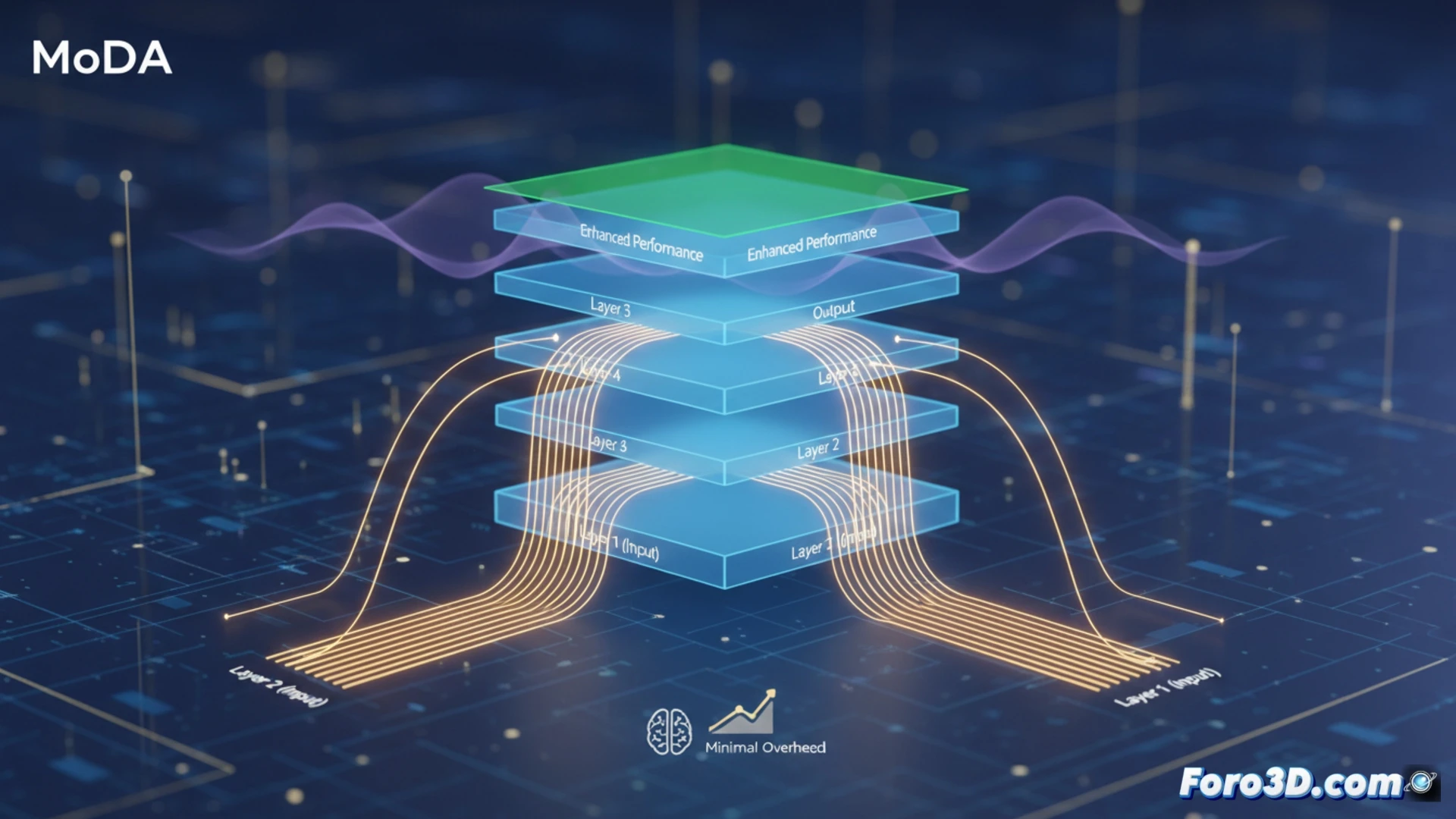

大規模言語モデルの深さをスケーリングすることはその能力の鍵ですが、問題があります:信号の劣化です。情報が数十または数百の層を通過するにつれて、初期層で形成された有用な特徴が希釈され、深い層で失われます。新たな研究がMixture-of-Depths Attention (MoDA)を提案します。これは革新的なメカニズムで、注意ヘッドが現在の層だけでなく、前の層の重要な情報にもアクセスできるようにし、重要な信号を保持し、計算オーバーヘッドを最小限に抑えつつモデルの性能を向上させます。

MoDAの仕組みと効率的な実装 🤖

技術的に、MoDAは標準的な注意機構を修正します。各層で、各注意ヘッドは2つのキー-バリュー対のセットに注意を向けます:現在の層のシーケンスのものと、前の層から抽出された深さ方向のセットです。これにより、さもなくば希釈されていた情報的な特徴を回復・強化できます。これを実際的にするため、研究者たちはハードウェア効率的なアルゴリズムを開発し、非連続メモリアクセス問題を解決し、64Kトークンの長いシーケンスでFlashAttention-2の97.3%の効率を達成しました。これにより、MoDAは大規模トレーニングに実用的になります。

深いモデルの未来への示唆 🚀

結果は有望です:1.5Bパラメータのモデルで、MoDAはFLOPsのわずか3.7%のオーバーヘッドでperplexityと下流タスクの性能を向上させます。また、一般的な層後正規化でより良く機能します。これはMoDAが単なるパッチではなく、深さをより効果的にスケーリングするための基本的なアーキテクチャプリミティブであることを示唆します。その効率は、計算コストを抑えつつより深く能力の高いモデルへの扉を開き、より強力でアクセスしやすいLLMの開発を加速します。

MoDA技法は深いLLMにおける信号劣化問題をどのように解決し、これはより能力が高くアクセスしやすい人工知能の開発にどのような示唆をもたらすでしょうか?

(PD: 技術的なあだ名は子供のようなもの:あなたが名付けるが、コミュニティがどう呼ぶかを決める)