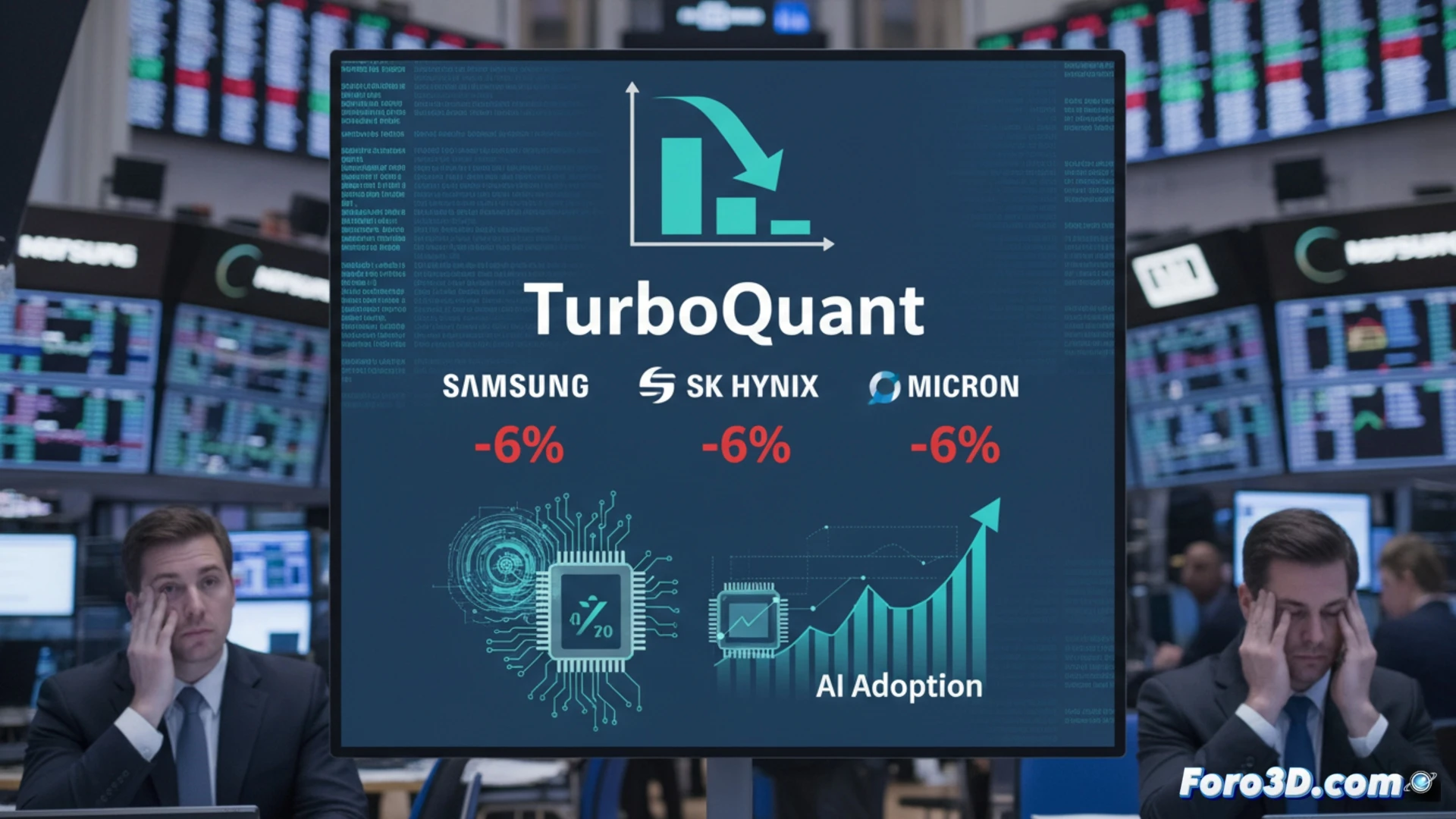

GoogleはTurboQuantを発表しました。これは、AI推論に必要なメモリを最大6倍削減する言語モデル圧縮技術で、精度を損なうことなく実現します。この発表により、Samsung、SK Hynix、Micronなどのメモリ大手企業の株価が即座に約6%下落しました。市場の懸念は明らかです:ソフトウェアが劇的に効率化されれば、AIに不可欠なDRAMおよびHBMメモリハードウェアの需要が大幅に減少する可能性があります。🚀

技術的影響:チップあたりのHBMが減り、ウェハーあたりのチップが増える💡

AIプロセッサをGPUとして視覚化すると、そのアーキテクチャは高帯域幅メモリHBMのスタックに依存しており、これは製造が複雑で高価なコンポーネントです。TurboQuantはモデルウェイトを圧縮することで、実行中にHBMに保存する必要性を減らします。これにより、将来の設計ではチップあたりのメモリスタック数が少なくなるか、容量が小さくなる可能性があり、シリコン上のスペースを解放し、材料コストを削減します。生産規模では、単位あたりの需要減少により、半導体ウェハーからより多くの最終チップが得られ、ファウンドリやメモリメーカーの生産能力計算を変えることになります。

短期的なパニック対構造的な機会🤔

株価の反応は破壊への恐怖を反映していますが、長期的な見通しはよりニュアンスがあります。より効率的で低コストなAI推論は参入障壁を下げ、デバイスやサービスでの大量採用を促進します。この普及は、メモリの総需要を増大させる可能性があり、アプリケーションが多様化し、チップの種類も異なるものになるでしょう。半導体産業は適応する必要があります:価値はギガバイトの販売だけではなく、圧縮された効率的なモデルに最適化されたメモリと処理の統合ソリューションにあります。

GoogleのTurboQuantのようなモデル圧縮が、AIハードウェアにおける高密度メモリと3D-ICアーキテクチャの採用をどのように推進するでしょうか?

(PD: 3Dでチップをモデリングするのは簡単、難しいのはレゴの街に見えないようにすること)