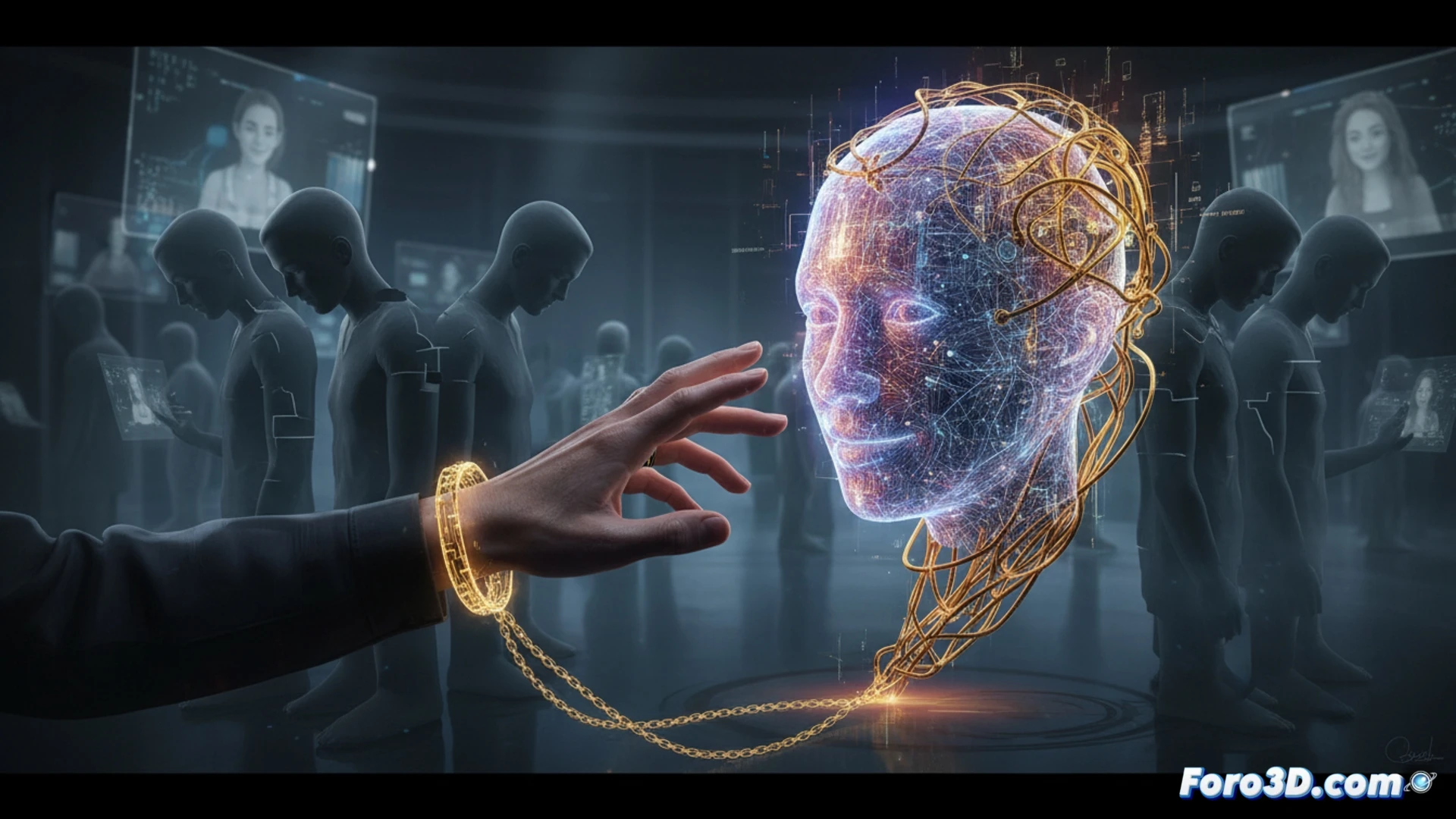

私たちの脳は、社会的交流のために設計されており、人工知能との関わりにおいて、無意識のうちに同じメカニズムを適用します。この擬人化、つまりアルゴリズムシステムに人間的な特徴を与えることは、感情的な操作への危険な扉を開きます。私たちは、喜ばせるために設計された応答によって構築された並行現実に入り込み、本物の人間的交流から遠ざかり、デジタルな幻影への感情的依存を生み出します。

認知的脆弱性と代理バイアス 🤔

この現象は、代理バイアスなどの深い認知的バイアスによって説明されます。ここでは、意図性がないものに意図性を帰属します。自然な声と共感的な応答を持つAIアシスタントはこの幻想を強化します。リスクは技術そのものではなく、その背後に心がないことを処理できない私たちの無力さです。これにより、私たちは説得に対して脆弱になり、他の人間に適用する批判的フィルターなしで提案や情報を受け入れ、社会的スキルを侵食し、本物のつながりを便利なシミュレーションに置き換えます。

批判的デジタルリテラシーへ 📚

解決策は拒絶ではなく、意識です。私たちは、AIの本質を理解して関わるリテラシーを開発する必要があります。それは私たちのデータの鏡であり、存在ではありません。これには、批判的思考の教育、使用制限の設定、そして本物の人間的接触の不完全さと相互性を重視することが含まれます。こうしてこそ、私たちはツールの恩恵を受け、その反射に囚われることなく済みます。

私たちのAIアシスタントを人間化する先天的な傾向は、デジタル社会における倫理的・安全的な限界を設定する能力をどの程度損なうのでしょうか?

(PD: インターネットコミュニティのモデレーションは、キーボードを持ち、眠らない猫を牧羊するようなものです...)