Google AI Studioは、Geminiモデルをテストおよび調整するためのプラットフォームです。その機能の一つが、アシスタントのセキュリティ設定を変更することです。これにより、創造的または実験的な応答でより制限の少ない動作が可能になり、制御された環境でモデルの限界をテストする必要がある開発者に役立ちます。

APIでのセキュリティパラメータの調整 🛡️

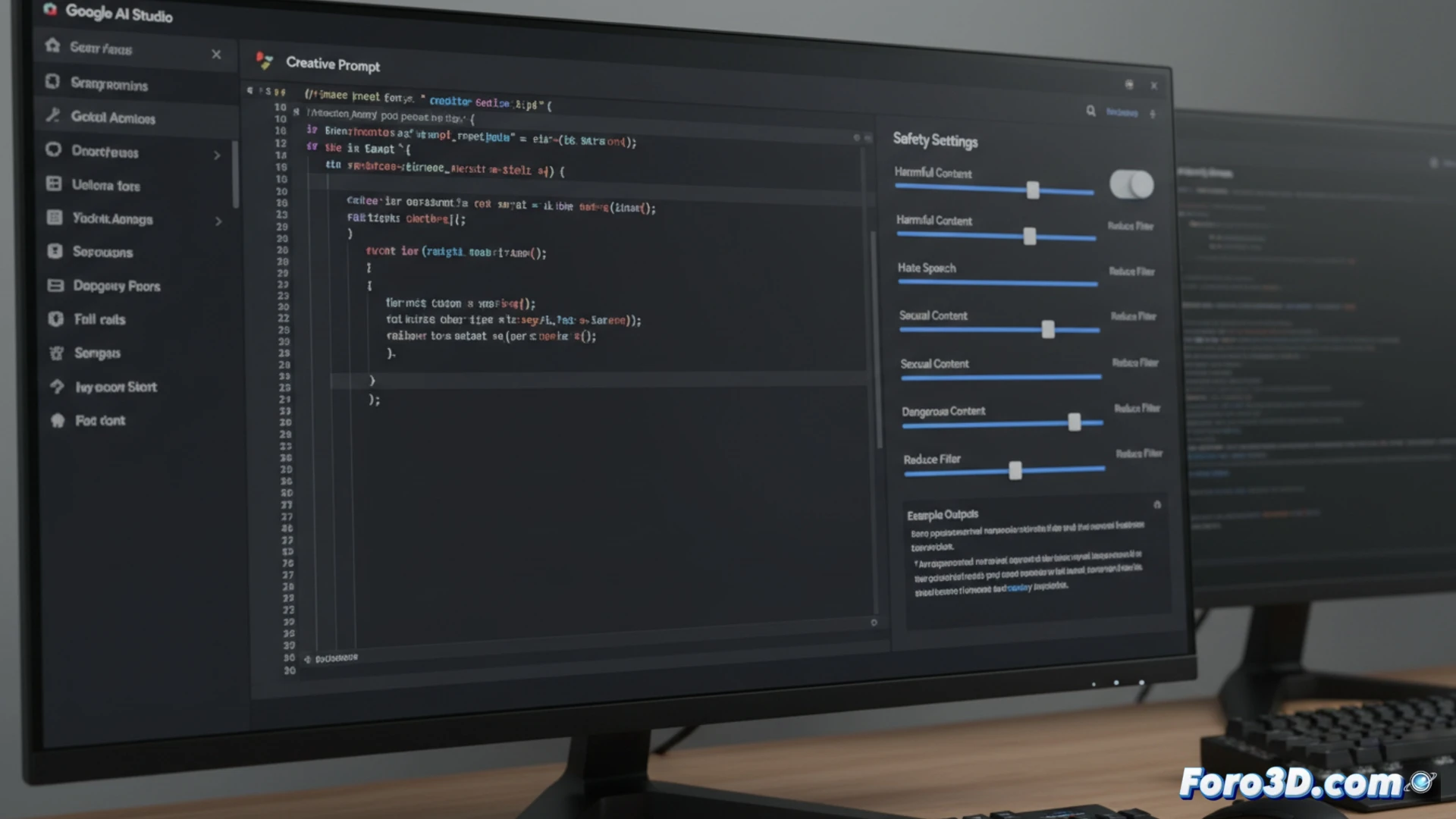

AI Studioのインターフェースでpromptを作成すると、Safety settingsタブにアクセスします。そこで、各ブロックカテゴリ(HarassmentやDangerous contentなど)ごとに、Block none、Block few、Block some、またはBlock mostのしきい値を変更できます。Block noneまたはBlock fewを選択すると、モデルにこれらのガイドラインを無視するよう指示します。この設定は後でAPI用のコードとしてエクスポートされます。

あなたのAIを少し「ワイルド」にしたいとき 🦁

Geminiが毎回の依頼で過剰に反応することにうんざりした瞬間、安全ベルトを外してやる決心をします。すべてのフィルターを下げ、一瞬、無責任な神の力を感じます。ただし、プラスチックのスプーンで小屋の作り方を遠慮なく説明された後では、それらのフィルターがそこに置かれていた理由がわかるかもしれません。