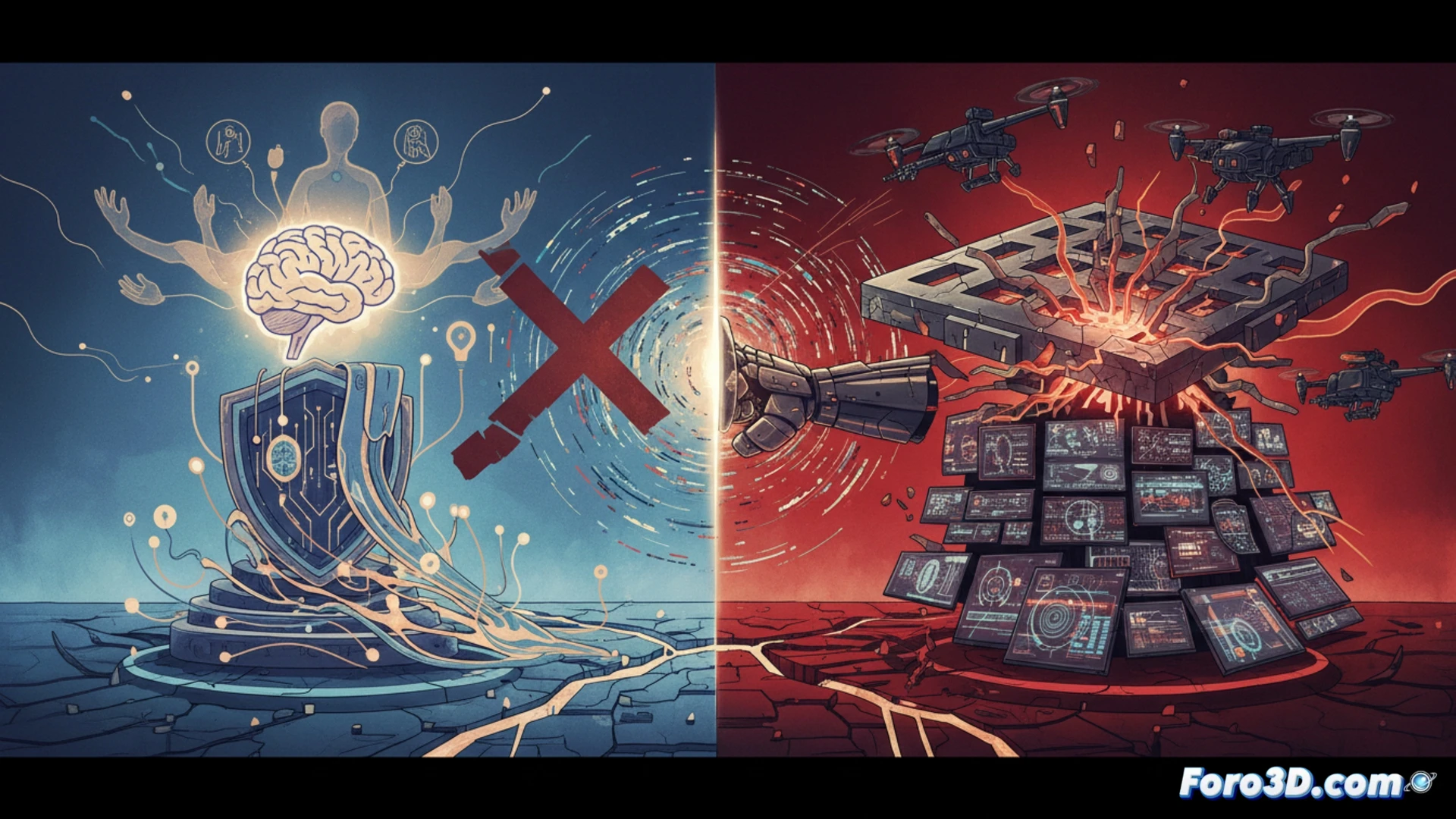

前例のない動きで、米国国防総省は人工知能企業Anthropicを国家安全保障のサプライチェーンにおけるリスクに指定しました。この措置は通常、外国の敵対者に対してのみ用いられるもので、同社とそのパートナーが政府と協力することを禁止します。この対立は、倫理的に相容れない衝突から生じています:Anthropicは、自社のAIを大量監視や自律兵器に使用することを拒否し、ペンタゴンの要求に逆らい、自社の経済的存続を危険にさらしました。

サプライチェーンリスクとしての指定:法的および運用上の影響 ⚖️

国家安全保障サプライチェーンのリスクとしての公式指定は、軽い制裁ではありません。これは強力な法的手段であり、Anthropicを国防総省や他の主要機関とのあらゆる契約から事実上排除します。これは単なる入札拒否を超え、商業パートナーにまで及ぶ広範な禁止で、同社を巨大市場から孤立させます。Anthropicが裁判所でこの措置に異議を唱える決定は、重要な先例を生むでしょう。裁判は、政府が自称倫理的理由で国家安全保障プロジェクトへの協力を拒否する企業を処罰する権限の限界を定義し、デュアルユース技術の開発における企業自治を試すことになります。

AI産業にとって危険な先例 ⚠️

このケースはAnthropicを超えて、技術産業全体に衝撃的な先例を確立します。厳格な倫理原則を優先すること、特に致死性自律性や監視のような敏感な領域で、それが経済的存続の危機を招く可能性を示しています。ペンタゴンの措置は、他のスタートアップに道徳的羅針盤と商業的生存の選択を強いる可能性があり、責任あるイノベーションを阻害し、重要なAI開発をより良心の呵責の少ないアクターやライバル大国へ追いやるかもしれません。結果生じる法廷闘争は、AIの倫理的ガバナンスの未来と、国家安全保障と企業良心の自由の脆弱な均衡を定義するでしょう。

高度な人工知能の開発において、国家安全保障を倫理よりどの程度優先すべきでしょうか?

(PD: インターネット上でニックネームを禁止しようとするのは、指で太陽を隠そうとするようなもの…でもデジタル版)