マルチモーダルモデルが視覚を失っても言語を維持する場合

マルチモーダルモデルの最適化により速度と効率を向上させると、興味深い非対称性が明らかになります:視覚処理能力は言語的推論能力よりもはるかに速く劣化します。この不均衡は、インテリジェントアシスタントから家庭用ロボット自動化まで、正確な視覚解釈に依存するシステムにとって重要な障害となります。👁️🗨️

マルチモーダル圧縮の根本的な問題

開発者がマルチモーダルモデルのサイズを縮小して性能を向上させると、視覚理解が言語処理に比べて不均衡に影響を受けます。この劣化は、言語コンポーネントが分析能力をある程度保持していても、シーンやオブジェクトの誤った解釈を引き起こす可能性があります。実際の結果として、一見機能しているシステムが正確な視覚知覚を必要とするタスクで深刻なエラーを犯すことがあります。

視覚-言語非対称性の結果:- 写真や視覚シーンを誤解釈する仮想アシスタント

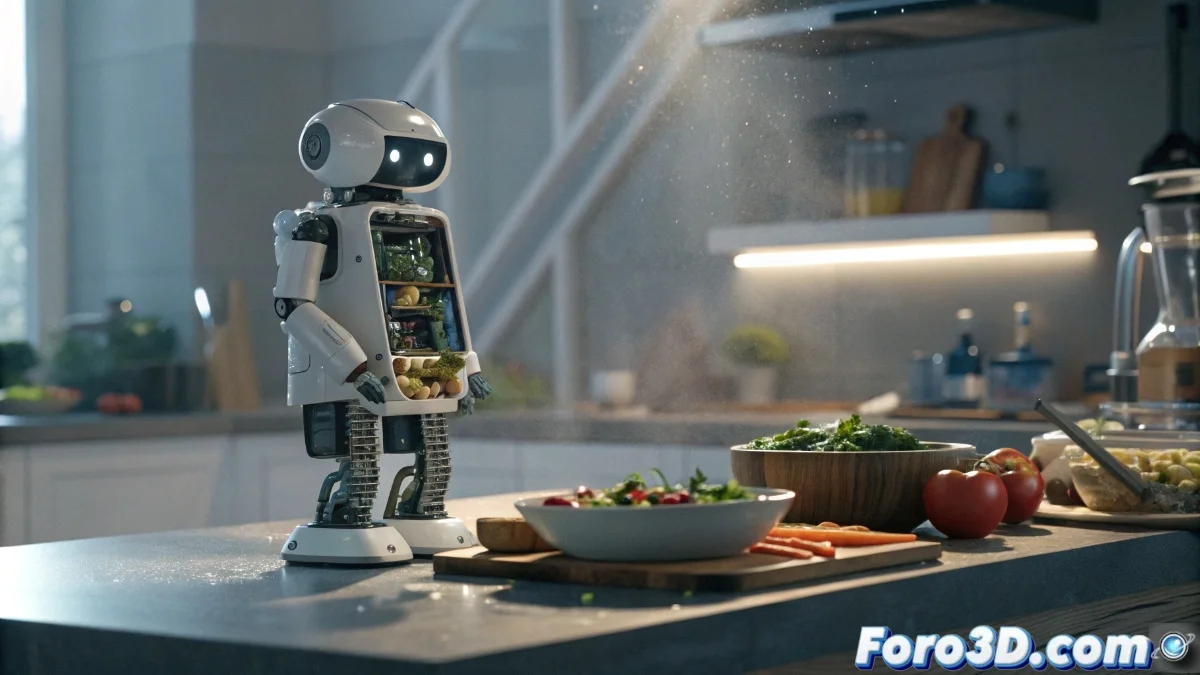

- オブジェクトやコンテキストを認識しにくい家庭用ロボット

- 視覚的に複雑な環境で失敗する自動化システム

"小さなモデルでの視覚知覚の劣化は、言語コンポーネントが推論能力を保持していても誤った解釈を引き起こす可能性があります"

Extract+Think:2段階の解決策

研究では、明確に定義された2つのフェーズで動作するExtract+Thinkという手法を提示しています。まず、モデルを特定の指示ごとに一貫して関連する視覚詳細を抽出するよう訓練します。その後、システムは識別された視覚要素に対してステップバイステップの推論を適用して正確な応答を生成します。この構造化されたアプローチにより、コンパクトなモデルでも分析前に重要な側面に焦点を当てることで高い視覚理解レベルを維持します。

Extract+Thinkアプローチの利点:- 関連する視覚詳細の選択的抽出

- 識別された要素に対する構造化された推論

- 最適化されたモデルでの視覚能力の保持

リソース制限環境での実用的応用

この手法の利点は、ハードウェア能力が制限された現実世界のシナリオで特に価値があります。画像を分析する仮想アシスタントは、まず重要なオブジェクトと詳細を特定してからそれらについて推論することで、シーンの正しい理解を維持できます。同様に、計算リソースが限られた家庭用ロボットは、この抽出と逐次推論プロセスを通じてキッチンの材料を認識し、レシピを正確に実行できます。

ハードウェア制限下のユースケース:- 環境の写真を分析するモバイル仮想アシスタント

- 日常のオブジェクトと相互作用する低コスト家庭用ロボット

- リアルタイムで視覚情報を処理する組み込みシステム

人間学習 vs 人工学習のパラドックス

人工知能が結論を導く前に本質的なものと付随的なものを分離することを学ぶ必要があるのは皮肉です。これは人間が幼児期に自然に発達させるスキルです。子供たちが幼稚園でこの能力を獲得する一方で、マシンは同等の選択的視覚識別レベルに達するために数年にわたる専門訓練を必要とします。このパラドックスは、人工システムで人間の知覚を再現する基本的な複雑さを強調しています。🤖