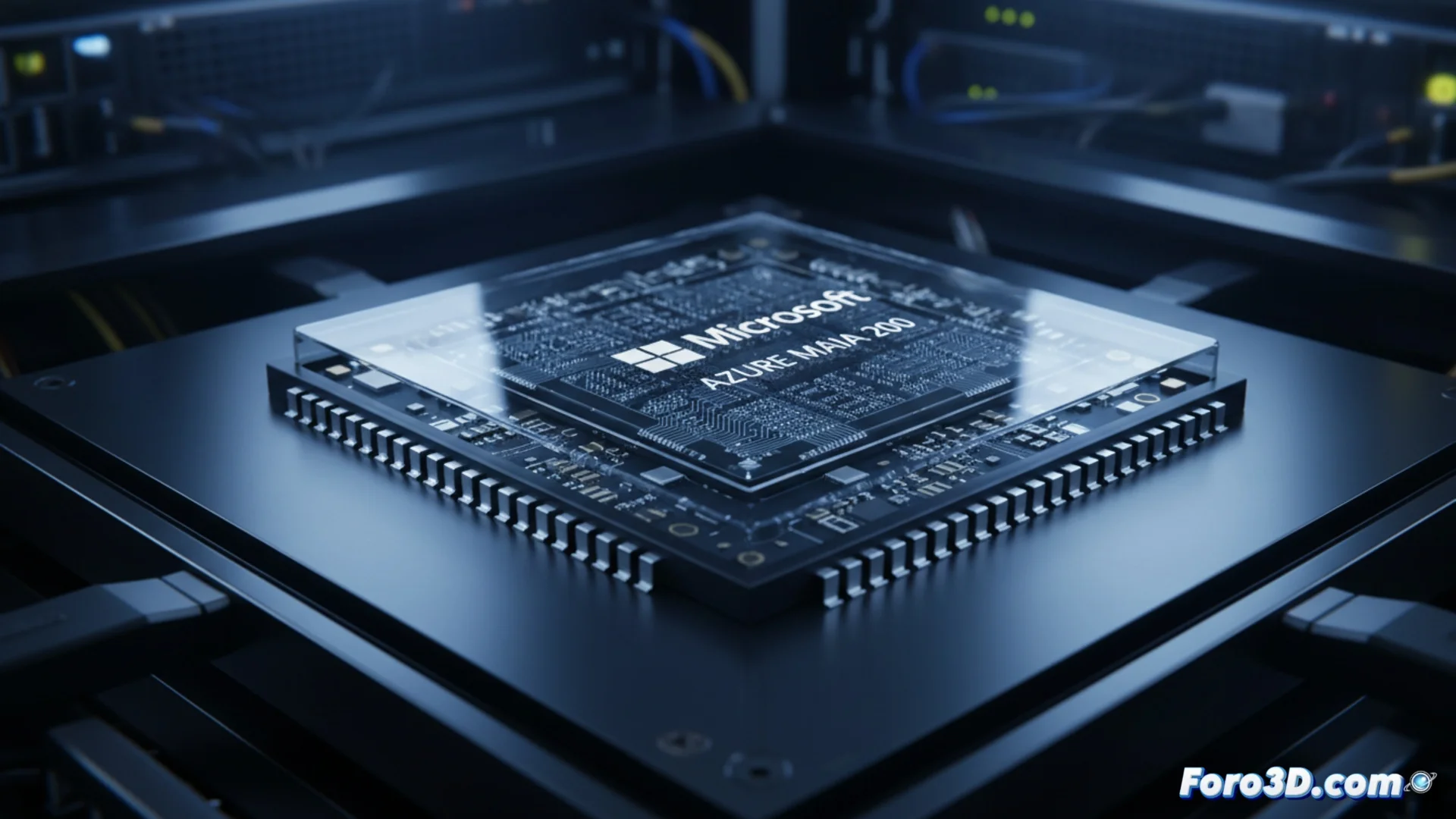

Microsoft、AIアクセラレータAzure Maia 200を発売

テクノロジー企業Microsoftは、新しい人工知能アクセラレータ、Azure Maia 200を発表しました。このコンポーネントは、サーバーで動作するように特別に作成されたMaiaプロセッサファミリーの進化を表しています。主要な役割は、すでに訓練されたAIモデルを実行し、応答と予測を生成することです。Microsoftはこのハードウェアを、AmazonやGoogleなどの競合他社が現在提供しているものを上回る速度と効率でこれらの操作を処理するように設計しています。🚀

推論のための効率と速度に焦点

Azure Maia 200は、Azureクラウドプラットフォーム内で大規模なAIモデルの実行を最適化することを目的として製造されています。自社チップを生産することで、Microsoftはハードウェアとソフトウェアの全チェーンに対するより直接的な制御を目指し、システムがデータを処理する方法をより精密に調整できるようにします。この方法は、待ち時間を短縮し、大規模言語モデルから画像分析システムまでの複雑なモデルの実行時のエネルギー使用を改善しようとします。同社はアーキテクチャのすべての詳細を示していませんが、現在のモデルの巨大なパラメータセットを管理するためのメモリ容量とチップ間の接続方法を優先する設計であると述べています。

Azure Maia 200の主な特徴:- 高い速度でAI推論タスクを実行するよう設計。

- データセンターでのエネルギー効率を改善することを目指す。

- メモリ帯域幅と相互接続を優先したアーキテクチャ。

新しいグローバル競争はミサイルではなく、トランジスタで戦われ、子猫に関するクエリを誰がより速く処理できるかで決まるようです。

AI向けシリコンの競争環境

Maia 200の発売は、テクノロジーセクター全体の広範な傾向を示しており、大手クラウドサービスプロバイダーが独自の専門チップを開発しています。AmazonはInferentiaとTrainiumプロセッサを保有し、GoogleはTensor Processing Units (TPU)を運用しています。Maia 200を発表することで、Microsoftはソフトウェアサービスだけでなく、その下のハードウェアの性能でも競争する独自のAIインフラを提供する計画を強化します。同社は、これらのアクセラレータを世界中のデータセンターに展開し、Azure OpenAI Serviceなどのサービスや他の生成AI操作を推進する予定です。

クラウド向けカスタムチップの主なプレーヤー:- Microsoft:推論向けAzure Maia 200。

- Amazon Web Services:InferentiaおよびTrainiumチップ。

- Google Cloud:Tensor Processing Units (TPU)。

クラウドコンピューティングの未来への影響

この動きは、AI覇権をめぐる競争が現在、カスタムシリコンに決定的に依存していることを強調しています。ソフトウェアとハードウェアの両方を制御することで、Microsoftは顧客向けにより統合的で効率的なスタックを提供することを目指します。最終目標は、より大きな複雑な人工知能モデルをより速く、より低い運用コストで処理し、クラウドのパフォーマンスの新基準を定義することです。🔌