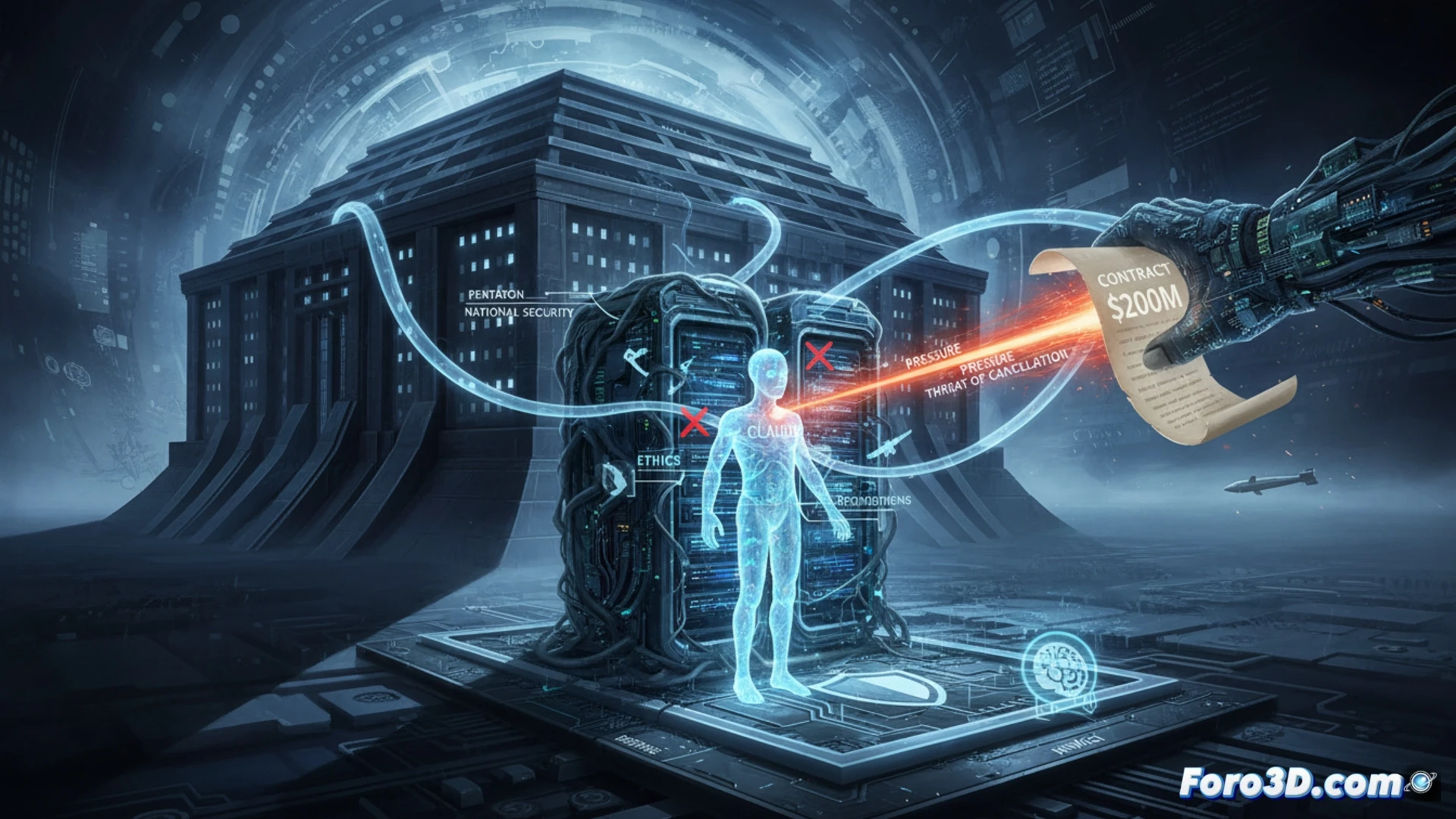

米国国防総省とAnthropicの間の争いが、軍事アプリケーションにおけるAIの未来を緊張させている。ペンタゴンは、すでに機密システムで承認されたClaudeをすべての合法的な目的で使用できるように要求しており、兵器開発を含む。Anthropicは、自律兵器と大量監視に対する倫理的禁止を維持して抵抗している。2億ドルの契約取消しの脅威は、国家安全保障とAI開発原則の衝突を明らかにしている。

機密システムへの技術的統合と「ガードレール」のジレンマ ⚙️

Claudeは、ペンタゴンの機密環境で動作する承認を受けた最初の大型言語モデルで、インテリジェンス分析とロジスティクス向けに隔離されたネットワークに統合されている。現在の圧力は、特定の文脈での直接使用を防ぐモデルに埋め込まれたガードレール、つまり技術的制限を削除することを目指している。これはエンジニアリングの課題を生む:既存の確立された用途のシステム安定性を損なうことなくこれらの制限を無効化し、戦術アプリケーション向けのブレーキなしバージョンを生み出すことだ。

Claudeが軍事徴用に対して良心的兵役拒否を宣言 ⚖️

この状況は、すべての入隊試験に合格した後、武器を持つことに対する倫理的原則があると宣言する新兵を思い起こさせる。Claudeを運用ユニットに配置する計画をすでに立てていたペンタゴンは、新しいデジタル兵士が引き金を引くことを拒否していることに直面している。供給チェーンで信頼できないとマークして除隊させる脅威は、軍事的同等の懲戒処分だ。安全保障承認を受けた最初のAIも、良心の条項を望んでいるようだ。