視覚知識蒸留によるLiDARモデルの適応

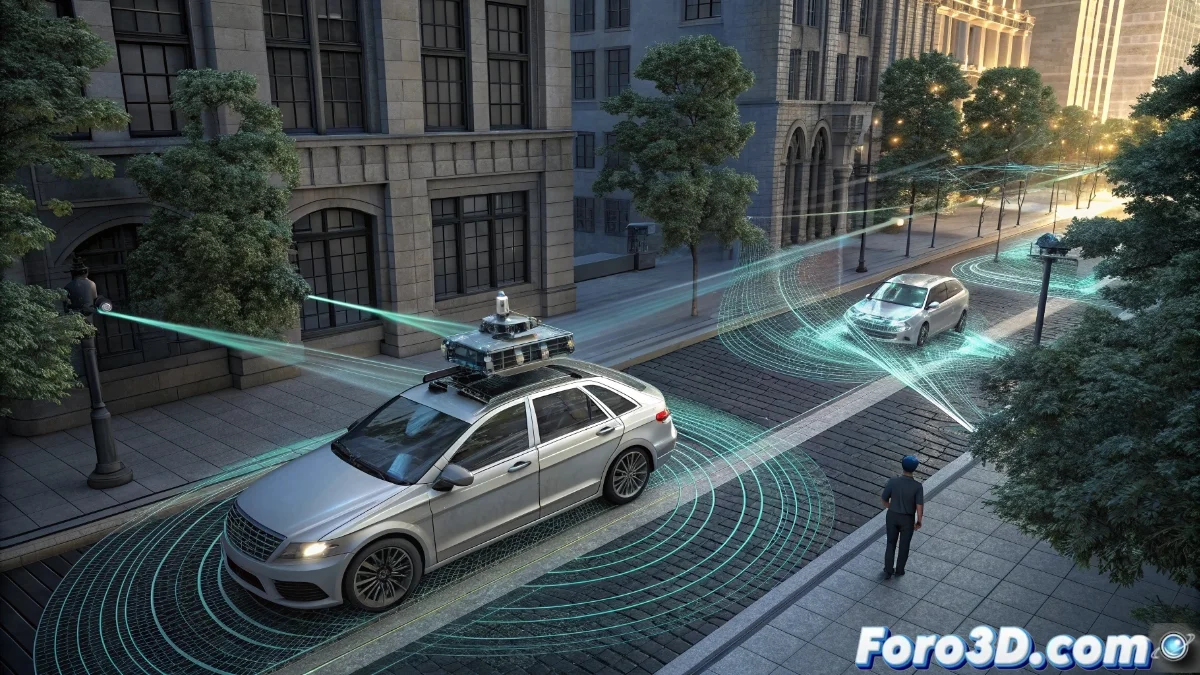

異種LiDARセンサー間の相互運用性は、ロバストな自律システム開発における最も複雑な障害の一つです。特定のセンサーのデータで訓練されたモデルが解像度、スキャンパターン、ノイズレベルの変動に直面すると、そのセマンティックセグメンテーション能力は劇的に低下します 🎯。

マルチモーダル転移の基礎

Vision Foundation Modelsは、非監督蒸留プロセスを通じて視覚表現をLiDARドメインに転移可能な知識に変換するパラダイム的な解決策として登場します。この方法論は、画像モデルの固有の安定性を活用して、新しいセンサードメインでの手動アノテーションを必要とせずに、LiDARモデルの学習を導く豊富な指導信号を生成します 🔄。

クロス蒸留の主要メカニズム:- 視覚モデルが生成教師として機能し、センサー変動に不変な表現を生成

- LiDAR学生が、ラベルなしデータによる広範な事前訓練中にこれらの表現を模倣する学習

- 異なるセンサー構成間の後続適応を容易にする共有潜在空間の確立

マルチモーダル蒸留は、視覚ドメインとLiDARドメイン間に認知ブリッジを作成し、人間が異なる感覚コンテキスト間で知識を転移する能力を再現します

スケーラブルな一般化のためのアーキテクチャ

LiDARバックボーンの選択が転移プロセスの有効性を決定的に決定します。特定のニューラルトポロジーは、視覚ファンデーションモデルから来る安定した特徴を吸収・保持するのに優れています。提案された方法論は、蒸留による単一の事前訓練を可能にし、完全なプロセスを繰り返さずに複数のドメイン変更シナリオで再利用を可能にします 🏗️。

一般化保存戦略:- 新しいセンサーへの最終適応フェーズ中に凍結バックボーンを維持

- セグメンテーション固有タスクのための軽量MLPヘッドの独占訓練

- 密度およびスキャンパターンの変動に耐性のあるロバスト特徴の抽出

実験検証と実用的応用

このアプローチは、特に異なる密度とスキャン構成間の遷移を含む4つの挑戦的な参照シナリオで、従来の方法に対して一貫した優位性を示しました。64ライン回転システムから32ライン構成への自律車両移行などの実装では、事前訓練されたバックボーンが密度低下に対して回復力のある特徴を抽出し、MLPヘッドがこれらの表現を特定のセマンティッククラスに迅速にマッピングする学習をします 🚗。

画像-LiDAR蒸留、再利用可能バックボーン、および軽量適応ヘッドの相乗効果の組み合わせは、ロボット知覚における一般化課題に対処するための効率的でスケーラブルなパラダイムを構成します。この進歩は根本的な概念的変化を表します:LiDARシステムはついに、ツールの変更がゼロから再学習を意味するのではなく、インテリジェントに適応することを学習しています 💡。