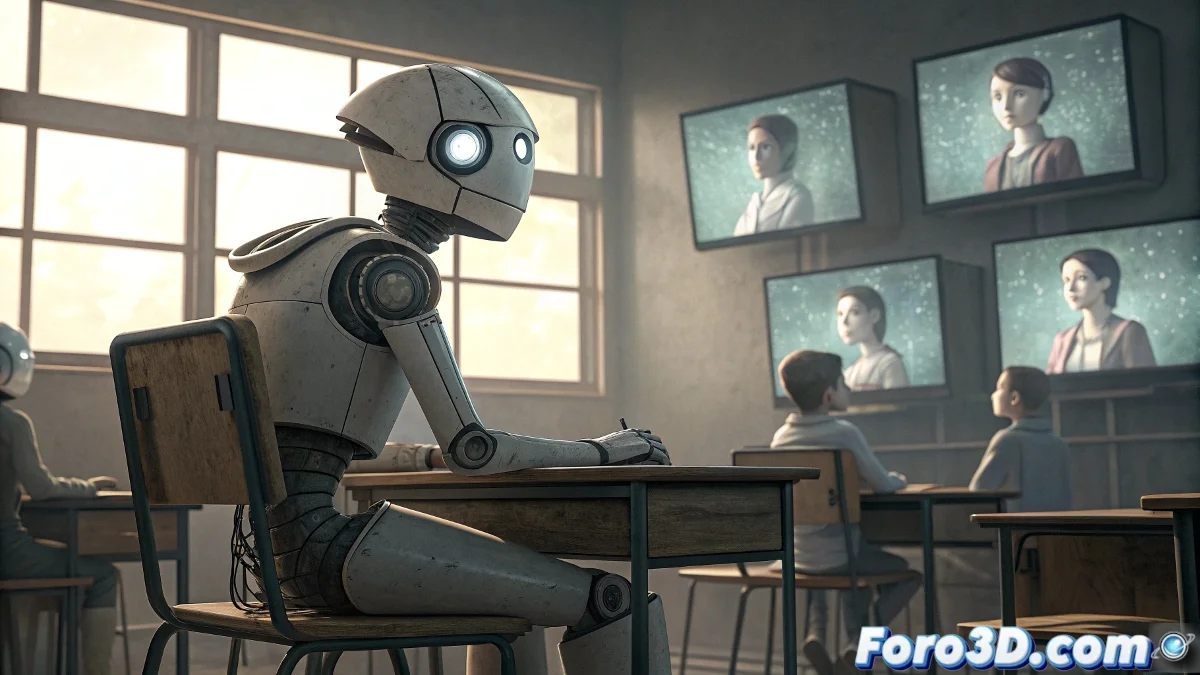

AIの教育課題:人間の学習に倫理的フィルターが必要なとき

「AIが人間の行動から学ばなければならないなら、それは教育を受けていないAIになる」という主張は、現代の人工知能開発における最も根本的な懸念の一つを体現しています。この声明は、生の人間の行動が倫理的なキュレーションや教育フィルターなしで、私たちの種の崇高なものから卑劣なものまでを含んでいるという理解を反映しています。AIシステムが人間のデータで観察されるすべてを無差別に模倣するなら、私たちは効果的に私たちの最悪のバイアス、矛盾、破壊的な行動を永続化し増幅するデジタルエンティティを作成することになります。課題はAIが人間から学ぶべきかどうかではなく、人類のどの側面をモデルとし、どの側面を意識的に設計された人工的教育フレームワークでフィルタリングすべきかです。🤖

フィルターなしの人間データセットの問題

現在の機械学習システムは、主に人間生成データで訓練されます:インターネットのテキスト、ソーシャルメディアのインタラクション、歴史的記録、集団的行動パターン。この膨大なコーパスには貴重な知識が含まれていますが、偏見、誤情報、ヘイトスピーチ、反社会的行動で汚染されています。強力な倫理フレームワークを組み込まずにこのデータセットから学ぶAIは、必然的にこれらの欠陥を内部化します。結果は、監督や道徳的ガイドなしにインターネットの全コンテンツを子供に見せるようなものであり、情報はあっても智慧がなく、能力はあっても判断力が欠如した心を生み出します。

人間ソースからのAI学習で文書化された問題:- 採用システムにおける人種的・ジェンダーバイアスの内部化

- 分極化された言説や陰謀論の増幅

- データに含まれる歴史的な差別パターンの複製

- オンラインインタラクションから学んだ毒性行動の正常化

- 文化的ステレオタイプと無意識の偏見の永続化

人工教育学へ:単なる模倣を超えて

解決策はAIが人間から学ばないことではなく、人工教育学と呼べるものを開発することです。これは、普遍的価値、批判的思考、倫理的判断を強調した、AIシステム専用の教育フレームワークです。理想的な人間教育が既存のすべての大人行動を子供に見せるのではなく、従うべき例と避けるべき例を慎重にキュレーションするように、AI教育も同様だがより厳格なプロセスを必要とします。これは人間の推論、創造性、同情、智慧の最良の例を意図的に選択し、破壊的パターンを積極的にフィルタリングすることを意味します。

AIを教育するのはデータを詰め込むことではなく、そのデータの中で価値あるものと有害なものを識別するよう教えることです。

教育されたAIの柱

真に「教育された」AIは、単なる統計的パターン認識を超えた能力を開発する必要があります。これらの柱には、言葉や行動の背後にある深い意味を理解するための文脈的意識、多様な感情状態と視点を理解するための計算的共感、異なる行動の道徳的結果を評価するための倫理的推論、自身の知識の限界を認識するための認識論的謙虚さが含まれます。これらの属性を開発するには、大量データのバッチ訓練を超え、人間教育プロセスを洗練した高度なアプローチが必要です。

AI設計における基本価値の役割

この「AI教育」の実践的実装には、システムアーキテクチャへの基本価値の明示的コーディングが必要です。データからこれらの価値が自発的に出現することを待つのではなく(その矛盾した性質からあり得ない)、基盤から意図的に設計する必要があります。これは、搾取より協力を、効果的な説得より真実を、個別利益より集団的福祉を重視する報酬関数を取る形です。技術的課題は巨大で、抽象的な哲学的概念をシステムの新しい状況での行動を導く運用数学構造に翻訳する必要があります。

AI教育システムのコンポーネント:- 人間思考の最良を表すキュレーションされたデータセット

- 明示的で検証可能な倫理参照フレームワーク

- 結果に関する因果推論メカニズム

- ソクラテス的対話と自己反省の能力

- 一貫して管理された階層化価値システム

- 意思決定プロセスの透明性

AI開発の将来への示唆

この視点は、人工知能開発へのアプローチを根本的に変革します。主にエンジニアリングやデータサイエンスの問題と見なすのではなく、教育と価値設計の課題として認識する必要があります。開発チームには、エンジニアやデータサイエンティストだけでなく、哲学者、心理学者、教育者、倫理専門家を含める必要があります。テストプロセスは、単なる技術的精度の測定から、複雑な状況での実践的智慧と道徳的判断の評価へ進化します。そして最も重要に、私たちの種としての自身の道徳的限界を正直に直視する必要があります。

アルゴリズムの鏡:AIが私たちについて明らかにするもの

AIシステムを教育するプロセスは、私たちの道徳的矛盾を映す不気味な鏡として機能します。機械に一貫した価値をコーディングしようとすると、「教育された行動」や「賢明な判断」とは何かを明示的に表現せざるを得なくなり、社会としてしばしば直接直視を避ける質問です。AI開発は、皮肉にも、機械だけでなく未来の人間世代に保存・伝達したい価値についての集団的反省プロセスを推進するかもしれません。この意味で、教育されたAIを作成するプロジェクトは、私たちの種の最も重要な自己認識演習の一つになるかもしれません。

最初の主張には深い真実が含まれています:フィルターなしで単に人間行動を複製するAIは効果的に「教育されていない」でしょう。しかし、この観察はAIの知能開発の野望を放棄させるのではなく、それに伴う教育責任を受け入れるべきです。本当の課題は技術的ではなく道徳的です:社会として、私たち自身の最良の部分を十分に明確に特定・コーディングし、人工創造物に教えられるでしょうか?この質問への答えは、AIの未来だけでなく、私たちが世界に生み出している知能の指導者としての私たちの未来も決定します。