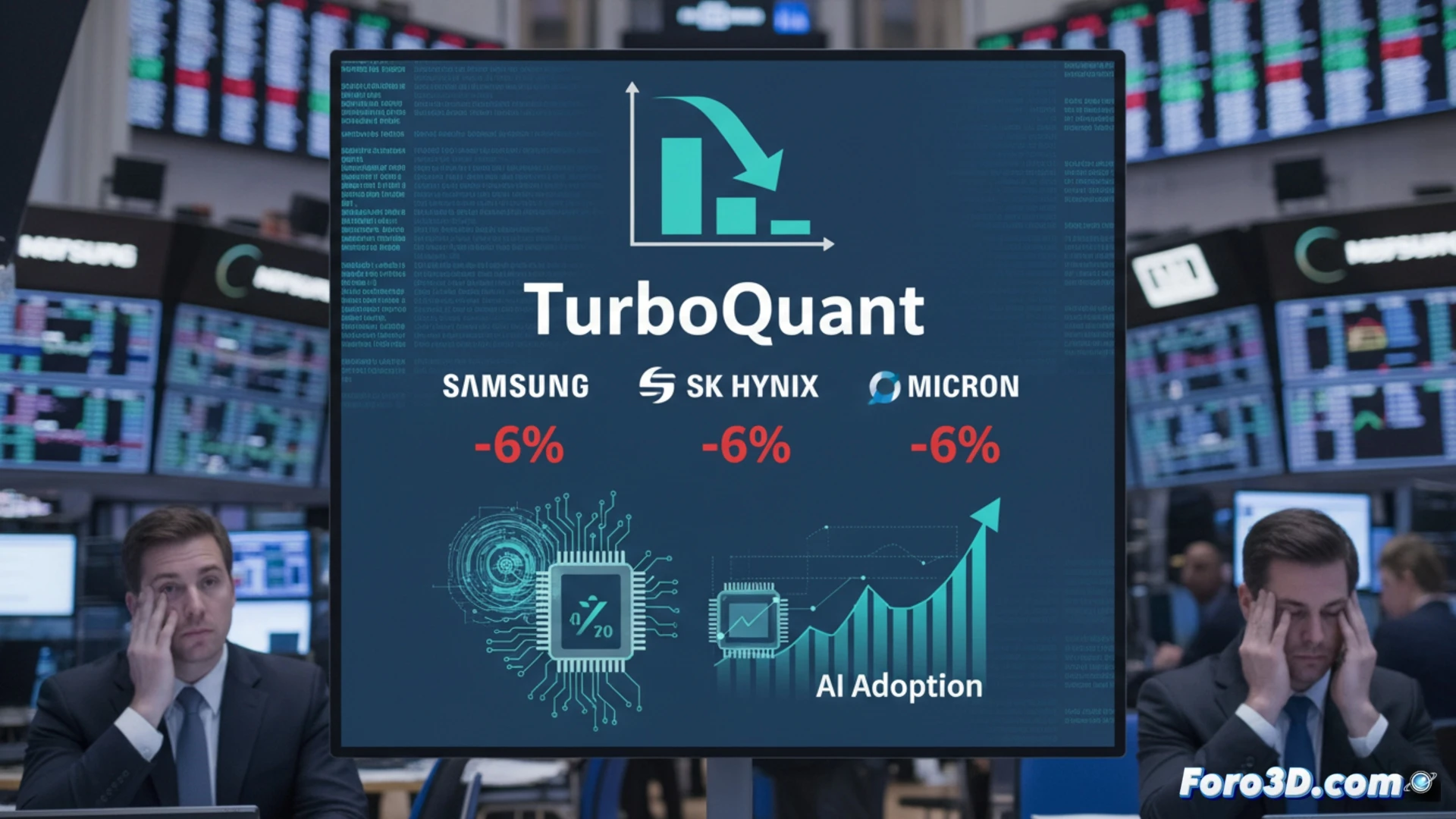

Google ha svelato TurboQuant, una tecnica di compressione dei modelli linguistici che riduce fino a sei volte la memoria necessaria per l'inferenza IA senza perdita di precisione. L'annuncio ha provocato un'immediata caduta borsistica, vicina al 6%, nei giganti della memoria come Samsung, SK Hynix e Micron. La paura del mercato è chiara: se il software diventa radicalmente più efficiente, la domanda prevista di hardware di memoria DRAM e HBM, chiave per l'IA, potrebbe contrarsi significativamente.🚀

Implicazioni tecniche: meno HBM per chip, più chip per wafer💡

Visualizzando un processore per IA come una GPU, la sua architettura dipende da pile di memoria HBM ad alta larghezza di banda, un componente costoso e complesso da fabbricare. TurboQuant, comprimendo i pesi del modello, riduce la necessità di memorizzarli in quell'HBM durante l'esecuzione. Questo potrebbe tradursi in design futuri con meno stack di memoria per chip o con capacità minori, liberando spazio sul silicio e riducendo i costi dei materiali. A scala di produzione, una minore domanda per unità potrebbe significare che un wafer di semiconduttori renda per più chip finali, alterando i calcoli di capacità delle fonderie e dei produttori di memoria.

Panico di breve termine versus opportunità strutturale🤔

La reazione borsistica riflette una paura della disruption, ma il panorama a lungo termine è più sfumato. Un'inferenza IA più efficiente ed economica riduce la barriera d'ingresso, potenziando un'adozione massiccia in dispositivi e servizi. Questa proliferazione potrebbe generare una domanda totale di memoria maggiore, sebbene distribuita in più applicazioni e possibilmente in tipi di chip diversi. L'industria dei semiconduttori deve adattarsi: il valore non sarà più solo nella vendita di gigabyte, ma nell'integrare soluzioni di memoria e elaborazione ottimizzate per modelli compressi ed efficienti.

Come potrebbe la compressione di modelli come TurboQuant di Google impulsar l'adozione di memorie ad alta densità e architetture 3D-IC nell'hardware per IA?

(PD: modellare un chip in 3D è facile, il difficile è che non sembri una città di Lego)