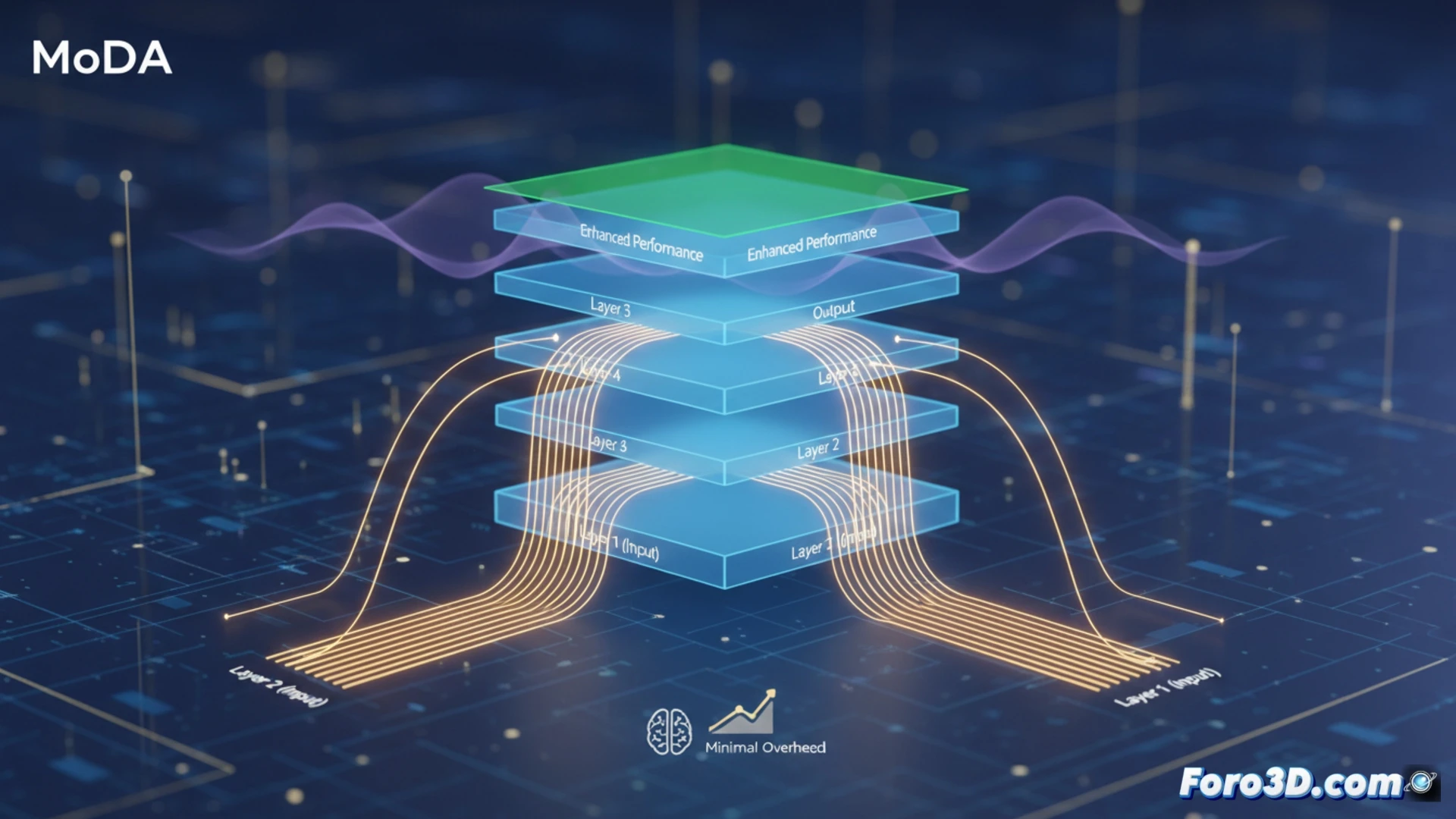

Scalare la profondità dei modelli di linguaggio grandi è chiave per la loro capacità, ma ha un problema: la degradazione del segnale. Man mano che l'informazione attraversa decine o centinaia di strati, i tratti utili formati nei primi si diluiscono, perdendosi in quelli più profondi. Una nuova ricerca propone Mixture-of-Depths Attention (MoDA), un meccanismo innovativo che permette alle teste di attenzione di accedere non solo allo strato attuale, ma anche a informazioni chiave di strati precedenti, preservando così i segnali importanti e migliorando le prestazioni del modello con un sovraccarico computazionale minimo.

Come Funziona MoDA e la sua Implementazione Efficiente 🤖

Tecnicamente, MoDA modifica l'attenzione standard. In ogni strato, ogni testa di attenzione può prestare attenzione a due insiemi di coppie chiave-valore: quello della sequenza nello strato attuale e un insieme in profondità estratto da strati precedenti. Questo permette di recuperare e rafforzare caratteristiche informative che altrimenti si sarebbero diluite. Per rendere ciò pratico, i ricercatori hanno sviluppato un algoritmo efficiente in hardware che risolve il problema degli accessi non contigui alla memoria, raggiungendo il 97.3% dell'efficienza di FlashAttention-2 in sequenze lunghe di 64K token. Questo rende MoDA fattibile per l'addestramento su larga scala.

Implicazioni per il Futuro dei Modelli Profondi 🚀

I risultati sono promettenti: in modelli da 1.5B di parametri, MoDA migliora la perplessità e le prestazioni nei compiti successivi con solo un 3.7% di sovraccarico in FLOPs. Inoltre, funziona meglio con normalizzazione post-strato, una configurazione comune. Questo suggerisce che MoDA non è solo una toppa, ma un primitivo architettonico fondamentale per scalare la profondità in modo più efficace. La sua efficienza apre la porta a modelli più profondi e capaci senza costi computazionali proibitivi, accelerando lo sviluppo di LLMs più potenti e accessibili.

Come può la tecnica MoDA risolvere il problema della degradazione del segnale negli LLMs profondi e quali implicazioni ha ciò per lo sviluppo di intelligenze artificiali più capaci e accessibili?

(PD: i nomignoli tecnologici sono come i figli: tu li nomini, ma la comunità decide come chiamarli)