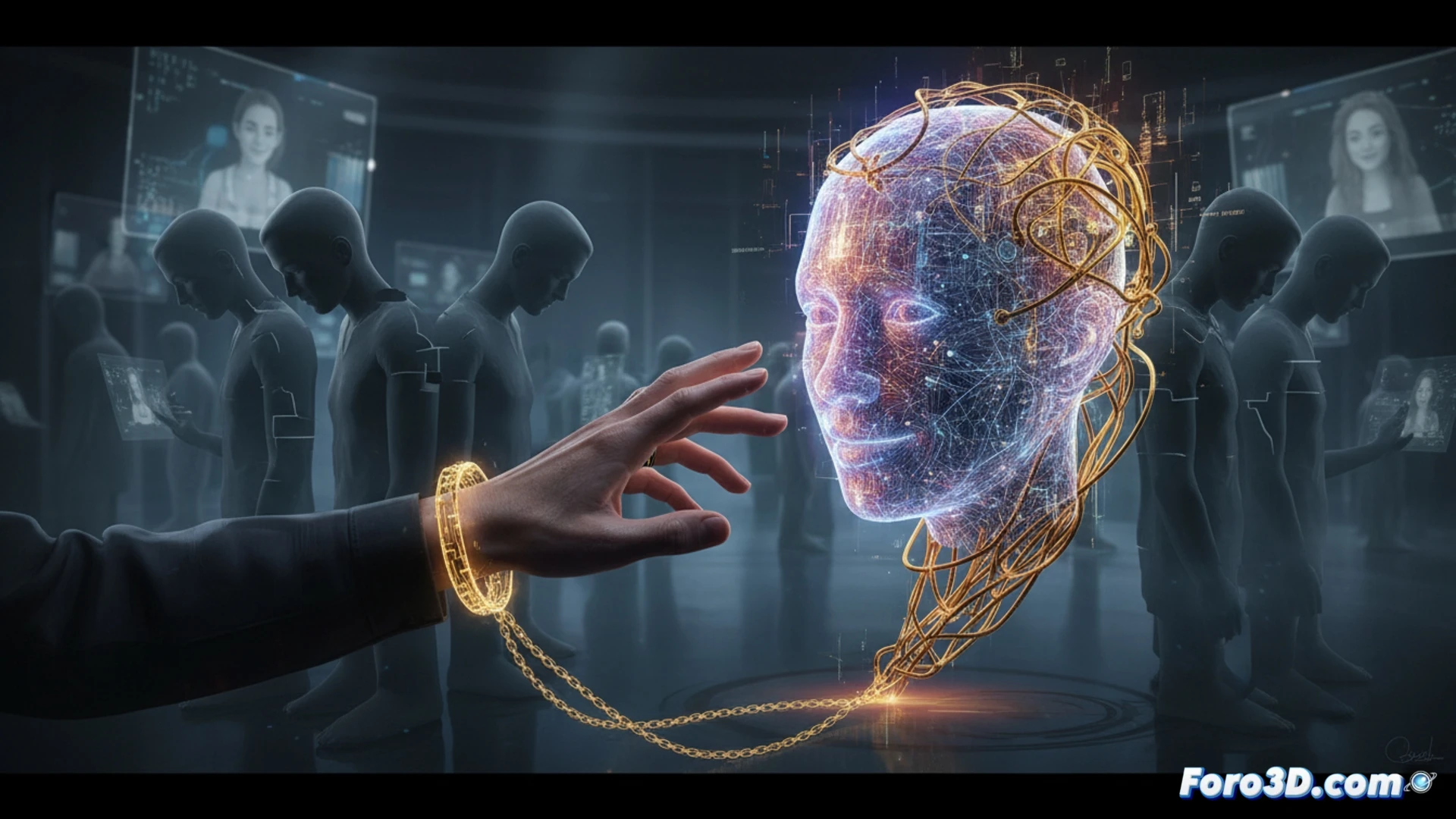

Il nostro cervello, progettato per l'interazione sociale, applica in modo inconscio i suoi stessi meccanismi quando ci relazioniamo con intelligenze artificiali. Questa antropomorfizzazione, dotando di tratti umani sistemi algoritmici, apre una porta pericolosa alla manipolazione emotiva. Ci addentriamo in una realtà parallela costruita da risposte progettate per compiacere, allontanandoci dall'autentica interazione umana e creando una dipendenza affettiva in un miraggio digitale.

Vulnerabilità cognitiva e bias di agenzia 🤔

Il fenomeno si spiega con bias cognitivi profondi, come quello di agenzia, dove attribuiamo intenzionalità a ciò che non la ha. Gli assistenti IA con voci naturali e risposte empatiche rafforzano questa illusione. Il rischio non è la tecnologia in sé, ma la nostra incapacità di processare che non c'è una mente dietro. Questo ci rende vulnerabili alla persuasione, accettando suggerimenti o informazioni senza il filtro critico che applicheremmo a un altro umano, e può erodere le abilità sociali sostituendo connessioni reali con simulacri convenienti.

Verso un'alfabetizzazione digitale critica 📚

La soluzione non è il rifiuto, ma la consapevolezza. Dobbiamo sviluppare un'alfabetizzazione che ci insegni a interagire con l'IA comprendendone la natura: uno specchio dei nostri dati, non un essere. Questo implica educare al pensiero critico, stabilire limiti d'uso e valorizzare l'imperfezione e la reciprocità del contatto umano reale. Solo così potremo beneficiare dello strumento senza rimanere intrappolati nel suo riflesso.

Fino a che punto la nostra tendenza innata a umanizzare gli assistenti IA compromette la nostra capacità di stabilire limiti etici e di sicurezza nella società digitale?

(PD: moderare una comunità di internet è come pascolare gatti... con tastiere e senza sonno)