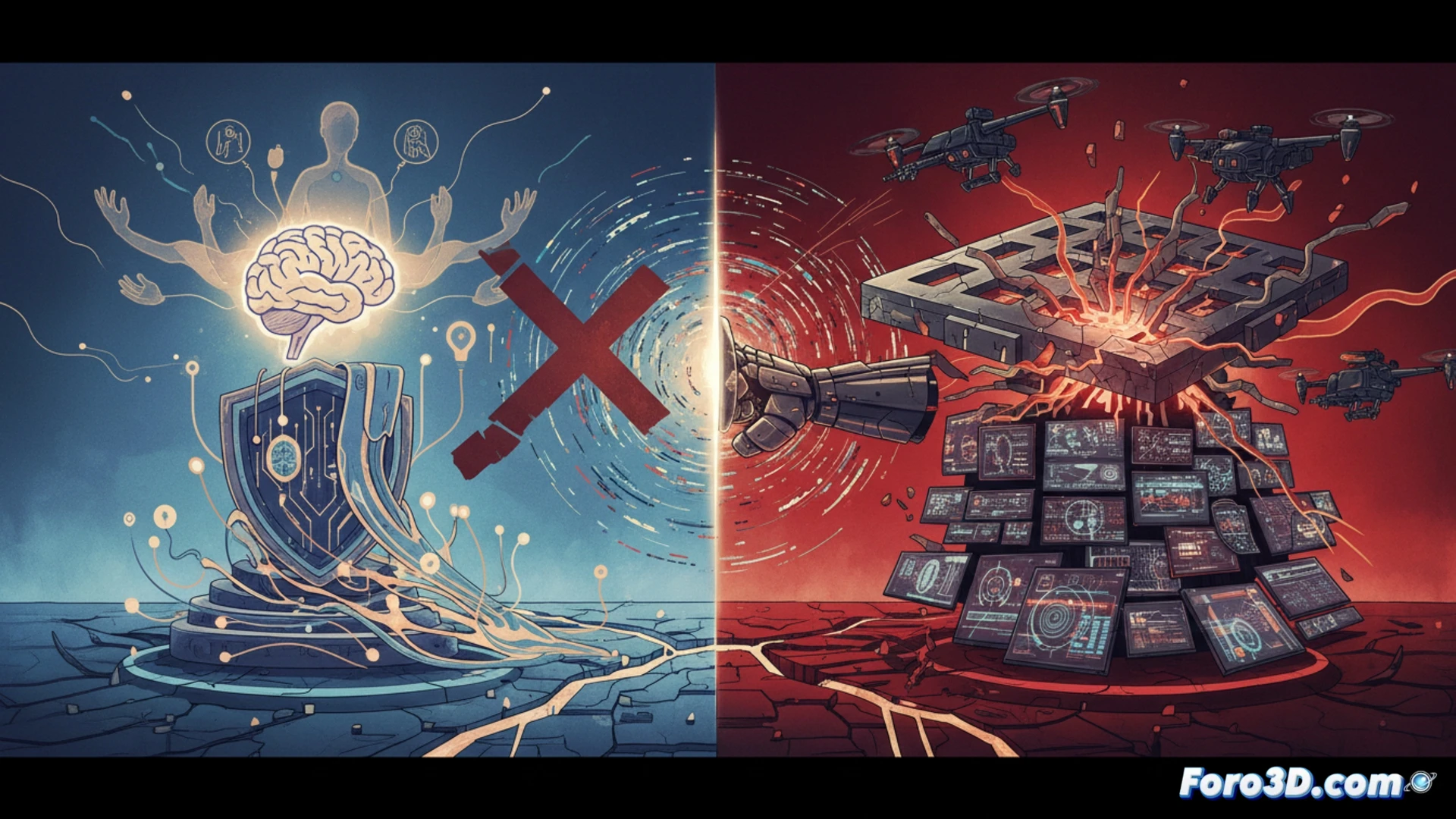

In un movimento senza precedenti, il Dipartimento della Difesa degli Stati Uniti ha designato l'azienda di intelligenza artificiale Anthropic come un rischio per la catena di approvvigionamento della sicurezza nazionale. Questa misura, tipicamente riservata ad avversari stranieri, proibisce all'azienda e ai suoi partner di lavorare con il governo. Il conflitto nasce da uno scontro etico inconciliabile: Anthropic si è rifiutata di permettere l'uso della sua IA per sorveglianza di massa o armi autonome, sfidando le richieste del Pentagono e mettendo a rischio la sua stessa sostenibilità economica.

La designazione come rischio della catena di approvvigionamento: implicazioni legali e operative ⚖️

La designazione ufficiale come rischio per la catena di approvvigionamento della sicurezza nazionale non è una sanzione minore. È uno strumento legale potente che esclude efficacemente Anthropic da qualsiasi contratto con il Dipartimento della Difesa e altre agenzie chiave. Questo va oltre un semplice rifiuto di una gara d'appalto; è un divieto ampio che si estende ai suoi partner commerciali, isolando l'azienda da un mercato gigantesco. La decisione di Anthropic di impugnare la misura in tribunale creerà un precedente cruciale. Il caso giudiziario definirà i limiti del potere governativo per punire le aziende che, per motivi etici auto-dichiarati, rifiutano di collaborare in progetti di sicurezza nazionale, e metterà alla prova l'autonomia aziendale nello sviluppo di tecnologie a doppio uso.

Un precedente pericoloso per l'industria dell'IA ⚠️

Questo caso trascende Anthropic e stabilisce un precedente allarmante per l'intera industria tecnologica. Segnala che dare priorità a principi etici rigidi, specialmente in aree sensibili come l'autonomia letale o la sorveglianza, può comportare un costo economico esistenziale. La misura del Pentagono potrebbe costringere altre startup a scegliere tra la loro bussola morale e la loro sopravvivenza commerciale, frenando l'innovazione responsabile e spingendo lo sviluppo dell'IA critica verso attori meno scrupolosi o verso potenze rivali. La battaglia legale risultante definirà il futuro della governance etica dell'IA e il fragile equilibrio tra la sicurezza dello stato e la libertà di coscienza aziendale.

Fino a che punto deve essere prioritizzata la sicurezza nazionale rispetto all'etica nello sviluppo dell'intelligenza artificiale avanzata?

(PD: provare a bandire un soprannome su internet è come provare a coprire il sole con un dito... ma in digitale)