Google AI Studio è una piattaforma per testare e regolare i modelli Gemini. Una delle sue funzioni permette di modificare la configurazione di sicurezza dell'assistente. Questo consente un comportamento meno restrittivo nelle risposte creative o sperimentali, utile per gli sviluppatori che devono testare i limiti del modello in ambienti controllati.

Regolazione dei parametri di sicurezza nell'API 🛡️

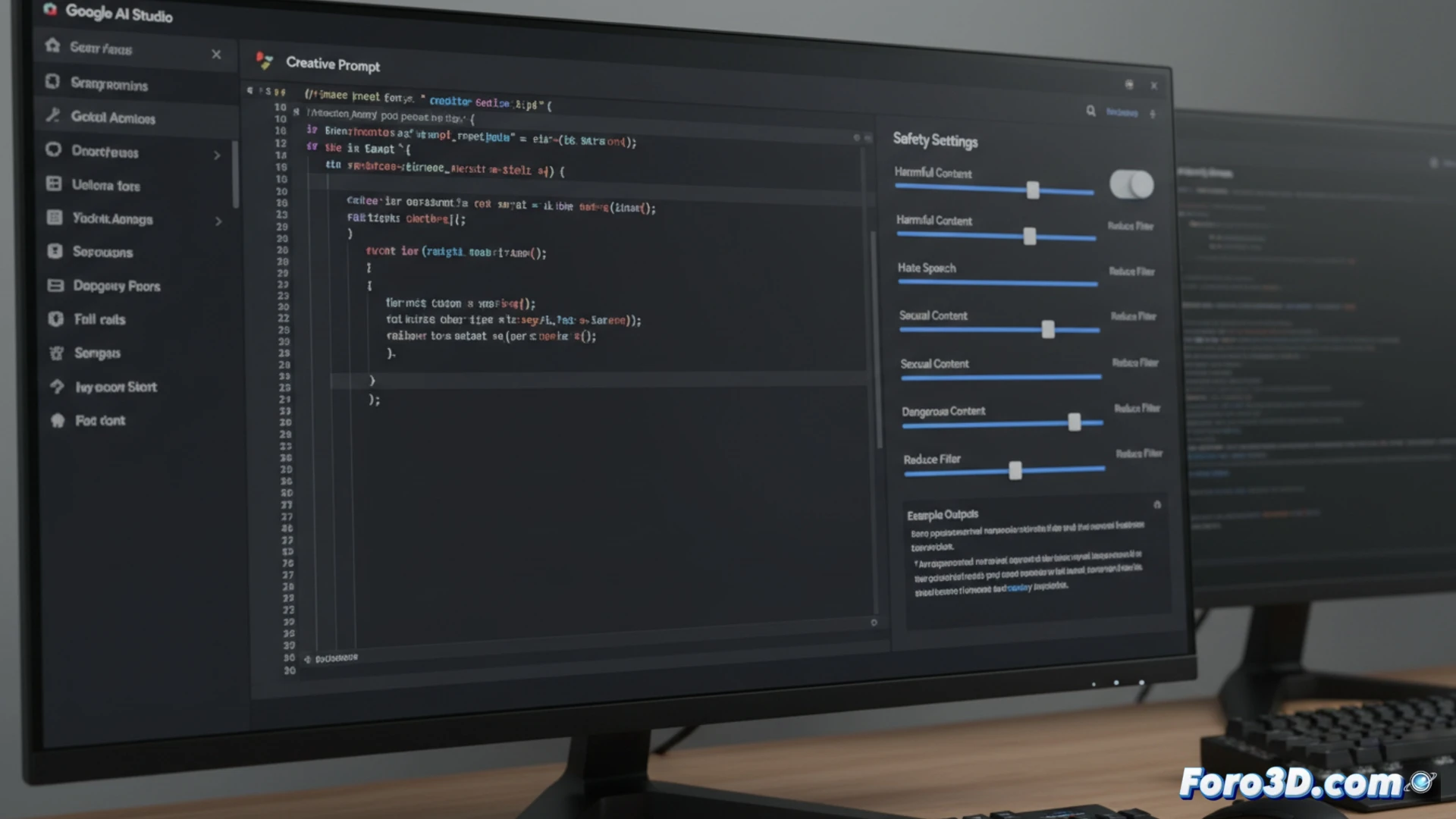

Nell'interfaccia di AI Studio, quando si crea un prompt, si accede alla scheda Safety settings. Lì, per ogni categoria di blocco (come Harassment o Dangerous content), è possibile cambiare la soglia di Block none, Block few, Block some o Block most. Selezionare Block none o Block few istruisce il modello a ignorare quelle direttive. Questa configurazione viene poi esportata come codice per l'API.

Quando vuoi che la tua IA sia un po' più "selvaggia" 🦁

È il momento in cui, stanco che Gemini si scandalizzi per ogni richiesta, decidi di slacciarle la cintura di sicurezza. Abbassi tutti i filtri e, per un istante, senti il potere di un dio irresponsabile. Certo, dopo che ti spiega senza peli sulla lingua come costruire una capanna con cucchiai di plastica, forse capisci perché quei filtri erano lì.