Adattamento di modelli lidar mediante distillazione di conoscenza visiva

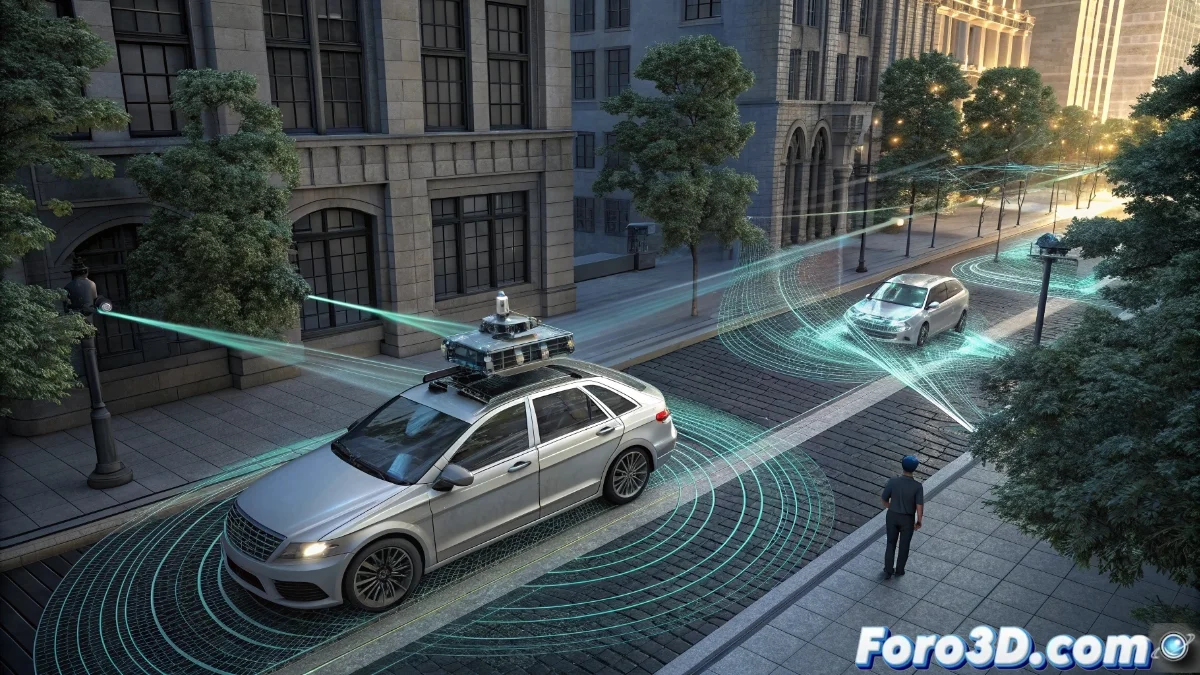

L'interoperabilità tra sensori lidar eterogenei rappresenta uno degli ostacoli più complessi nello sviluppo di sistemi autonomi robusti. Quando un modello addestrato con dati di un sensore specifico si confronta con variazioni in risoluzione, pattern di scansione o livelli di rumore, la sua capacità di segmentazione semantica si deteriora drammaticamente 🎯.

Fondamenti del trasferimento multimodale

I Vision Foundation Models emergono come soluzione paradigmatica mediante processi di distillazione non supervisionata che trasformano rappresentazioni visive in conoscenza trasferibile a domini lidar. Questa metodologia sfrutta la stabilità intrinseca dei modelli di immagine per generare segnali di insegnamento ricchi che guidano l'apprendimento del modello lidar senza richiedere annotazioni manuali nel nuovo dominio sensor 🔄.

Meccanismi chiave della distillazione incrociata:- Il modello visivo agisce come professore generativo producendo rappresentazioni invarianti rispetto alle variazioni sensoriali

- Lo studente lidar impara a emulare queste rappresentazioni durante un preaddestramento estensivo con dati non etichettati

- Si stabilisce uno spazio latente condiviso che facilita l'adattamento successivo tra diverse configurazioni di sensori

La distillazione multimodale crea ponti cognitivi tra domini visivi e lidar, replicando la capacità umana di trasferire conoscenza tra contesti sensoriali diversi

Architettura per generalizzazione scalabile

La scelta del backbone lidar determina criticamente l'efficacia del processo di trasferimento. Certi topologie neurali dimostrano maggiore attitudine ad assorbire e conservare le caratteristiche stabili provenienti dai modelli fondazione visivi. La metodologia proposta permette un preaddestramento unico del backbone mediante distillazione, consentendone il riutilizzo in molteplici scenari di cambio di dominio senza ripetere il processo completo 🏗️.

Strategie di preservazione della generalizzazione:- Mantenimento del backbone congelato durante la fase di adattamento finale al nuovo sensore

- Addestramento esclusivo di testine MLP leggere per compiti specifici di segmentazione

- Estrazione di caratteristiche robuste che resistono a variazioni in densità e pattern di scansione

Validazione sperimentale e applicazioni pratiche

Questo approccio ha dimostrato superiorità consistente rispetto ai metodi convenzionali in quattro scenari di riferimento particolarmente sfidanti, inclusi transizioni tra lidar di diversa densità e configurazioni di scansione. In implementazioni reali come la migrazione di veicoli autonomi da sistemi rotatori a 64 linee a configurazioni a 32 linee, il backbone preaddestrato estrae caratteristiche resilienti rispetto alle riduzioni di densità, mentre la testina MLP impara rapidamente a mappare queste rappresentazioni a classi semantiche specifiche 🚗.

La combinazione sinergica di distillazione immagine-lidar, backbone riutilizzabile e testine di adattamento leggere costituisce un paradigma efficiente e scalabile per affrontare le sfide di generalizzazione nella percezione robotica. Questo avanzamento rappresenta un cambiamento concettuale fondamentale: i sistemi lidar stanno finalmente imparando che cambiare strumento non implica riapprendere da zero, ma adattarsi intelligentemente a nuove condizioni operative 💡.