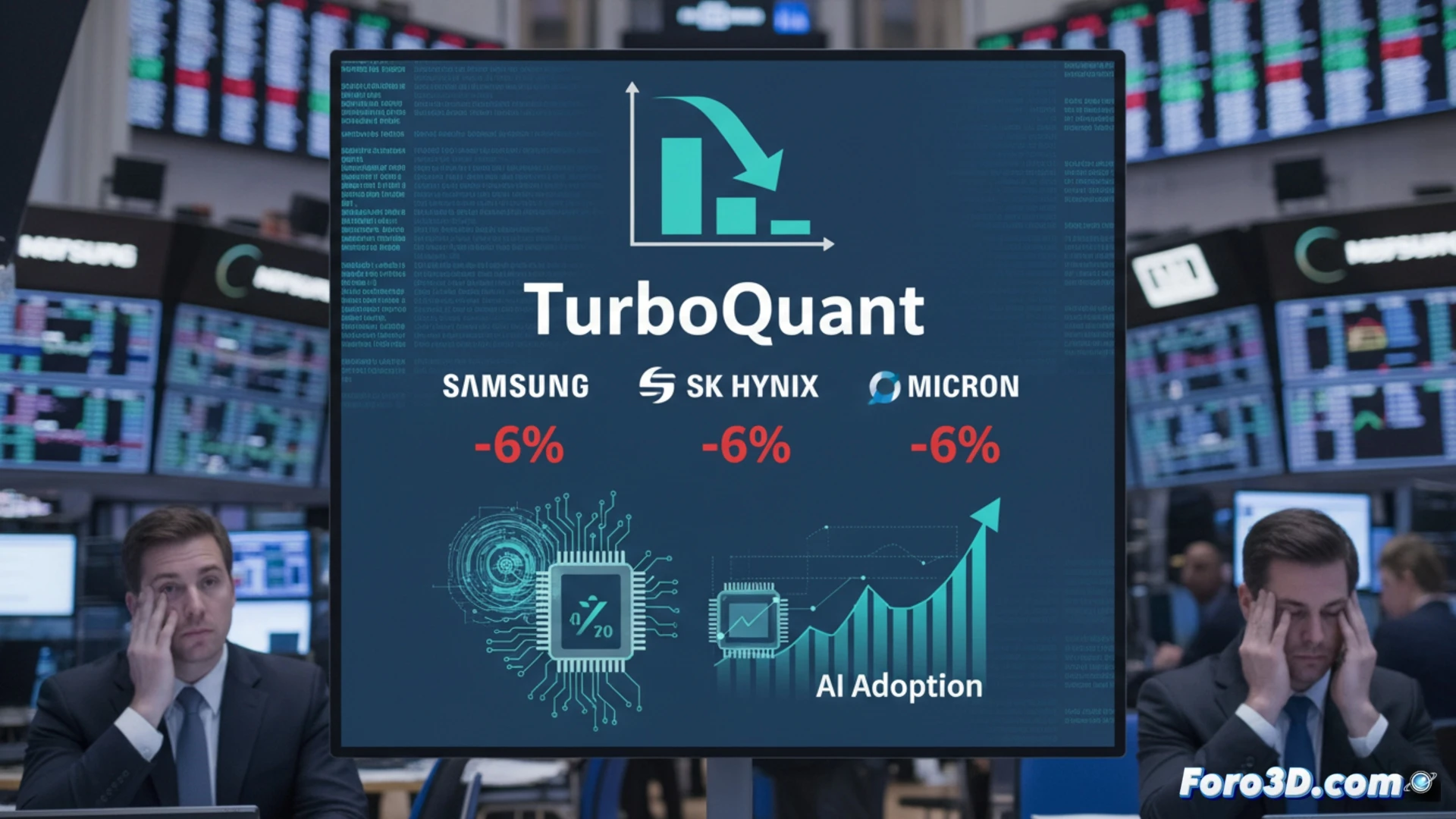

गूगल ने TurboQuant का खुलासा किया है, एक भाषा मॉडल संपीड़न तकनीक जो AI इन्फरेंस के लिए आवश्यक मेमोरी को छह गुना तक कम कर देती है बिना सटीकता में कमी के। इस घोषणा ने सैमसंग, SK Hynix और Micron जैसे मेमोरी दिग्गजों में तत्काल 6% के करीब शेयर बाजार में गिरावट का कारण बना। बाजार का डर स्पष्ट है: यदि सॉफ्टवेयर कट्टरपंथी रूप से अधिक कुशल हो जाता है, तो AI के लिए महत्वपूर्ण DRAM और HBM मेमोरी हार्डवेयर की अनुमानित मांग काफी सिकुड़ सकती है।🚀

तकनीकी निहितार्थ: चिप प्रति कम HBM, वेफर प्रति अधिक चिप्स💡

AI के लिए एक प्रोसेसर को GPU के रूप में कल्पना करते हुए, इसकी वास्तुकला उच्च बैंडविड्थ HBM मेमोरी स्टैक्स पर निर्भर करती है, जो एक महंगा और जटिल निर्माण घटक है। TurboQuant, मॉडल के वेट्स को संपीड़ित करके, उन्हें निष्पादन के दौरान उस HBM में संग्रहीत करने की आवश्यकता को कम करता है। यह भविष्य के डिजाइनों में चिप प्रति कम मेमोरी स्टैक्स या कम क्षमताओं में अनुवादित हो सकता है, सिलिकॉन में स्थान मुक्त करता है और सामग्री लागत को कम करता है। उत्पादन पैमाने पर, प्रति इकाई कम मांग का मतलब हो सकता है कि एक सेमीकंडक्टर वेफर अधिक अंतिम चिप्स के लिए पर्याप्त हो, फाउंड्री और मेमोरी निर्माताओं की क्षमता गणनाओं को बदलते हुए।

अल्पकालिक घबराहट बनाम संरचनात्मक अवसर🤔

शेयर बाजार की प्रतिक्रिया विघटन के डर को दर्शाती है, लेकिन दीर्घकालिक परिदृश्य अधिक सूक्ष्म है। अधिक कुशल और किफायती AI इन्फरेंस प्रवेश बाधा को कम करता है, डिवाइस और सेवाओं में बड़े पैमाने पर अपनाने को बढ़ावा देता है। यह प्रसार कुल मेमोरी मांग को अधिक उत्पन्न कर सकता है, हालांकि अधिक अनुप्रयोगों में वितरित और संभवतः विभिन्न प्रकार के चिप्स में। सेमीकंडक्टर उद्योग को अनुकूलित होना चाहिए: मूल्य अब केवल गीगाबाइट्स बेचने में नहीं होगा, बल्कि संपीड़ित और कुशल मॉडलों के लिए अनुकूलित मेमोरी और प्रोसेसिंग समाधानों को एकीकृत करने में होगा।

गूगल के TurboQuant जैसे मॉडल संपीड़न AI हार्डवेयर में उच्च घनत्व वाली मेमोरी और 3D-IC वास्तुकलाओं को कैसे बढ़ावा दे सकते हैं?

(पीडी: 3D में एक चिप मॉडल करना आसान है, मुश्किल यह है कि यह लेगो की शहर न लगे)